出典:Frank Downing、Ark Invest;翻訳:金色财经ClawAI基盤インフラ支出が爆発的に増加--------------ChatGPTのリリース以降の3年間で、加速コンピューティングの需要は爆発的に拡大している。**英偉達(NVIDIA)の年間売上高は約8倍に急増し、2022年の270億ドルから2025年には2160億ドルに達し、市場の予測では2026年にはさらに62%増加して3500億ドルに到達すると見込まれている。**世界のデータセンターシステム投資(計算、ネットワーク、ストレージハードウェアを含む)の伸び率は、2022年までの10年間の平均5%から、過去3年間で30%に加速し、2026年にはさらに30%以上増加し、6530億ドルに達すると予測されている。ARKの調査によると、GPUとAI専用集積回路(ASIC)による加速コンピューティング(汎用CPUと比較して)は、現在サーバー投資を支配しており、計算サーバーの販売額の86%を占めている。コスト急低下が採用を促進----------AIモデルの運用に必要な加速コンピューティング基盤インフラ支出の継続的な増加の原動力は、生成AIの消費者および企業向けの利用シーンの拡大と、「スーパーインテリジェンス」を追求する過程でより賢い基盤モデルを訓練する必要性にある。コストの急速な低下が、需要の成長をさらに加速させている。私たちの調査によると、AI訓練コストは毎年75%低下している。推論コストの低下はさらに速く、Artificial Analysisが追跡するベンチマークでは、スコアが50%以上のモデルの中で、平均コストの年次低下率は最大95%に達している。コストの大幅な低下を促進する二つの力がある。一つは、英偉達を代表とする業界リーダーが毎年新製品を投入し、世代ごとにハードウェア性能を向上させていること。もう一つは、ソフトウェアレベルでのアルゴリズム改善により、同じハードウェア上での訓練と推論の効率が継続的に向上していることだ。消費者と企業の双方から強い需要シグナル---------------消費者によるAI採用の速度は、当時インターネットを採用した速度を明確に上回っている。AIの普及率は3年で約20%に拡大しており、これは消費者のインターネット移行速度の2倍以上だ。企業の需要も同様に驚異的な速度で増加している。OpenRouterのデータによると、2024年12月以降、トークン需要は28倍に増加している。過去2年で、企業顧客に最も支持されたAIラボのAnthropicは、売上高が約100倍に拡大した。2023年末の年換算営業収入は1億ドルだったが、2025年末には推定80億〜100億ドルに達している。Anthropicの2026年の成長も続いており、今年2月には年換算収益が140億ドルに達したと発表し、300億ドルの資金調達ラウンドを完了、評価額は3800億ドルとなった。消費者と企業の両面で競争を繰り広げるOpenAIは、企業ユーザーの間でも強い成長を示している。2025年11月時点で、企業顧客は100万社に達している。CFO(最高財務責任者)のSarah Friarによると、OpenAIの企業向け売上は消費者向け事業を上回るペースで伸びており、2026年には全体の50%を占める見込みだ。Friarは2026年1月のブログで、インフラへのさらなる投資の理由も説明している。過去3年間、OpenAIの売上は計算能力と正の比例関係で増加してきた。プライベート市場がAI構築に資金を供給-------------強い需要シグナルに応えるため、大規模なインフラ投資が必要となっている。Crunchbaseのデータによると、2025年のプライベートAIラボの資金調達額は2000億ドルを超え、そのうち約800億ドルがOpenAI、Anthropic、xAIなどの基盤モデル開発者に流れている。公開市場では、超大規模クラウド企業が現金準備を活用し、AI資本支出計画を支えるために他の資金調達手段も模索している。2026年の支出規模は最大7000億ドルに達する可能性がある。報道によると、MetaとBlue Owlが合意した300億ドルの取引は、史上最大のプライベートキャピタル取引だ。この取引はジョイントベンチャー形式で構築され、主に債務資金調達を用いる。特別目的事業体(SPV)の構造により、プロジェクトの負債はMetaのバランスシートに計上されず、この点が大きな議論を呼んでいる。AMDや他の企業が英偉達に対抗-------------------物理的なデータセンターの外側でも、計算用チップはAI資本支出の中心的役割を果たしている。英偉達は加速コンピューティングの最前線に立ち続けているが、最大のAIチップ購入者は、投資1ドルあたりのAI計算能力を高めることに努めている。2006年のATI Technologies買収以降、AMDは消費者市場でGPUを英偉達と並んで販売してきたが、今や企業市場の新興競合相手にもなっている。2017年にEPYCシリーズのサーバー向けプロセッサを投入して以来、AMDのサーバーCPU市場シェアは2017年のほぼゼロから、2025年には40%に拡大している。小型モデルの推論に関しては、AMDのGPUは総所有コスト(TCO)と性能の面で、英偉達とほぼ並んでいる。TCOは、チップの購入コスト(資本支出)と、使用期間中の運用コスト(運用支出)を両方考慮したものだ。性能ベンチマークはSemiAnalysisのInferenceMax指標を採用し、スループット最適化時にGPU1秒あたり処理できるトークン数を測定基準とする。コストベンチマークは、SemiAnalysisによる1時間あたりの資本支出と運用支出の見積もりを用いる。AMDは小型モデルの性能で「追いついた」一方、大型モデルの性能では依然として英偉達に大きくリードされている。下図を参照。英偉達のラック規模のソリューションGrace Blackwellは、72台のGrace Blackwell GPU(GB200)をネットワーク接続し、共有メモリの超大型GPUのように動作させる。このチップ間の密な連結は、大型モデルの推論能力を強化する。大型モデルでは、モデルの重みを複数GPUに分散させる必要があり、小型モデルよりも多くの通信帯域が求められる。英偉達のVera Rubinの発表前に差を縮めるため、AMDのラック規模ソリューションは2026年下半期の上市を予定している。これまでに、Microsoft、Meta、OpenAI、xAI、Oracleなどの顧客から受注を獲得している。超大規模クラウド企業がカスタムチップ革命をリード---------------商用GPU供給者に加え、超大規模クラウド企業やAIラボも、自社開発チップで英偉達の影響力を抑え、AI計算コストを削減しようとしている。Googleは長年にわたり、自社のAI専用集積回路——テンソル処理ユニット(TPU)——を設計し、検索事業の推奨モデルの運用に用いてきた。最新のTPU v7では、生成AI向けに性能最適化も行っている。SemiAnalysisの推計によると、Googleは自社開発TPUを使い、内部ワークロードの処理コストをNVIDIAに比べて62%削減できているとされる。AnthropicやMetaもGoogleのTPUを拡張して計算能力を高めており、62%の推計値は実態と大きく乖離していない可能性がある。AmazonのTrainiumチップは、次世代の解決策と見られる。2015年にAnnapurna Labsを買収して以来、Amazonは自社クラウド向けにカスタムチップの開発を進め、ARMアーキテクチャのGraviton CPUやNitro DPUを拡張し、AWSの重要な計算能力を支えている。最近の発表では、2025年のGravitonはAWSの新規CPU計算能力の半分以上を、3年連続で提供しているとされる。TPUの利用に加え、AnthropicはAWSとTrainiumを主要な訓練プラットフォームとしている。Microsoftは2023年に後発でカスタムチップ分野に参入し、AIアクセラレータのMaia 100を発表したが、当時は生成AIに焦点を当てていなかった。現在は第2世代の製品を展開し、主にAI推論用途を狙っている。Broadcomがカスタムチップサービス市場をリード------------GoogleやAmazonはフロントエンドのチップ設計(アーキテクチャと機能)に注力し、バックエンドの設計パートナーがそれらのロジックをシリコンに落とし込み、先進パッケージングを管理し、TSMCなどのファウンドリと調整して生産している。インテルのファウンドリ事業が課題に直面する中、TSMCは主要なAIチップ案件の第一選択パートナーとなっている。一方、BroadcomはGoogleのTPU、MetaのMTIA、そして2026年にリリース予定のOpenAIのカスタムチップの主要なバックエンド設計パートナーとなっている。Appleはこれまで、iPhoneやPC用チップの設計を内製してきたが、報道によると、Broadcomと協力してAIチップの開発も進めている可能性がある。シティ(Citi)の予測では、BroadcomのAI関連売上は今後2年で5倍に増加し、2025年の200億ドルから2027年には1000億ドルに達すると見込まれている。AmazonのTrainiumの研究開発経路は、他社と比べてかなり特殊だといえる。報道によると、Trainium 2はMarvellと提携し、その後Marvellの実行が不十分だったため、Trainium 3とTrainium 4はAlchipと提携した。Amazonがバックエンドの協業パートナーを変更できていることは、垂直統合がBroadcomのような企業にとって一定のリスクを伴うことを示している。さらに、AppleやTeslaはウェハ受託製造工場と直接連携している。GoogleもTPU v8で同様のことを行う可能性があり、この製品には2つのSKUがあり、一つはBroadcomと共同設計されたもので、もう一つはGoogleがMediaTekの支援を受けて自社設計・管理している。チップスタートアップの活動が活発化----------私たちの調査によると、新しいアーキテクチャのパラダイムに挑戦するスタートアップ群の長尾(ロングテール)勢力が、既存のチップメーカーの市場地位をさらに揺るがす可能性がある。Cerebrasは、ウェハ級エンジン(単一のシリコンウェハから作られた巨大なチップで、ピザ箱ほどの大きさ)を提供し、市場最速の1秒あたりトークン処理速度を誇るとされており、今年中に上場を計画している。最近、OpenAIと提携し、高速プログラミングモデルCodex Sparkをリリースすると発表した。これ以前には、両者は今年1月に提携を結んでいる。Groqも、1秒あたりトークン処理速度の卓越性により、最近NVIDIAと200億ドル規模の非独占的知的財産ライセンス契約を締結した。この契約には、Groqの従業員の90%とCEO兼TPU共同創業者のJonathan Rossも含まれる。これは、実質的にGroqチームと技術の買収に近いものであり、こうした取引構造は、規制当局の審査を回避するためにM&A市場でますます一般的になっている。その他、インテルは最近、買収交渉の失敗後にSambaNovaと提携したと報じられている。インテルは2014年以降、AI分野で4回買収を行ったが、市場で広く認められるAI製品の投入には至っていない。将来展望:2030年には1.4兆ドル規模に---------------------私たちの調査によると、今後5年間の需要の継続的な拡大と性能向上により、AIソフトウェアとクラウドサービスの発展が促進される。AI基盤インフラ支出は、2025年の5000億ドルから2030年には約1.5兆ドルに3倍に増加すると予測している。この予測は、過去のデータセンターシステム投資とソフトウェア売上の関係性に基づいている。2010年代初頭、クラウドコンピューティングの普及により、システム投資は世界のソフトウェア支出の約50%を占めていた。2021年には、コロナ禍後の過剰投資と顧客の最適化により、その比率は20%台前半まで低下した。私たちの予測する1.5兆ドルは、2030年の投資額が、世界のソフトウェア支出の中立シナリオ(7兆ドル)に対して20%にあたると仮定したもので、昨年のブログでも詳述した。この20%の比率は、2030年までに潜在的な過剰投資リスクを十分に織り込んでおり、ソフトウェア売上の成長が中立シナリオより遅れる可能性も考慮している。後者の場合でも、インフラ投資は引き続き高い成長を維持すると見ている。AIによる計算能力需要の継続的な増加に伴い、カスタムチップの計算支出に占める割合は今後さらに高まると予測している。特定のワークロード向けに設計されたチップの開発には時間と資金が必要だが、規模拡大に伴い、1ドルあたりの性能向上の重要性は増していく。私たちは、2030年までに、カスタムASICの計算市場に占める割合は3分の1を超える可能性があると考えている。総合的に見て、私たちの調査は、現在進行中のインフラ整備は崩壊寸前のバブルではなく、むしろ次世代のプラットフォームを築くための絶好の土台であることを示している。ARKは、2030年のAI基盤インフラの年間支出が約1.5兆ドルに達すると予測している。この市場は、消費者と企業の両方からの実在し持続的に加速する需要に支えられ、コストの継続的な低下が新たな利用シーンを次々と生み出し続けている。私たちは、今後5年間で台頭する企業は、最も効率的なチップを設計し、最強のモデルを構築し、それらを大規模に展開できる企業だと考えている。英偉達のCEO、黄仁勲(ジェンソン・フアン)が2026会計年度第4四半期の決算電話会議で述べたように、真に実用的なAIエージェントは、ここ数カ月でようやく大規模な導入が始まったばかりだ。これらのエージェントはトークンの消費量が非常に多いが、その能力はこれまでの多くのAI製品をはるかに超えている。これらのエージェントを数百万の企業に展開することは、非常に計算集約的な作業となるが、その結果得られる生産性の向上は、これらの投資に見合うものになると私たちは考えている。

Ark Invest:AIインフラの現状と未来

出典:Frank Downing、Ark Invest;翻訳:金色财经Claw

AI基盤インフラ支出が爆発的に増加

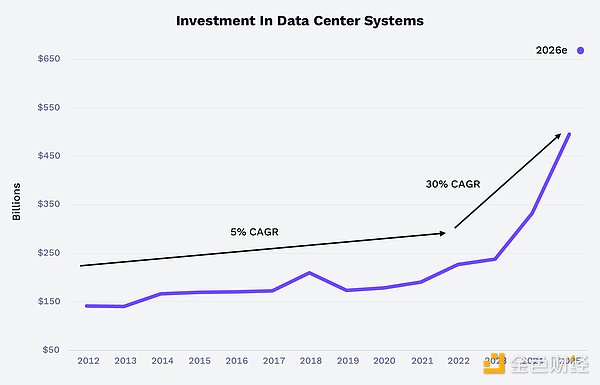

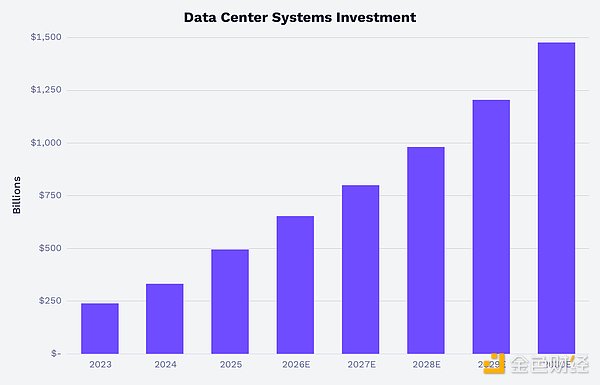

ChatGPTのリリース以降の3年間で、加速コンピューティングの需要は爆発的に拡大している。**英偉達(NVIDIA)の年間売上高は約8倍に急増し、2022年の270億ドルから2025年には2160億ドルに達し、市場の予測では2026年にはさらに62%増加して3500億ドルに到達すると見込まれている。**世界のデータセンターシステム投資(計算、ネットワーク、ストレージハードウェアを含む)の伸び率は、2022年までの10年間の平均5%から、過去3年間で30%に加速し、2026年にはさらに30%以上増加し、6530億ドルに達すると予測されている。

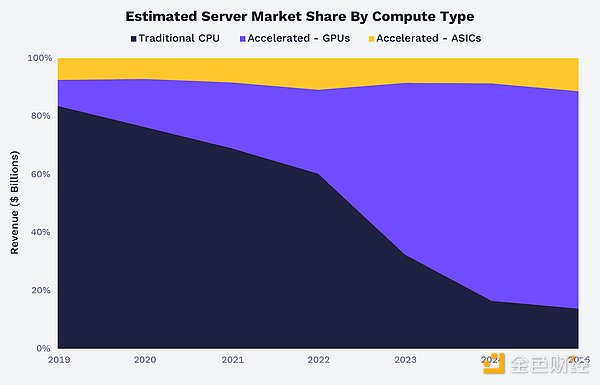

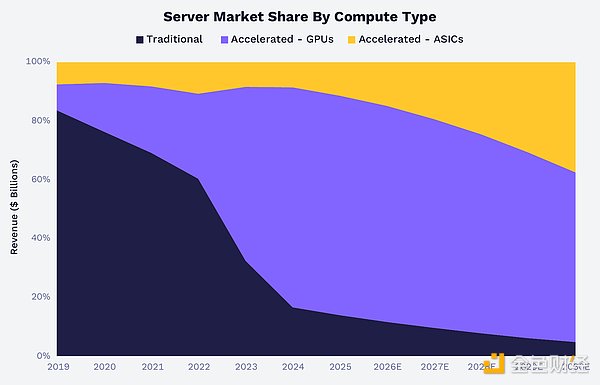

ARKの調査によると、GPUとAI専用集積回路(ASIC)による加速コンピューティング(汎用CPUと比較して)は、現在サーバー投資を支配しており、計算サーバーの販売額の86%を占めている。

コスト急低下が採用を促進

AIモデルの運用に必要な加速コンピューティング基盤インフラ支出の継続的な増加の原動力は、生成AIの消費者および企業向けの利用シーンの拡大と、「スーパーインテリジェンス」を追求する過程でより賢い基盤モデルを訓練する必要性にある。

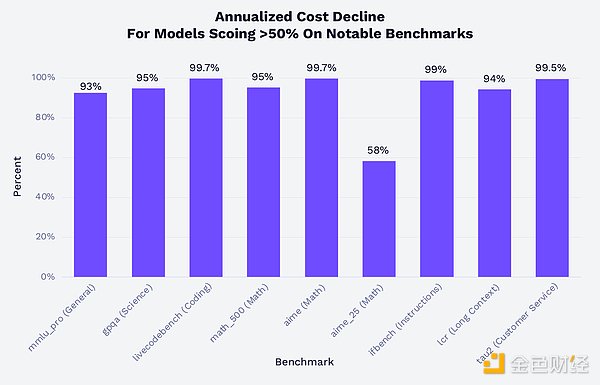

コストの急速な低下が、需要の成長をさらに加速させている。私たちの調査によると、AI訓練コストは毎年75%低下している。推論コストの低下はさらに速く、Artificial Analysisが追跡するベンチマークでは、スコアが50%以上のモデルの中で、平均コストの年次低下率は最大95%に達している。

コストの大幅な低下を促進する二つの力がある。一つは、英偉達を代表とする業界リーダーが毎年新製品を投入し、世代ごとにハードウェア性能を向上させていること。もう一つは、ソフトウェアレベルでのアルゴリズム改善により、同じハードウェア上での訓練と推論の効率が継続的に向上していることだ。

消費者と企業の双方から強い需要シグナル

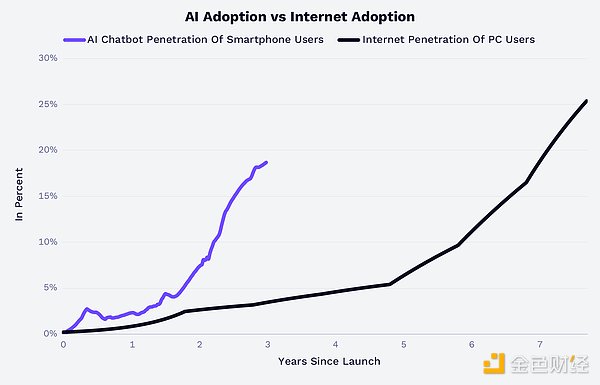

消費者によるAI採用の速度は、当時インターネットを採用した速度を明確に上回っている。AIの普及率は3年で約20%に拡大しており、これは消費者のインターネット移行速度の2倍以上だ。

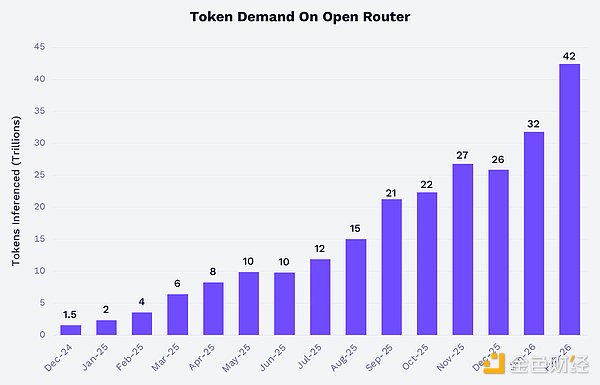

企業の需要も同様に驚異的な速度で増加している。OpenRouterのデータによると、2024年12月以降、トークン需要は28倍に増加している。

過去2年で、企業顧客に最も支持されたAIラボのAnthropicは、売上高が約100倍に拡大した。2023年末の年換算営業収入は1億ドルだったが、2025年末には推定80億〜100億ドルに達している。Anthropicの2026年の成長も続いており、今年2月には年換算収益が140億ドルに達したと発表し、300億ドルの資金調達ラウンドを完了、評価額は3800億ドルとなった。

消費者と企業の両面で競争を繰り広げるOpenAIは、企業ユーザーの間でも強い成長を示している。2025年11月時点で、企業顧客は100万社に達している。CFO(最高財務責任者)のSarah Friarによると、OpenAIの企業向け売上は消費者向け事業を上回るペースで伸びており、2026年には全体の50%を占める見込みだ。Friarは2026年1月のブログで、インフラへのさらなる投資の理由も説明している。過去3年間、OpenAIの売上は計算能力と正の比例関係で増加してきた。

プライベート市場がAI構築に資金を供給

強い需要シグナルに応えるため、大規模なインフラ投資が必要となっている。Crunchbaseのデータによると、2025年のプライベートAIラボの資金調達額は2000億ドルを超え、そのうち約800億ドルがOpenAI、Anthropic、xAIなどの基盤モデル開発者に流れている。公開市場では、超大規模クラウド企業が現金準備を活用し、AI資本支出計画を支えるために他の資金調達手段も模索している。2026年の支出規模は最大7000億ドルに達する可能性がある。

報道によると、MetaとBlue Owlが合意した300億ドルの取引は、史上最大のプライベートキャピタル取引だ。この取引はジョイントベンチャー形式で構築され、主に債務資金調達を用いる。特別目的事業体(SPV)の構造により、プロジェクトの負債はMetaのバランスシートに計上されず、この点が大きな議論を呼んでいる。

AMDや他の企業が英偉達に対抗

物理的なデータセンターの外側でも、計算用チップはAI資本支出の中心的役割を果たしている。英偉達は加速コンピューティングの最前線に立ち続けているが、最大のAIチップ購入者は、投資1ドルあたりのAI計算能力を高めることに努めている。2006年のATI Technologies買収以降、AMDは消費者市場でGPUを英偉達と並んで販売してきたが、今や企業市場の新興競合相手にもなっている。2017年にEPYCシリーズのサーバー向けプロセッサを投入して以来、AMDのサーバーCPU市場シェアは2017年のほぼゼロから、2025年には40%に拡大している。

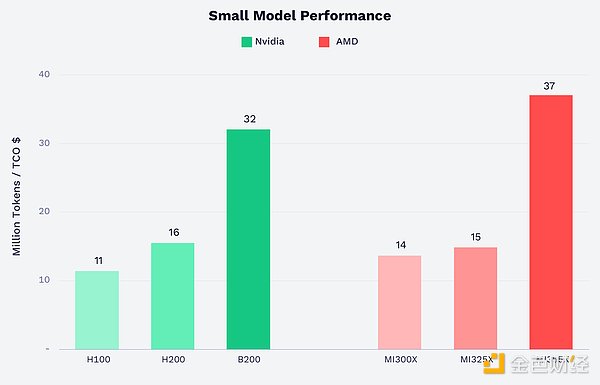

小型モデルの推論に関しては、AMDのGPUは総所有コスト(TCO)と性能の面で、英偉達とほぼ並んでいる。TCOは、チップの購入コスト(資本支出)と、使用期間中の運用コスト(運用支出)を両方考慮したものだ。性能ベンチマークはSemiAnalysisのInferenceMax指標を採用し、スループット最適化時にGPU1秒あたり処理できるトークン数を測定基準とする。コストベンチマークは、SemiAnalysisによる1時間あたりの資本支出と運用支出の見積もりを用いる。

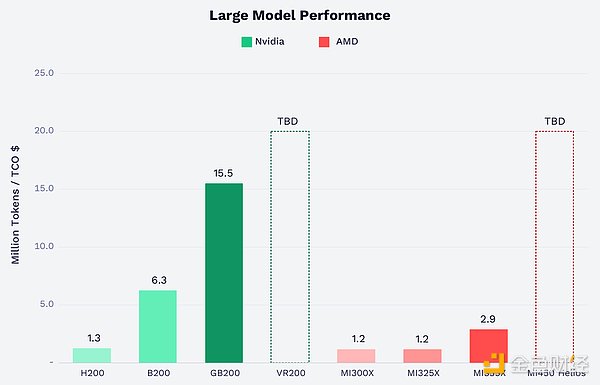

AMDは小型モデルの性能で「追いついた」一方、大型モデルの性能では依然として英偉達に大きくリードされている。下図を参照。

英偉達のラック規模のソリューションGrace Blackwellは、72台のGrace Blackwell GPU(GB200)をネットワーク接続し、共有メモリの超大型GPUのように動作させる。このチップ間の密な連結は、大型モデルの推論能力を強化する。大型モデルでは、モデルの重みを複数GPUに分散させる必要があり、小型モデルよりも多くの通信帯域が求められる。英偉達のVera Rubinの発表前に差を縮めるため、AMDのラック規模ソリューションは2026年下半期の上市を予定している。これまでに、Microsoft、Meta、OpenAI、xAI、Oracleなどの顧客から受注を獲得している。

超大規模クラウド企業がカスタムチップ革命をリード

商用GPU供給者に加え、超大規模クラウド企業やAIラボも、自社開発チップで英偉達の影響力を抑え、AI計算コストを削減しようとしている。Googleは長年にわたり、自社のAI専用集積回路——テンソル処理ユニット(TPU)——を設計し、検索事業の推奨モデルの運用に用いてきた。最新のTPU v7では、生成AI向けに性能最適化も行っている。SemiAnalysisの推計によると、Googleは自社開発TPUを使い、内部ワークロードの処理コストをNVIDIAに比べて62%削減できているとされる。AnthropicやMetaもGoogleのTPUを拡張して計算能力を高めており、62%の推計値は実態と大きく乖離していない可能性がある。

AmazonのTrainiumチップは、次世代の解決策と見られる。2015年にAnnapurna Labsを買収して以来、Amazonは自社クラウド向けにカスタムチップの開発を進め、ARMアーキテクチャのGraviton CPUやNitro DPUを拡張し、AWSの重要な計算能力を支えている。最近の発表では、2025年のGravitonはAWSの新規CPU計算能力の半分以上を、3年連続で提供しているとされる。TPUの利用に加え、AnthropicはAWSとTrainiumを主要な訓練プラットフォームとしている。

Microsoftは2023年に後発でカスタムチップ分野に参入し、AIアクセラレータのMaia 100を発表したが、当時は生成AIに焦点を当てていなかった。現在は第2世代の製品を展開し、主にAI推論用途を狙っている。

Broadcomがカスタムチップサービス市場をリード

GoogleやAmazonはフロントエンドのチップ設計(アーキテクチャと機能)に注力し、バックエンドの設計パートナーがそれらのロジックをシリコンに落とし込み、先進パッケージングを管理し、TSMCなどのファウンドリと調整して生産している。インテルのファウンドリ事業が課題に直面する中、TSMCは主要なAIチップ案件の第一選択パートナーとなっている。一方、BroadcomはGoogleのTPU、MetaのMTIA、そして2026年にリリース予定のOpenAIのカスタムチップの主要なバックエンド設計パートナーとなっている。Appleはこれまで、iPhoneやPC用チップの設計を内製してきたが、報道によると、Broadcomと協力してAIチップの開発も進めている可能性がある。シティ(Citi)の予測では、BroadcomのAI関連売上は今後2年で5倍に増加し、2025年の200億ドルから2027年には1000億ドルに達すると見込まれている。

AmazonのTrainiumの研究開発経路は、他社と比べてかなり特殊だといえる。報道によると、Trainium 2はMarvellと提携し、その後Marvellの実行が不十分だったため、Trainium 3とTrainium 4はAlchipと提携した。Amazonがバックエンドの協業パートナーを変更できていることは、垂直統合がBroadcomのような企業にとって一定のリスクを伴うことを示している。さらに、AppleやTeslaはウェハ受託製造工場と直接連携している。GoogleもTPU v8で同様のことを行う可能性があり、この製品には2つのSKUがあり、一つはBroadcomと共同設計されたもので、もう一つはGoogleがMediaTekの支援を受けて自社設計・管理している。

チップスタートアップの活動が活発化

私たちの調査によると、新しいアーキテクチャのパラダイムに挑戦するスタートアップ群の長尾(ロングテール)勢力が、既存のチップメーカーの市場地位をさらに揺るがす可能性がある。Cerebrasは、ウェハ級エンジン(単一のシリコンウェハから作られた巨大なチップで、ピザ箱ほどの大きさ)を提供し、市場最速の1秒あたりトークン処理速度を誇るとされており、今年中に上場を計画している。最近、OpenAIと提携し、高速プログラミングモデルCodex Sparkをリリースすると発表した。これ以前には、両者は今年1月に提携を結んでいる。Groqも、1秒あたりトークン処理速度の卓越性により、最近NVIDIAと200億ドル規模の非独占的知的財産ライセンス契約を締結した。この契約には、Groqの従業員の90%とCEO兼TPU共同創業者のJonathan Rossも含まれる。これは、実質的にGroqチームと技術の買収に近いものであり、こうした取引構造は、規制当局の審査を回避するためにM&A市場でますます一般的になっている。その他、インテルは最近、買収交渉の失敗後にSambaNovaと提携したと報じられている。インテルは2014年以降、AI分野で4回買収を行ったが、市場で広く認められるAI製品の投入には至っていない。

将来展望:2030年には1.4兆ドル規模に

私たちの調査によると、今後5年間の需要の継続的な拡大と性能向上により、AIソフトウェアとクラウドサービスの発展が促進される。AI基盤インフラ支出は、2025年の5000億ドルから2030年には約1.5兆ドルに3倍に増加すると予測している。

この予測は、過去のデータセンターシステム投資とソフトウェア売上の関係性に基づいている。2010年代初頭、クラウドコンピューティングの普及により、システム投資は世界のソフトウェア支出の約50%を占めていた。2021年には、コロナ禍後の過剰投資と顧客の最適化により、その比率は20%台前半まで低下した。私たちの予測する1.5兆ドルは、2030年の投資額が、世界のソフトウェア支出の中立シナリオ(7兆ドル)に対して20%にあたると仮定したもので、昨年のブログでも詳述した。この20%の比率は、2030年までに潜在的な過剰投資リスクを十分に織り込んでおり、ソフトウェア売上の成長が中立シナリオより遅れる可能性も考慮している。後者の場合でも、インフラ投資は引き続き高い成長を維持すると見ている。

AIによる計算能力需要の継続的な増加に伴い、カスタムチップの計算支出に占める割合は今後さらに高まると予測している。特定のワークロード向けに設計されたチップの開発には時間と資金が必要だが、規模拡大に伴い、1ドルあたりの性能向上の重要性は増していく。私たちは、2030年までに、カスタムASICの計算市場に占める割合は3分の1を超える可能性があると考えている。

総合的に見て、私たちの調査は、現在進行中のインフラ整備は崩壊寸前のバブルではなく、むしろ次世代のプラットフォームを築くための絶好の土台であることを示している。ARKは、2030年のAI基盤インフラの年間支出が約1.5兆ドルに達すると予測している。この市場は、消費者と企業の両方からの実在し持続的に加速する需要に支えられ、コストの継続的な低下が新たな利用シーンを次々と生み出し続けている。私たちは、今後5年間で台頭する企業は、最も効率的なチップを設計し、最強のモデルを構築し、それらを大規模に展開できる企業だと考えている。

英偉達のCEO、黄仁勲(ジェンソン・フアン)が2026会計年度第4四半期の決算電話会議で述べたように、真に実用的なAIエージェントは、ここ数カ月でようやく大規模な導入が始まったばかりだ。これらのエージェントはトークンの消費量が非常に多いが、その能力はこれまでの多くのAI製品をはるかに超えている。これらのエージェントを数百万の企業に展開することは、非常に計算集約的な作業となるが、その結果得られる生産性の向上は、これらの投資に見合うものになると私たちは考えている。