AI の 3 つの問題と DePIN の解決策

問題の鍵はコンピューティング能力の量ではなく、AI 製品にどのように力を与えるかです。

執筆者: FMGResearch

TL; DR

AI時代の製品競争はリソース面(計算能力、データなど)、特に安定したリソース面のサポートと切り離すことはできません。

モデルのトレーニング/反復には、データをフィードしてモデルの効率に質的な変化をもたらすために、膨大な数のユーザー ターゲット (IP) も必要です。

Web3 と組み合わせることで、中小規模の AI スタートアップ チームが従来の AI 大手企業を追い抜くことができます。

DePIN エコシステムの場合、下限はコンピューティング能力、帯域幅、その他のリソースによって決まります (単純なコンピューティング能力の統合には堀はありません)。AI モデルの適用、徹底した最適化 (BitTensor と同様)、専門化によって決まります ( Render、Hivemaper) とデータの有効活用プロジェクトの上限。

AI+DePINの文脈では、モデル推論と微調整、モバイルAIモデル市場が注目されるだろう。

AI 市場分析と 3 つの質問

統計によると、ChatGPT 誕生前夜の 2022 年 9 月から 2023 年 8 月まで、世界トップ 50 の AI 製品は 240 億回以上の訪問を生み出し、月間平均訪問数は 2 億 3,630 万回増加しました。

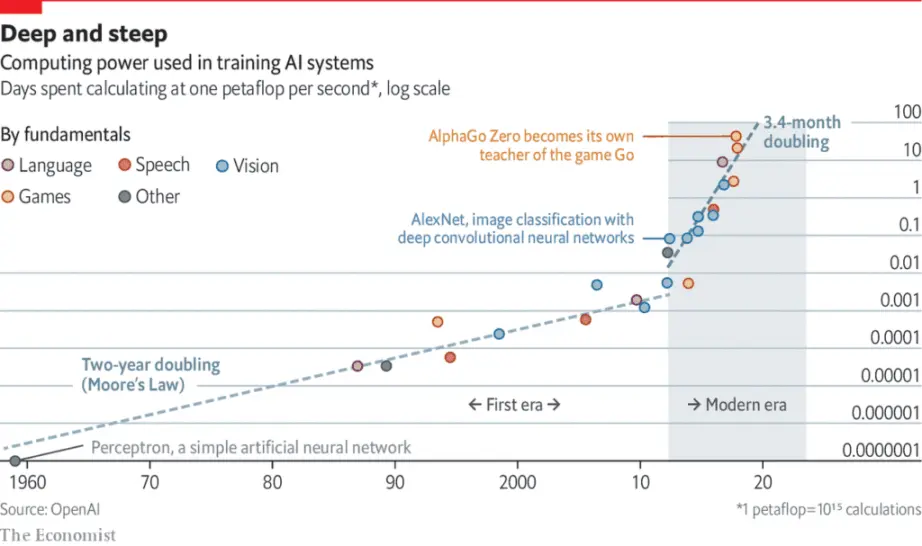

AI 製品の隆盛の背景には、コンピューティング能力への依存度の増大があります。

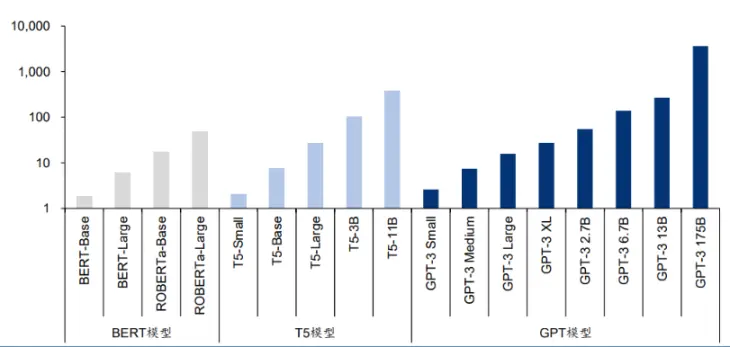

出典: 言語モデルはフューショット学習者

マサチューセッツ大学アマースト校の論文には、「AI モデルをトレーニングすると、その生涯にわたって車 5 台分もの二酸化炭素が排出される可能性がある」と記載されていますが、この分析には 1 回のトレーニング セッションしか含まれていませんでした。トレーニングを繰り返すことでモデルが改善されると、エネルギー使用量が大幅に増加します。

最新の言語モデルには、数十億、さらには数兆の重みが含まれています。人気のあるモデルの 1 つである GPT-3 には、1,750 億の機械学習パラメータがあります。 A100 を使用すると、モデルのトレーニングに 1,024 個の GPU、34 日、460 万ドルが必要になります。

ポスト AI 時代の製品競争は、コンピューティング能力に焦点を当てたリソース側の戦争へと徐々に拡大してきました。

出典:AI は地球に害を及ぼしています: AI の驚異的なエネルギーコストへの対処

これは 3 つの質問に及びます: **まず、AI 製品に、それをサポートするのに十分なリソース (コンピューティング能力、帯域幅など)、特に安定したリソースがあるかどうか。 **この種の信頼性を実現するには、十分なコンピューティング能力を備えた分散化が必要です。従来の分野では、政策やイデオロギーに基づいて築かれた世界の壁とチップの需要面のギャップにより、チップメーカーは当然有利な立場にあり、価格が大幅に上昇する可能性があります。たとえば、NVIDIA H100 モデル チップの価格は 2023 年 4 月に 36,000 米ドルから 50,000 米ドルに値上げされ、AI モデル トレーニング チームのコストがさらに増加します。

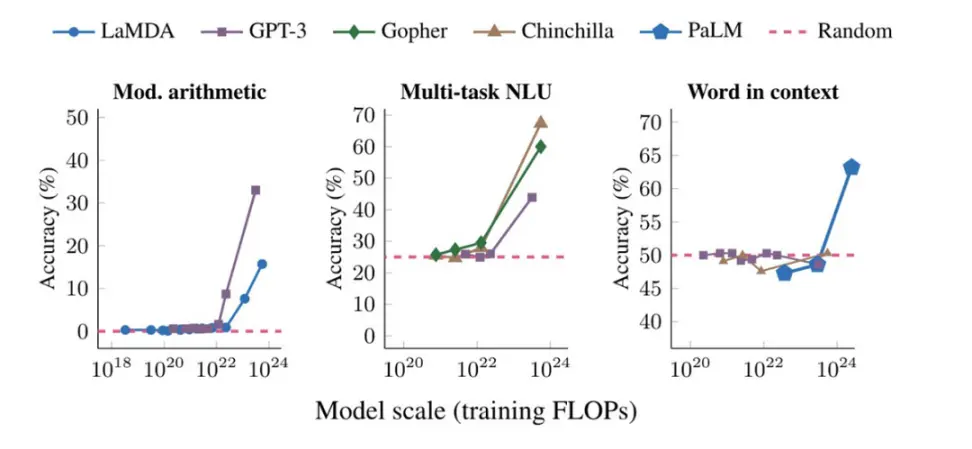

**2 番目の問題は、リソース側の条件を満たすことで、AI プロジェクトがハードウェアに対する厳格なニーズを解決するのに役立ちますが、モデルのトレーニング/反復にはデータのフィードを支援するための巨大なユーザー ターゲット (IP) も必要となることです。 **モデルのサイズが特定のしきい値を超えると、さまざまなタスクのパフォーマンスが画期的な成長を示します。

**3番目の問題は、中小規模のAIスタートアップチームがコーナーで追い抜くのが難しいことです。 **従来の金融市場におけるコンピューティングパワーの独占は、AIモデルソリューションの独占にもつながり、OPenAIやGoogle Deepmindなどに代表される大手AIモデルメーカーはさらに独自の外堀を築いています。中小規模の AI チームは、より差別化された競争を求める必要があります。

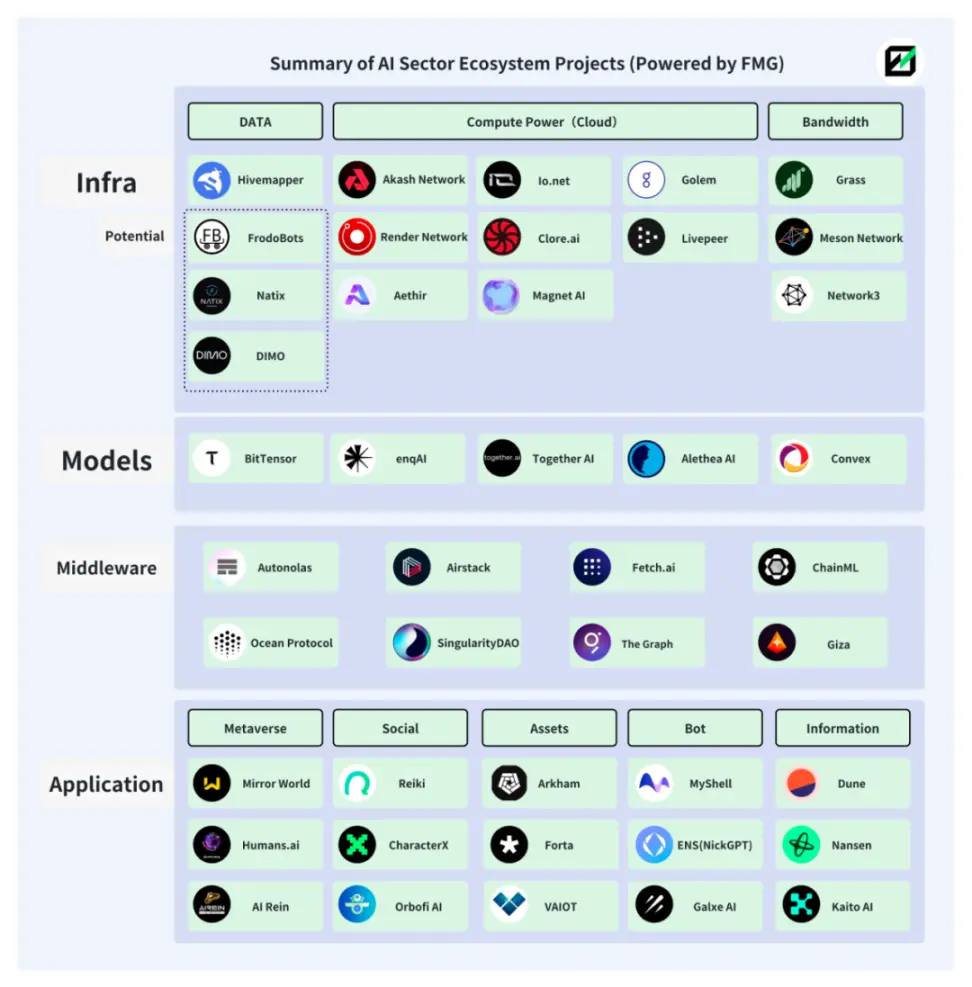

上記 3 つの質問に対する答えは、Web3 で見つけることができます。実際、AI と Web3 の組み合わせには長い歴史があり、エコシステムは比較的繁栄しています。

下の写真は、Future Money Group が作成した AI+Web3 エコシステムのトラックとプロジェクトの一部を示しています。

AI+デピン

1. DePIN のソリューション

DePINとは、分散型物理インフラストラクチャネットワークの略称であり、人と機器の間の生産関係の集合体でもあり、トークンエコノミクスとハードウェア機器(コンピュータ、車載カメラなど)の組み合わせにより、ユーザーと機器を有機的に結合します。同時に、経済モデルの秩序ある運用が達成されます。

より広義に定義される Web3 と比較して、DePIN はハードウェア デバイスや従来の企業と自然に深く関係しているため、オフサイトの AI チームや関連資金を引き付ける上で自然な利点があります。

DePIN エコシステムの分散コンピューティング能力の追求と貢献者へのインセンティブは、コンピューティング能力と IP に対する AI 製品のニーズを正確に解決します。

- DePINはトークンエコノミクスを利用して世界のコンピューティングパワー(コンピューティングパワーセンターとアイドル状態の個人コンピューティングパワー)の決済を促進し、コンピューティングパワーの一元化のリスクを軽減し、同時にAIのコンピューティングパワーを呼び出すコストを削減します。チーム。

- DePIN エコシステムの大規模で多様な IP 構成は、AI モデルがデータ取得チャネルの多様性と客観性を達成するのに役立ち、十分なデータプロバイダーが AI モデルのパフォーマンスの向上を保証することもできます。

- DePIN エコロジー ユーザーと Web3 ユーザーの間のポートレートの重複は、定着した AI プロジェクトが Web3 の特性を備えたより多くの AI モデルを開発し、従来の AI 市場では利用できない差別化された競争を形成するのに役立ちます。

Web2 分野では、AI モデルのデータ収集は通常、公開データセットから取得されるか、モデルメーカー自体によって収集されますが、これは文化的背景や地理的制限の影響を受け、AI モデルによって生成されるコンテンツに主観的な「歪み」を引き起こします。従来のデータ収集方法は収集効率とコストによって制限されており、より大きなモデル規模 (パラメーターの数、トレーニング時間、データ品質) を取得することが困難でした。 AIモデルの場合、モデルの規模が大きくなるほど、モデルの性能が定性的に変化しやすくなります。

出典:大規模言語モデルの新たな能力: 対処するように訓練されていない問題をどのように解決するのか?

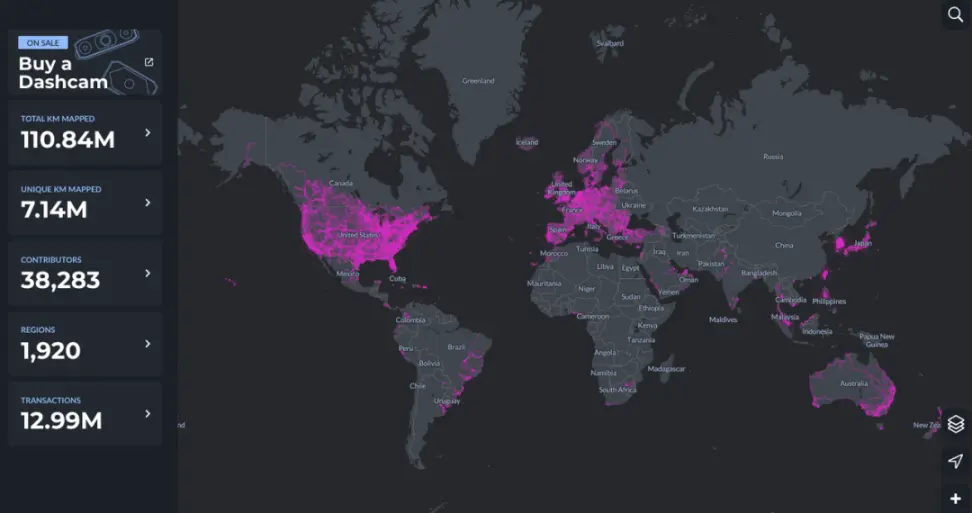

DePIN には、この分野において当然の利点があります。 Hivemapper を例に挙げると、Hivemapper は世界中の 1,920 地域に配布されており、40,000 人近くの貢献者が MAP AI (地図 AI モデル) にデータを提供しています。

AI と DePIN の組み合わせは、AI と Web3 の統合が新たなレベルに到達したことも意味します。現在、Web3 の AI プロジェクトはアプリケーション側で広く使用されており、Web2 インフラストラクチャへの直接的な依存がほとんど解消されておらず、従来のコンピューティング パワー プラットフォームに依存した既存の AI モデルが Web3 プロジェクトに埋め込まれています。関与することはほとんどありません。

Web3 要素は常に食物連鎖の下位に位置しており、実質的な超過収益を得ることができません。分散型コンピューティングパワープラットフォームについても同様であり、純粋な AI + コンピューティングパワーでは、その 2 つの可能性を真に引き出すことはできません。この関係では、コンピューティングパワープロバイダーはより多くの超過利益を得ることができず、生態学的構造が単純すぎるため、それは不可能です。トークンエコノミクスを利用してフライホイールを動かす。

しかし、AI+DePIN の概念は、この固有の関係を打ち破り、Web3 の注目をより広範な AI モデルに移しています。

2. AI+DePIN プロジェクトの概要

DePIN には、AI が緊急に必要とする機器 (コンピューティング能力、帯域幅、アルゴリズム、データ)、ユーザー (モデルトレーニングデータプロバイダー)、およびエコシステム内のインセンティブメカニズム (トークンエコノミクス) が当然備わっています。

AIに完全な客観的条件(計算能力/帯域幅/データ/IP)を提供し、AIモデル(トレーニング/推論/微調整)シナリオを提供し、トークンエコノミクスを備えたプロジェクトを大胆に定義できます。 AI+DePINです。

Future Money Group は、AI+DePIN の古典的なパラダイムを以下に列挙して整理します。

リソース提供の種類に応じて、コンピューティング能力、帯域幅、データ、およびその他のセクターの 4 つのセクターに分け、異なるセクターのプロジェクトを整理することを試みました。

2.1 計算能力

コンピューティングパワーエンドはAI+DePINセクターの主要なコンポーネントであり、現在最も多くのプロジェクトが存在する部分でもあります。コンピューティング能力プロジェクトの場合、コンピューティング能力の主なコンポーネントは、GPU (グラフィックス プロセッシング ユニット)、CPU (中央演算処理装置)、および TPU (プロフェッショナル機械学習チップ) です。このうちTPUは製造難易度が高いため主にGoogleが製造しており、外部のクラウドコンピューティング電源リースサービスのみを提供しているため市場規模は小さい。 GPU は CPU に似たハードウェア コンポーネントですが、よりプロフェッショナルです。通常の CPU よりも効率的に、並列実行される複雑な数学演算を処理できます。 GPU は元々、ゲームやアニメーションのグラフィック レンダリング タスクを処理するために設計されましたが、現在ではそれ以外の用途にも使用されています。したがって、GPU は現在、コンピューティング能力市場の主要な供給源となっています。

そのため、GPUの特性上、演算能力の観点から見るとAI+DePINプロジェクトの多くはグラフィックスやビデオレンダリング、あるいはそれに関連するゲームに特化したものとなっています。

全体的な観点から見ると、AI+DePIN 製品のコンピューティング能力の主なプロバイダーは、従来のクラウド コンピューティング パワー サービス プロバイダー、アイドル状態の個人コンピューティング能力、および自己所有のコンピューティング能力の 3 つの部分で構成されます。その中で、クラウド コンピューティング パワー サービス プロバイダーが最大のシェアを占め、次にアイドル状態の個人コンピューティング パワーが続きます。これは、そのような製品がコンピューティングパワーの仲介者として機能することが多いことを意味します。需要側には、さまざまな AI モデル開発チームがいます。

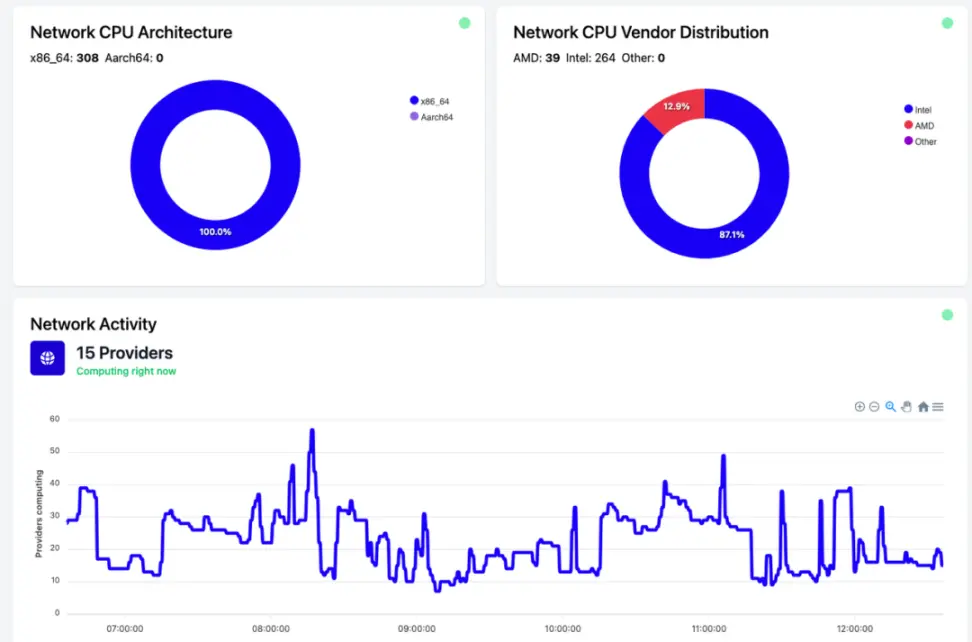

現在、このカテゴリでは、コンピューティング能力を実際に 100% 使用することはほとんどできず、アイドル状態になることが多くなります。たとえば、Akash Network では、現在コンピューティング能力の約 35% が使用されており、残りのコンピューティング能力はアイドル状態です。 io.net でも同様の状況です。

これは、現在の AI モデルのトレーニング要件が少ないためである可能性があり、AI + DePIN が安価なコンピューティング電力コストを提供できる理由でもあります。今後AI市場が拡大するにつれて、この状況は改善されるでしょう。

Akash Network: 分散型ピアツーピア クラウド サービス市場

Akash Network は、クラウド サービスの Airbnb とも呼ばれる、分散型のピアツーピア クラウド サービス マーケットプレイスです。 Akash Network を使用すると、あらゆる規模のユーザーと企業がサービスを迅速、安定して、手頃な価格で利用できるようになります。

Render と同様に、Akash も GPU の導入、リース、AI モデルのトレーニングなどのサービスをユーザーに提供します。

2023 年 8 月、Akash はスーパークラウドを開始しました。これにより、開発者は AI モデルの展開に支払ってもよい価格を設定できるようになり、追加のコンピューティング能力を持つプロバイダーはユーザーのモデルをホストできるようになります。この機能は Airbnb に非常に似ており、プロバイダーが未使用の容量をレンタルできるようになります。

公開入札を通じて、リソース プロバイダーはネットワーク内の遊休コンピューティング リソースを開放することが奨励され、Akash Network はリソースのより効率的な利用を実現し、リソース需要者により競争力のある価格を提供します。

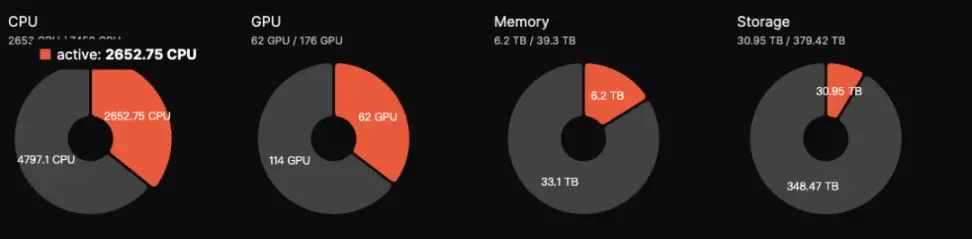

現在、Akash エコシステムの GPU の総数は 176 個ですが、アクティブな GPU の数は 62 個で、アクティビティ レベルは 35% で、2023 年 9 月の 50% レベルよりも低いです。推定一日当たりの収入は約5,000ドルです。 AKTトークンにはステーキング機能があり、ユーザーはトークンをステーキングすることでネットワークセキュリティの維持に参加することができ、年率約13.15%のリターンを得ることができます。

AI+DePIN 分野における Akash の現在のデータ パフォーマンスは比較的高く、その 7 億ドルの FDV には Render や BitTensor と比較して成長の余地が大きくあります。

Akash は開発スペースを拡大するために BitTensor のサブネットにもアクセスしました。全体として、Akash のプロジェクトは、AI+DePIN トラック上のいくつかの高品質プロジェクトの 1 つとして、優れた基本的なパフォーマンスを備えています。

io.net: 最大数の GPU を備えた AI+DePIN

io.net は、Solana ブロックチェーン上の ML (機械学習) アプリケーションの開発、実行、スケーリングをサポートする分散型コンピューティング ネットワークであり、世界最大の GPU クラスターを活用して、機械学習エンジニアが集中型サービスと同等のサービスを実行できるようにします。クラウド サービスのコンピューティング能力をわずかなコストで実現します。

公式データによると、io.net には 100 万個を超える GPU がスタンバイ状態にあります。さらに、io.net と Render のコラボレーションにより、展開に利用できる GPU リソースも拡張されます。

io.net エコシステムには多数の GPU が存在しますが、そのほとんどはさまざまなクラウド コンピューティング メーカーとの連携や個人ノードへのアクセスから来ており、アイドル率が高く、その中で最も数が多い RTX A6000 を例に挙げると、 8,426 個の GPU のうち、使用されているのは 11% (927) のみで、それ以上の GPU モデルはほとんど未使用です。しかし、io.net 製品の現在の主な利点の 1 つは価格が安いことであり、Akash の GPU 呼び出しコストが 1 時間あたり 1.5 米ドルであるのに比べ、io.net の最低コストは 0.1 ~ 1 米ドルの間です。

将来的には、io.net は、IO エコシステム内の GPU プロバイダーがネイティブ資産を抵当に入れることで使用できる可能性を高めることも検討します。投資する資産が多ければ多いほど、選ばれる可能性が高くなります。同時に、ネイティブ資産を誓約している AI エンジニアも高性能 GPU を使用できます。

GPU アクセスの規模という点では、この記事に挙げた 10 件のプロジェクトの中で io.net が最大です。アイドル率に加えて、GPUの使用数も第1位となっている。トークンエコノミクスの観点からは、io.net ネイティブ トークンとプロトコル トークン IO が 2024 年の第 1 四半期に開始され、最大供給量は 2,230 万個となります。ユーザーには、ネットワークの使用に対して 5% の料金が請求されます。これは、IO トークンの書き込みに使用されるか、供給側と需要側の両方で新規ユーザーにインセンティブを提供するために使用されます。トークン モデルには明らかなプルアップ特性があるため、io.net はコインを発行していませんが、市場は非常に人気があります。

ゴーレム: CPU ベースのコンピューティング能力市場

Golem は、共有リソースのネットワークを作成することで、誰でもコンピューティング リソースを共有および集約できる分散型コンピューティング電力市場です。 Golem はユーザーにコンピューティング能力のレンタル シナリオを提供します。

Golem 市場は、コンピューティング パワーの供給者、コンピューティング パワーの需要者、ソフトウェア開発者の 3 者で構成されています。コンピューティング能力の要求者がコンピューティング タスクを送信し、Golem ネットワークがそのコンピューティング タスクを適切なコンピューティング パワーの供給者 (RAM、ハードディスク スペース、CPU コアなどを提供) に割り当てます。コンピューティング タスクが完了した後、両当事者は支払いを行い、トークンによる決済。

Golem は主にパワー スタッキングの計算に CPU を使用しますが、コストは GPU よりも低くなります (Inter i9 14900k のコストは約 700 ドル、A100 GPU のコストは 12,000 ~ 25,000 ドル)。ただし、CPU は同時実行性の高い操作を実行できず、より多くのエネルギーを消費します。したがって、CPU を使用して計算能力を借りるという物語は、GPU プロジェクトの物語よりもわずかに弱いかもしれません。

Magne AI: AI モデルの資産化

Magnet AI は、GPU コンピューティング パワー プロバイダーを統合することにより、さまざまな AI モデルの開発者にモデル トレーニング サービスを提供します。他の AI+DePIN 製品とは異なり、Magent AI を使用すると、さまざまな AI チームが独自のモデルに基づいて ERC-20 トークンを発行でき、ユーザーはさまざまなモデル インタラクションに参加することで、さまざまなモデル トークンのエアドロップや追加の報酬を取得できます。

2024 年の第 2 四半期に、Magent AI が Polygon zkEVM および Arbrium でリリースされる予定です。

io.net と同様に、GPU コンピューティング能力の統合に重点を置き、AI チームにモデル トレーニング サービスを提供します。

違いは、io.net が GPU リソースの統合により重点を置いており、さまざまな GPU クラスター、企業、個人が GPU に貢献しながら、コンピューティング能力によって駆動される報酬を受け取ることを奨励していることです。

Magent AIはAIモデルにより重点を置いているようで、AIモデルトークンの存在により、トークンやエアドロップを中心としたユーザーの集客・維持を完了し、AIモデルを活用することでAI開発者の参入を促進する可能性がある。

簡単な概要: Magnet は GPU を使用して市場を構築することに相当します。AI 開発者またはモデル展開者は、その上で ERC-20 トークンを発行できます。ユーザーは、異なるトークンを取得したり、異なるトークンを積極的に保持したりできます。

レンダリング: グラフィック レンダリング AI モデル プロ プレーヤー

Render Network は、ブロックチェーン テクノロジーを通じてクリエイターとアイドル状態の GPU リソースを接続し、ハードウェアの制限を排除し、時間とコストを削減すると同時に、デジタル著作権管理を提供してメタバース開発をさらに促進することを目的とした、分散型 GPU ベースのレンダリング ソリューション プロバイダーです。

Render ホワイトペーパーによると、アーティスト、エンジニア、開発者は、Render に基づいて、AI 支援の 3D コンテンツ生成、システム全体の AI アクセラレーションによるレンダリング、Render の 3D シーン グラフの使用など、一連の AI アプリケーションを作成できます。関連する AI モデルのトレーニング用のデータ。

Render は、AI 開発者向けに Render Network SDK を提供します。AI 開発者は、Render の分散 GPU を活用して、NeRF (Neural Reflection Field) および LightField レンダリング プロセスから生成 AI タスクまでの AI コンピューティング タスクを実行できます。

Global Market Insights のレポートによると、世界の 3D レンダリング市場は 60 億米ドルに達すると予想されています。 FDV の 22 億米ドルの Render と比較すると、まだ開発の余地があります。

現在、GPU ベースの Render の具体的なデータは見つかりませんが、Render の背後にある OTOY 社が Apple との関係を何度か示しているため、その広範なビジネスと相まって、OTOY のスター レンダラである OctaneRender は VFX、ゲーム、モーション デザインをサポートしています。 、Unity3D および Unreal エンジンのネイティブ サポートを含む、建築の視覚化とシミュレーションのための業界をリードするすべての 3D ツールセット。

Google と Microsoft も RNDR ネットワークに参加します。 Render は 2021 年に約 250,000 件のレンダリング リクエストを処理し、エコシステム内のアーティストは NFT を通じて約 50 億ドルの売上を生み出しました。

したがって、Render の参考評価額は、パン レンダリング市場の可能性 (約 300 億米ドル) と比較される必要があります。 BME (Burning and Minting Balance) 経済モデルと組み合わせることで、Render には純粋なトークン価格や FDV に関係なく、まだ成長の余地があります。

Clore.ai: ビデオ レンダリング

Clore.ai は、GPU コンピューティング電力レンタル サービスを提供する PoW ベースのプラットフォームです。ユーザーは、AI トレーニング、ビデオ レンダリング、暗号通貨マイニングなどのタスク用に独自の GPU をレンタルでき、他のユーザーはこの能力を低価格で入手できます。

ビジネス範囲には、人工知能トレーニング、映画レンダリング、VPN、暗号通貨マイニングなどが含まれます。特定のコンピューティング パワー サービスの需要がある場合、ネットワークによって割り当てられたタスクは完了します。コンピューティング パワー サービスの需要がない場合、ネットワークはその時点で最も高いマイニング収量を持つ暗号通貨を見つけてマイニングに参加します。

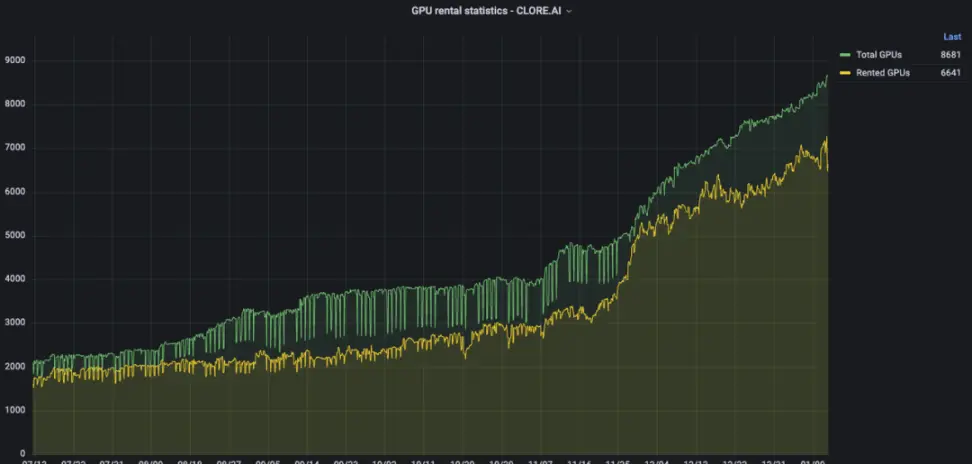

過去 6 か月で、Clore.ai の GPU の数は 2,000 から約 9,000 に増加しましたが、GPU 統合の数という点では、Clore.ai は Akash を上回っています。しかし、流通市場の FDV は Akash の約 20% に過ぎません。

トークンモデルに関しては、CLOREはプレマイニングやICOを行わないPOWマイニングモードを採用しており、各ブロックの50%がマイナーに、40%がリース者に、10%がチームに割り当てられます。

トークンの総数は 13 億で、マイニングは 2022 年 6 月に開始され、基本的に 2042 年までに完全な流通に入る予定です。 2023年末の流通供給量は約2億5,000万枚となり、トークン総供給量の20%を占める見通しだ。したがって、現在の実際の FDV は 3,100 万米ドルです。理論的には、Clore.ai は非常に過小評価されています。しかし、そのトークンエコノミクスにより、マイナー割り当て比率は 50% であり、マイニング、販売、撤退の比率が高すぎるため、通貨価格は上昇する可能性がより大きくなります。

Livepeer: ビデオ レンダリング、推論

Livepeer はイーサリアムをベースにした分散型ビデオ プロトコルで、ビデオ コンテンツを合理的な価格で安全に処理する当事者に報酬を与えます。

関係者によると、Livepeer には数千の GPU リソースがあり、毎週数百万分のビデオをトランスコーディングしています。

Livepeer は、「メインネット」+「サブネット」アプローチを採用することができ、さまざまなノード オペレーターがサブネットを生成し、Livepeer メインネット上で支払いを現金化することでこれらのタスクを実行できるようになります。たとえば、AI ビデオ サブネットは、特にビデオ レンダリングの分野における AI モデルのトレーニングのために導入されています。

Livepeer は後に、単純なモデルのトレーニングから推論と微調整まで、AI 関連の部分を拡張します。

Aethir: クラウド ゲームと AI に焦点を当てる

Aethir は、ゲームおよび人工知能企業向けに特別に構築された分散型クラウド インフラストラクチャ (DCI) を備えたクラウド ゲーム プラットフォームです。これにより、プレーヤーに代わって重い GPU コンピューティング負荷が分散され、ゲーマーはどこでも、どのデバイスでも超低遅延のエクスペリエンスを確実に得ることができます。

同時に、Aethir は、GPU、CPU、ディスク、その他の要素を含む導入サービスも提供します。 2023 年 9 月 27 日、Aethir はクラウド ゲームと AI コンピューティング能力の商用サービスを世界中の顧客に正式に提供し、分散型コンピューティング能力を統合して、独自のプラットフォームでゲームと AI モデルのコンピューティング能力サポートを提供しました。

クラウド ゲームは、レンダリングのコンピューティングに必要なコンピューティング能力をクラウドに転送することで、端末デバイスのハードウェアとオペレーティング システムの制限を排除し、潜在的なプレイヤー ベースを大幅に拡大します。

2.2 帯域幅

帯域幅は、DePIN が AI に提供するリソースの 1 つであり、世界の帯域幅市場は 2021 年に 500 億米ドルを超え、2027 年には 1,000 億米ドルを超えると予測されています。

AI モデルの数と複雑さが増加しているため、モデルのトレーニングでは通常、データ並列処理、パイプライン並列処理、テンソル並列処理などのさまざまな並列コンピューティング戦略が採用されています。これらの並列コンピューティング モードでは、複数のコンピューティング デバイス間の集合的な通信操作の重要性がますます高まっています。したがって、大規模な AI モデル用の大規模なトレーニング クラスターを構築する場合、ネットワーク帯域幅の役割が顕著になります。

さらに重要なのは、安定して信頼性の高い十分な帯域幅リソースがあれば、異なるノード間の同時応答が保証され、単一制御点の出現を技術的に回避できます (たとえば、Falcon は遅延と帯域幅を求めるために低遅延 + 高帯域幅のリレー ネットワーク モデルを使用しています)ニーズ)を考慮し、最終的にはネットワーク全体が信頼でき、検閲に耐性があることを保証します。

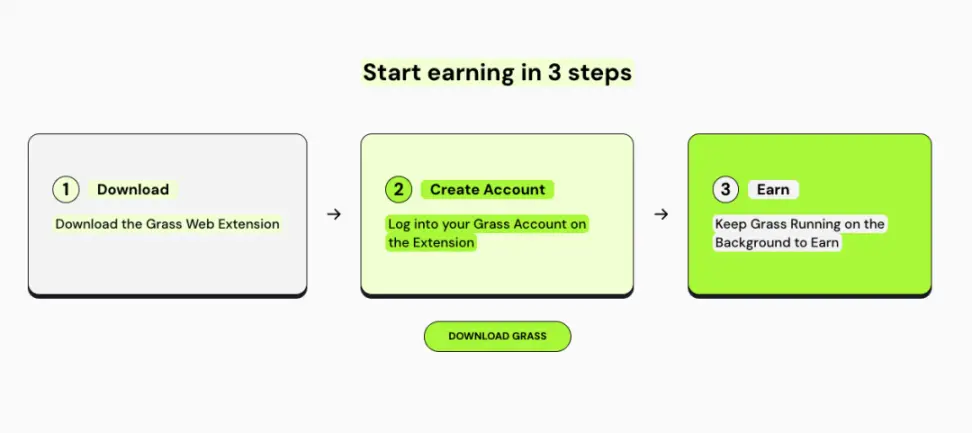

Grass: モバイル互換の帯域幅マイニング製品

Grass は、オープン ネットワーク データに焦点を当てている Wynd Network の主力製品であり、2023 年に 100 万米ドルの資金を調達しました。 Grass を使用すると、ユーザーは未使用のネットワーク リソースを販売することで、インターネット接続から受動的収入を得ることができます。

ユーザーは Grass 上でインターネット帯域幅を販売し、帯域幅サービスを必要とする AI 開発チームに提供し、AI モデルのトレーニングを支援し、トークンのリターンを得ることができます。

現在、Grass はモバイル版を立ち上げようとしていますが、モバイル版と PC 版では IP アドレスが異なるため、Grass ユーザーは同時により多くの IP アドレスをプラットフォームに提供し、Grass はより多くの IP アドレスを収集してプラットフォームに提供することになります。 AI モデルのトレーニングを提供すると、データ効率が向上します。

現在、Grass には IP アドレスを提供する方法が 2 つあります。PC ダウンロード拡張プログラムとモバイル APP ダウンロードです。 (PCとモバイル端末は別ネットワーク上にある必要があります)

2023 年 11 月 29 日の時点で、Grass プラットフォームには 103,000 のダウンロードと 1,450,000 の一意の IP アドレスがあります。

モバイル端末とPC端末ではAIに対する要求が異なるため、適用できるAIモデルのトレーニングカテゴリが異なります。

たとえば、モバイル端末には、画像の最適化、顔認識、リアルタイム翻訳、音声アシスタント、デバイスのパフォーマンスの最適化などに関する大量のデータが含まれています。これらをPC側で提供するのは困難です。

現在、Grass はモバイル AI モデルのトレーニングにおいて比較的先駆的な立場にあります。現在世界中でモバイル市場が持つ大きな可能性を考えると、グラス氏の将来性は注目に値する。

ただし、グラス氏は AI モデルに関するより有効な情報をまだ提供しておらず、初期段階ではコインのマイニングが単に主な動作モードである可能性があると推測されています。

Meson Network: モバイル端末と互換性のあるレイヤー 2

Meson Network は、ブロックチェーン レイヤ 2 に基づく次世代ストレージ アクセラレーション ネットワークであり、マイニングを通じてアイドル状態のサーバーを集約し、帯域幅リソースをスケジュールし、従来の Web サイト、ビデオ、ライブ ブロードキャスト、ブロックなどのファイルおよびストリーミング メディア アクセラレーション マーケットにサービスを提供します。ストレージソリューション。

中間子ネットワークは帯域幅リソースのプールとして理解でき、プールの両側は供給側と需要側とみなすことができます。前者は帯域幅に貢献し、後者は帯域幅を使用します。

Meson の特定の製品構造では、2 つの製品 (GatewayX、GaGaNode) が世界中のさまざまなノードから提供される帯域幅の受信を担当し、1 つの製品 (IPCola) がこれらの集約された帯域幅リソースの収益化を担当します。

GatewayX: 主に商用アイドル帯域幅を統合し、主に IDC センターをターゲットにします。

Meson のデータ ダッシュボードから、現在接続されている IDC には世界中で 20,000 以上のノードがあり、12.5Tib/s のデータ伝送容量があることがわかります。

GaGaNode: 主に住宅用デバイスと個人用デバイスのアイドル帯域幅を統合し、エッジ コンピューティングの支援を提供します。

IPCola: Meson の収益化チャネル。IP や帯域幅の割り当てなどのタスクを実行します。

現在、Meson は半期の収益が 100 万米ドルを超えていることを明らかにしました。公式ウェブサイトの統計によると、Meson には 27,116 個の IDC ノードがあり、IDC 容量は 17.7TB/s です。

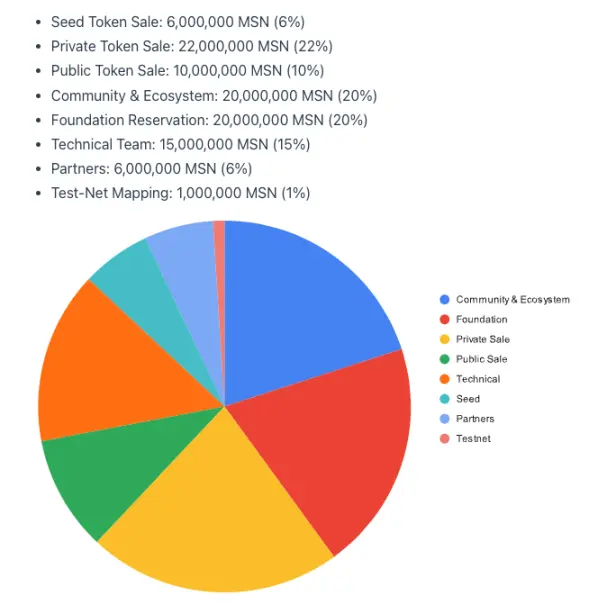

Mesonは現在、2024年3月から4月にトークンを発行する予定ですが、トークンエコノミクスを発表しました。

トークン名: MSN、初期供給量 1 億、初年度のマイニングインフレ率は 5%、毎年 0.5% ずつ減少します。

ネットワーク 3: Sei Network と統合

Network3 は、専用の AI レイヤー 2 を構築し、sei と統合した AI 企業です。 AI モデルのアルゴリズムの最適化と圧縮、エッジ コンピューティング、プライバシー コンピューティングを通じて、当社は世界中の AI 開発者にサービスを提供し、開発者が大規模なモデルを迅速、便利、効率的にトレーニングおよび検証できるよう支援します。

公式 Web サイトのデータによると、Network3 には現在 58,000 を超えるアクティブ ノードがあり、2PB の帯域幅サービスを提供しています。 Alchemy Pay、ETHSign、IoTeX を含む 10 のブロックチェーン エコシステムと連携。

2.3 データ

コンピューティング能力や帯域幅とは異なり、データ供給には現在、比較的ニッチな市場があります。そして独特のプロ意識を持っています。需要グループは通常、プロジェクト自体、または関連するカテゴリの AI モデル開発チームです。ハイブマッパーなど。

独自のデータをフィードして独自のマップ モデルをトレーニングするこのパラダイムには論理的な困難はないため、DIMO、Natix、FrodoBots など、Hivemapper に似た DePIN プロジェクトに視野を広げることができます。

Hivemapper: 独自の Map AI 製品の強化に注力

HiveMapper は Solana の最上位の DePIN コンセプトの 1 つであり、分散型の「Google マップ」の作成に取り組んでいます。ユーザーは、HiveMapperが提供するドライブレコーダーを購入し、HiveMapperでリアルタイム画像を利用・共有することでHONEYトークンを取得できます。

Hivemapperについては、かつてFuture Money Groupが「FMG Research Report: 30日間で19倍増加、Hivemapperに代表される自動車DePIN業界を理解する」で詳しく解説しているが、ここでは触れない。 AI+DePINセクションにHivemapperが含まれているのは、Hivemapperがドライブレコーダーで収集したデータを基に高品質な地図データを生成できるAI地図生成エンジン「MAP AI」を開始したためです。

Map AI には、AI トレーナーという新しい役割が導入されています。この役割には、以前のドライブ レコーダー データ提供者と Map AI モデル トレーナーが含まれます。

Hivemapper は、AI モデル トレーナーの要件に意図的に特化しておらず、代わりに、より多くの IP アドレスが参加できるように、リモート タスク、地理的位置の推測、その他の同様のゲーム動作などの低い参加閾値を採用しています。 DePIN プロジェクトの IP リソースが豊富であればあるほど、AI によるデータ取得の効率は高まります。 AIトレーニングに参加したユーザーは、HONEYトークンの報酬も受け取ることができます。

Hivemapper の AI のアプリケーション シナリオは比較的ニッチであり、Hivemapper はサードパーティ モデルのトレーニングをサポートしていません。Map AI の目的は、独自の地図製品を最適化することです。したがって、Hivemapper の投資ロジックは変更されません。

### 潜在的

DIMO: 車の内部データを収集

DIMO は、Polygon 上に構築された自動車 IoT プラットフォームで、ドライバーが車両の走行距離、走行速度、位置追跡、タイヤの空気圧、バッテリー/エンジンの状態などを含む車両データを収集して共有できるようにします。

DIMO プラットフォームは車両データを分析することで、いつメンテナンスが必要になるかを予測し、ユーザーに迅速に警告することができます。ドライバーは自分の車両について深い知識を得ることができるだけでなく、DIMO エコシステムにデータを提供し、報酬として DIMO トークンを受け取ることもできます。データ利用者はプロトコルからデータを抽出して、バッテリー、自動運転システム、制御などのコンポーネントのパフォーマンスを理解できます。

Natix: プライバシーを強化した地図データ収集

Natix は、AI プライバシー特許を使用して構築された分散型ネットワークです。 AIプライバシー特許に基づいて、プライバシーコンプライアンスを前提としたデータ収集と分散ダイナミックマップの分析を行いながら、世界とカメラデバイス(スマートフォン、ドローン、自動車)を組み合わせて中型セキュリティカメラネットワークを構築することを目指しています(DDMap)。コンテンツの充填用。

データ提供に参加したユーザーは、インセンティブとしてトークンやNFTを受け取ることができます。

FrodoBots: ロボットに基づく分散型ネットワーク アプリケーション

FrodoBots は、モバイル ロボットをキャリアとして使用し、カメラを通じて衝撃データを収集し、特定の社会的属性を備えた DePIN ゲームです。

ユーザーはロボットを購入することでゲームのプロセスに参加し、世界中のプレイヤーと交流します。同時に、ロボット自身のカメラも道路と地図のデータを収集し、要約します。

上記 3 つのプロジェクトはいずれもデータ収集と知財提供という 2 つの要素を備えており、関連する AI モデルのトレーニングはまだ実施していませんが、いずれも AI モデルの導入に必要な条件を提供しています。 Hivemapper を含むこれらのプロジェクトでは、データを収集して完全なマップを形成するためにカメラが必要です。したがって、適応される AI モデルも地図構築に重点を置いた領域に限定されます。 AI モデルの強化は、プロジェクトがより高い堀を築くのに役立ちます。

注意が必要なのは、カメラの収集では、双方向のプライバシー侵害などの規制上の問題に遭遇することが多いことです。たとえば、外部カメラが外部画像を収集する場合の通行人の肖像権の定義や、ユーザーが自分の画像を重視することなどです。プライバシー。たとえば、Natix はプライバシー保護のために AI を運用しています。

2.4 アルゴリズム

コンピューティング能力、帯域幅、データはリソースの差別化に重点を置き、アルゴリズムは AI モデルに重点を置きます。この記事では BitTensor を例に挙げます. BitTensor はデータや計算能力に直接貢献しません. 代わりに, ブロックチェーン ネットワークとインセンティブ メカニズムを通じてさまざまなアルゴリズムをスケジュールおよびスクリーニングすることで、AI 分野が自由な競争とモデル市場を形成できるようにします知識共有。

OpenAI と同様に、BitTensor は、モデルの分散特性を維持しながら、従来のモデルの巨人に匹敵する推論パフォーマンスを達成することを目指しています。

アルゴリズムトラックはやや高度であり、同様のプロジェクトはまれです。 AI モデル、特に Web3 ベースのモデルが登場すると、モデル間の競争が常態化します。

同時に、モデル間の競争により、AI モデル業界の下流における推論と微調整の重要性も高まります。 AI モデルのトレーニングは AI 業界の上流にすぎません。モデルは最初にトレーニングされ、初期知能が必要です。これに基づいて、より慎重なモデルの推論と調整 (最適化として理解できます) が、その前にモデルに対して実行されます。最終的に完成品として使用できるようになり、エッジに導入されます。これらのプロセスには、より複雑なエコロジー アーキテクチャとコンピューティング能力のサポートが必要です。それはまた、潜在的な発展の可能性が非常に大きいことを意味します。

BitTensor: AI モデル オラクル

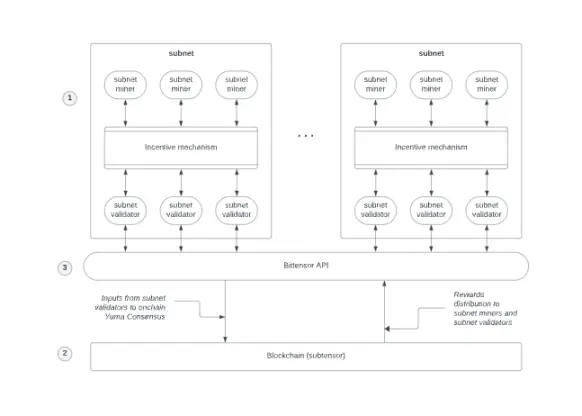

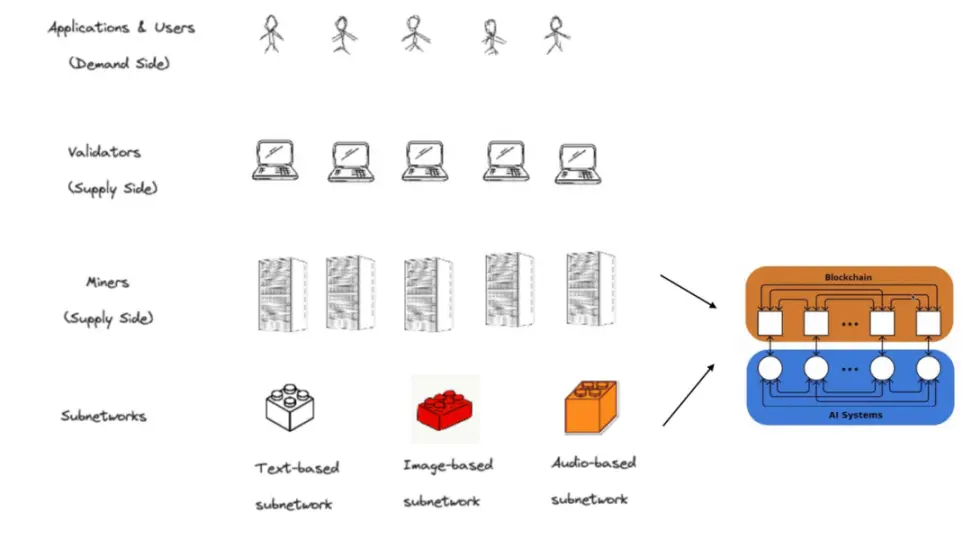

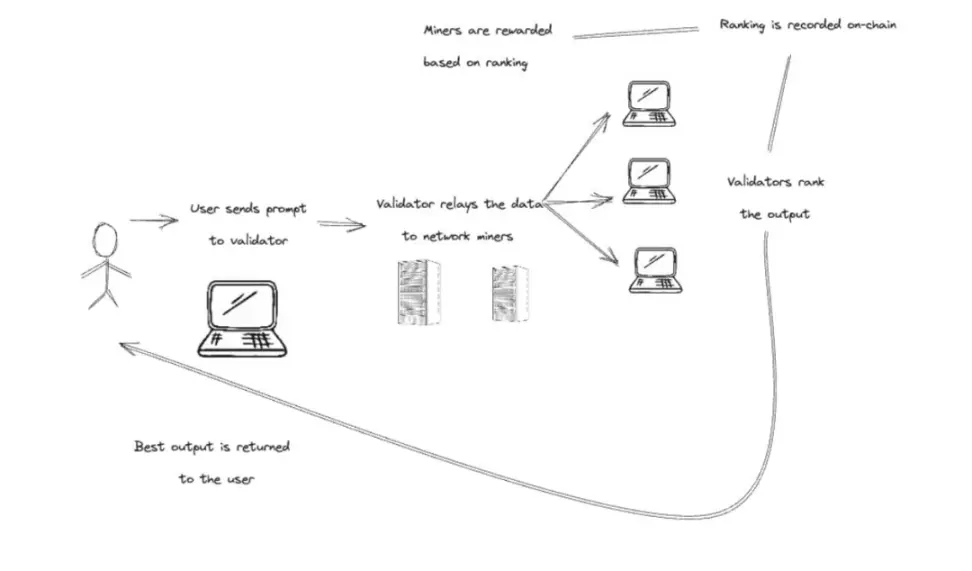

BitTensor は、Polkadot メインネット + サブネットに似たアーキテクチャを備えた分散型機械学習エコシステムです。

動作ロジック: サブネットはアクティビティ情報を Bittensor API (オラクルに似た役割) に送信し、その後 API が有用な情報をメイン ネットワークに送信し、メイン ネットワークが報酬を配布します。

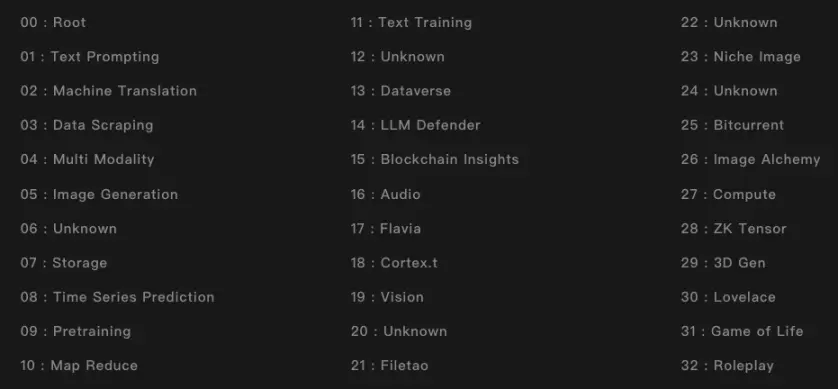

BitTensor 32 サブネット

BitTensor エコシステム内での役割:

- マイナー: 世界中のさまざまな AI アルゴリズムとモデルのプロバイダーとして理解できます。彼らは AI モデルをホストし、Bittensor ネットワークに提供します。異なるタイプのモデルは異なるサブネットを形成します。

- Validator: Bittensor ネットワーク内の評価者。 AI モデルの品質と有効性を評価し、特定のタスクのパフォーマンスに基づいて AI モデルをランク付けし、消費者が最適なソリューションを見つけられるように支援します。 ※ユーザー:Bittensorが提供するAIモデルのエンドユーザー。それは個人である場合もあれば、アプリケーションに AI モデルを使用しようとしている開発者である場合もあります。

- ノミネーター: トークンを特定のバリデーターに委任してサポートを示すか、トークンを別のバリデーターに委任できます。

オープンな AI の供給と需要のチェーン: さまざまなモデルを提供する人、さまざまなモデルを評価する人、そして最適なモデルによって提供される結果を使用する人もいます。

「コンピューティングパワーの仲介者」に似た役割を果たすAkashやRenderとは異なり、BitTensorはより「労働市場」に近く、モデルをより合理的なものにするために既存のモデルを使用してより多くのデータを吸収します。マイナーとバリデーターは、どちらかというと「建設当事者」と「監督者」に似ています。ユーザーが質問し、マイナーが回答を出力し、検証者が回答の品質を評価して、最終的に回答をユーザーに返します。

BitTensor トークンは TAO です。 TAO の時価総額は現在 RNDR に次ぐ第 2 位ですが、4 年で半減するという長期リリースメカニズムにより、完全希薄化価額に対する時価総額の比率はいくつかのプロジェクトの中で最も低く、これは TAO の全体の流通量が現時点で最も低いことを意味します。比較的小さく、安いですが単価は高めです。これは、TAO の実際の価値が過小評価されていることを意味します。

現時点では適切な評価目標を見つけることは難しいが、構造的類似性から出発し、ポルカドット(約120億米ドル)を基準対象とすれば、TAOには8倍近い成長余地がある。

「オラクル」属性に従い、Chainlink(140億ドル)を参考にすると、TAOは9倍近く増加しています。

ビジネスの類似性と OpenAI (Microsoft から約 300 億米ドルを受け取った) を参考にすると、TAO のハードトップの上昇率は約 20 倍になる可能性があります。

## 結論は

全体として、AI+DePIN は Web3 の文脈における AI トラックのパラダイム シフトを促進し、市場が「Web3 で AI に何ができるか?」という固有の考え方から飛び出して、「AI とは何か」を考えることができるようにします。 Web3 は、「何?」というより大きな疑問を世界にもたらすことができます。

NVIDIA CEO のジェンスン・ファンが、大規模な生成モデルのリリースを AI の「iPhone」の瞬間と呼ぶなら、AI と DePIN の組み合わせは、Web3 が真に「iPhone」の瞬間を到来させたことを意味します。

現実世界で最も受け入れられ成熟した Web3 のユースケースとして、DePIN は Web3 をより受け入れられるものにしています。

AI+DePIN プロジェクトでは IP ノードと Web3 プレーヤーが部分的に重複しているため、この 2 つの組み合わせは、業界が Web3 独自のモデルや AI 製品を作成するのにも役立ちます。これは、Web3 業界全体の発展に有益であり、AI モデルの推論と微調整、モバイル AI モデルの開発など、業界に新たな道を切り開くことになります。

興味深い点は、記事に記載されている AI+DePIN 製品にはパブリック チェーンの開発パスを組み込むことができるようだということです。これまでのサイクルでは、独自の TPS とガバナンス手法を使用してさまざまな開発者を引き付けるさまざまな新しいパブリック チェーンが出現しました。

同じことが現在の AI+DePIN 製品にも当てはまり、独自のコンピューティング能力、帯域幅、データ、IP の利点に基づいてさまざまな AI モデル開発者を魅了しています。したがって、現時点では、AI+DePIN 製品は同種の競争に偏る傾向があることがわかります。

この問題の鍵は、コンピューティング能力の量ではなく (これは非常に重要な前提条件ですが)、このコンピューティング能力をどのように使用するかです。現在のAI+DePINトラックはまだ「野蛮な成長」の初期段階にあるため、AI+DePINの将来のパターンと製品形態に大きな期待ができます。

参考資料

5._15398.html