TikTokとMetaは、アルゴリズムの軍拡競争に安全性を犠牲にして勝とうとしたと、内部告発者が語る============================================================================2時間前シェア保存マリアナ・スプリング、ソーシャルメディア調査特派員 兼マイク・ラドフォードシェア保存BBC/Getty images内部告発者は、TikTokの爆発的な成長に続くアルゴリズムの軍拡競争の内幕を明かしたソーシャルメディアの巨人たちは、内部調査でアルゴリズムが怒りを煽ることでエンゲージメントを高めていることを示した後、人々のフィードにより有害なコンテンツを増やす決定を下したと、告発者はBBCに語った。10人以上の内部告発者や関係者は、暴力、性的脅迫、テロなどの問題において、安全性よりもユーザーの注意を引くためにリスクを取った企業の実態を明らかにした。Meta(FacebookとInstagramを所有)のエンジニアは、TikTokと競争するために、より「境界線上」の有害コンテンツ—性差別や陰謀論を含む—をユーザーフィードに許可するよう上層部から指示されたと語った。「それは株価が下がっているからだと彼らは私たちに言った」とエンジニアは述べた。TikTokの社員は、BBCに対し、同社の内部ダッシュボードやユーザーからの苦情のデータにアクセスさせる貴重な情報を提供し、政治家に関するケースを優先するよう指示された一方で、子供を含む有害な投稿の報告には後回しにされていた証拠も示した。政治家との「良好な関係を維持する」ために決定がなされており、規制や禁止の脅威を避けるためだと、TikTokのスタッフは語った。BBCのドキュメンタリー『Inside the Rage Machine』に登場した告発者たちは、TikTokの爆発的な成長に続く業界の対応を間近で見てきた様子を詳述し、短動画推薦の高いエンゲージメントを持つアルゴリズムがソーシャルメディアを一変させ、競合他社が追いつくのに苦労していると指摘した。Metaの上級研究員マット・モティルは、TikTokの競合となるInstagram Reelsは2020年に十分な安全策なしで開始されたと述べた。BBCに共有された内部調査によると、Reelsのコメントにはいじめや嫌がらせ、ヘイトスピーチ、暴力や扇動の内容が他のInstagramの投稿よりも著しく多く見られるという。マット・モティルは、MetaがInstagram Reelsを十分な安全策なしで開始したと述べた同社はReelsの成長のために700人のスタッフを投入したが、安全チームには子供の保護や選挙の公正性を守るための専門スタッフ2人の採用を拒否したと、別の元Meta幹部は語った。モティルは、BBCに対し、「これらのプラットフォーム上のあらゆる害を示す高レベルの研究資料」を数十点提供した。その中には、Facebookが自社のアルゴリズムによる問題を認識していた証拠も含まれている。そのアルゴリズムは、コンテンツクリエイターに「利益を最大化しつつ視聴者の福祉を犠牲にする道」を提供し、「現在の経済的インセンティブは私たちのミッション—世界をより近づけること—と一致していない」と内部調査は示している。また、Facebookは「放置してファストフードを供給し続けることもできるが、それは長続きしない」とも述べている。告発者の主張に対し、Metaは「意図的に有害コンテンツを増幅させて利益を得ているという主張は誤りです」とコメントした。TikTokはこれらの主張を「捏造されたもの」とし、有害コンテンツが閲覧されるのを防ぐ技術に投資していると述べた。アルゴリズムは「ブラックボックス」で、その内部動作を詳しく調査するのは難しいと、2020年から2024年までTikTokの推薦エンジンを構築した機械学習エンジニアのルオファン・ディンは語る。彼は、「こうしたシステムを完全に安全に構築するのは難しい」と述べた。「深層学習アルゴリズム自体をコントロールできない」。投稿内容にはあまり注意を払わず、「すべてのコンテンツはただのID、異なる数字に過ぎない」と彼は言う。彼らはコンテンツ安全チームに依存して、有害な投稿がアルゴリズムによって促進されないように除去を確実にしているとし、その関係を車の各部品を担当するチームに例えた。「加速装置やエンジンを担当するチームがあるでしょう?だから、ブレーキシステムを担当するチームも良い仕事をしていると期待しています」と彼は述べた。しかし、TikTokが市場シェア拡大のためにほぼ毎週アルゴリズムを改善しようとする中で、彼は「境界線上」のコンテンツや問題のある投稿が増え始め、長時間動画を閲覧した後にだけ現れることに気づいた。境界線上のコンテンツとは、ソーシャルメディア企業内で一般的に使われる用語で、有害だが合法な投稿を指す。性差別、レイシズム、性的内容、陰謀論なども含まれる。ユーザーが問題のあるコンテンツを見たくないと示すシステムは機能しておらず、ティーンエイジャーたちはBBCに対し、暴力や憎悪に満ちたコンテンツが依然として推奨されていると語った。ある極端な例では、19歳のカルムは、14歳の頃から「アルゴリズムに洗脳された」と述べた。彼に表示されたコンテンツは彼を怒らせ、彼は人種差別や性差別的な見解を持つようになったという。カルムは14歳から「アルゴリズムに洗脳された」と語る「それらの動画は私を元気づけたけれど、良い意味ではなかった」と彼は言った。「ただ非常に怒りを感じさせるもので、自分の内面の感情と非常に一致していた。周囲の人々に対して怒りを感じていた」。英国の反テロ警察の専門家は、毎年何千もの投稿を分析し、最近数ヶ月で反ユダヤ主義、人種差別、暴力、極右の投稿の「正常化」を目の当たりにしていると語る。「人々は現実の暴力に対して鈍感になり、自分の意見を共有することを恐れなくなっている」と一人の警官は述べた。『TikTokを削除せよ』---------------2025年の数ヶ月間、BBCはTikTokの信頼と安全チームのメンバー(ニックと呼ぶ)と定期的に話をした。彼のノートパソコンには、彼の担当するケースや対応状況を示す社内ダッシュボードの画面を閲覧できた。「毎日指示されたことに罪悪感を感じているなら、いつか何かを言う決断をすべきかもしれない」とニックは語った。彼が評価していたケースの量は多すぎて、ユーザーの安全を守るには追いつかず、特にティーンエイジャーや子供たちが危険にさらされていると指摘した。削減や一部のモデレーションチームの再編成(AI技術に置き換えられる役割もある)により、こうしたコンテンツに効果的に対処する能力は制限されていると彼は述べた。「テロ、性的暴力、身体的暴力、虐待、人身売買に関する資料の増加が見られる」と告発者は語った。アプリが推奨し、対策を講じている有害コンテンツの実態は、「公に言われていることとかなり異なる」と付け加えた。ニックは、政治家に関する比較的些細なケースを優先して審査した例や、未成年者に関わる深刻なケースが低優先度(P2以下)に分類されている証拠も示した。イラクのケースについて、ニックは「この報告が出ている国は非常にリスクが高い。未成年者であり、性的脅迫に関わるものであり、優先度は高くない」と述べた。また、テログループへの参加や犯罪行為を促す投稿が最優先とされていない例も示した。信頼と安全のチームが若者に関わるケースを政治的ケースより優先するよう求めた際、彼らはそうしないよう指示され、与えられた順位に従って対応を続けるよう言われた。ニックは、最終的に企業は政治家や政府との「良好な関係」を維持することを優先し、規制や禁止を避けるために子供の安全よりも重視していると考えていると述べた。彼と他のスタッフがこれらの懸念を経営陣に伝えた際も、彼らは「日常的にこのコンテンツに触れていない」ため、あまり耳を貸さなかった。信頼と安全の担当者の親へのアドバイスは、「削除してください。できるだけ長くアプリから遠ざけてください」と非常に率直なものだった。TikTokは、政治的コンテンツが若者の安全より優先されているという考えを否定し、「根本的に誤った見解です」と述べた。ニックの所属するチームは、複数のチームからなる広範な安全システムの一部であり、コンテンツに関する苦情を審査する責任を持つ。TikTokは、「特定の問題に対する専門的なワークフローは、子供の安全ケースの優先順位を下げることにはつながらず、専任のチームが並行して審査しています」と説明した。TikTokのスポークスパーソンは、「TikTokが何百万人もの人々に新しい興味を発見させ、コミュニティを見つけ、クリエイター経済を支援している現実を無視している」と批判を否定した。同社は、ティーン向けアカウントには50以上の安全機能と設定が自動的に有効になっていると述べた。また、有害なコンテンツが閲覧されるのを防ぐ技術に投資し、厳格な推奨ポリシーを維持し、ユーザーが体験を調整できる機能も提供している。『追いつくためにできることをすべて』--------------------------------2020年、InstagramのReelsがTikTokに対抗して導入され、アルゴリズムの軍拡競争が激化した。2021年からFacebookとその後継会社Metaで上級研究員として働いたマット・モティルは、これがTikTokの「ユニークな製品」を模倣しようとした試みだったと述べた。彼の仕事は2019年から2023年まで、「何億人もの人々に対して大規模な実験を行う」ことで、コンテンツのランキング方法をテストしていた。多くの場合、「彼らはこれが行われていることに気づいていなかった」と語る。「Metaの製品は30億人以上に利用されており、長く使わせるほど広告を売り、収益を上げる。だからこそ、これを正しくやることが非常に重要だ。失敗すれば、非常に悪いことが起きる」と彼は言う。特にReelsについては、「できるだけ早く進める」ことが方針だったとし、「有害なコンテンツから人々を守ることとエンゲージメントのバランスを取る」という一般的なトレードオフがあったと述べた。彼が共有した研究資料によると、Reelsの投稿は、Instagramのメインフィードの投稿よりも有害なコメントの割合が高く、いじめや嫌がらせは75%、ヘイトスピーチは19%、暴力や扇動は7%高かった。彼は、「安全スタッフは、Reelsの担当チームの承認を得て新しい製品や機能を導入し、ユーザーの安全を向上させる必要があった」と指摘した。Reelsのスタッフは、「有害なコンテンツの方がエンゲージメントが高いため、それを防ぐ製品をリリースしないインセンティブがあった」と語る。Facebookが2016年に買収したソーシャルメディア監視ツールのクラウドテングを使った調査では、競争に対する過剰な警戒心も明らかになった。CEOのマーク・ザッカーバーグは、「競争の脅威を感じると、いくらお金を使っても構わない」と述べた。彼は、Reelsの拡大に伴い、安全チームが少人数のスタッフ採用の承認を得るのに苦労したと述べ、当時の状況を次のように振り返った。「700人のスタッフをInstagram Reelsに投入したとき、他のチームは『OK、わかった』と言っただけだ」と語った。Metaの元エンジニアであるティムは、TikTokと競争するために、より境界線上の有害コンテンツを許可したと述べた。彼のチームはこのコンテンツの削減に注力していたが、「ビジネスの立ち位置」が変わったことで方針が変わった。「TikTokに負けて株価が下がるのは避けられない。だからみんなパニックになり、追いつくために何でもやろうとした。次の四半期の収益のために2%、3%でも稼げるところを探した」と彼は語る。彼は、違法ではなくともユーザーが関与する可能性のあるコンテンツの制限をやめる決定は、ザッカーバーグに直接報告していると考えるMetaの上級副社長によって下されたと述べた。内部資料によると、Metaは、怒りや害を引き起こすコンテンツを増幅させていることを認識していたと明らかにしている。資料は、倫理的な信念に触れる内容や暴力を扇動する投稿など、敏感なコンテンツが反応やエンゲージメントを引き起こしやすいと指摘している。「この種のコンテンツは、過剰なエンゲージメントを引き起こすため、アルゴリズムはそれを好むと推測している」と記されている。Silvermanは、Metaのリーダーシップは最初、プラットフォーム上の有害なコンテンツにどう対応すべきか迷っていたと述べる。しかし、「次第に防御的な姿勢に変わった」とし、「社会の分極化のすべてに責任があるわけではないが、少なくとも一因ではある」と指摘した。「少しの変更を加えるだけで、分極化に対する寄与を減らせるかもしれない」とも述べた。Metaのスポークスパーソンは、告発者の主張を否定した。「私たちは、プラットフォーム上のユーザーを守るための厳格なポリシーを持ち、過去10年にわたり安全とセキュリティに大きく投資してきました」と述べた。また、「ティーンのオンライン保護のために新たな『ティーンアカウント』機能を導入し、保護と親が管理できるツールも整備しています」と説明した。_ロバート・ファーコア、デイジー・バタ、エズ・ロバーツによる追加取材_

TikTokとMetaは、アルゴリズム競争に勝つために安全性を危険にさらした、と内部告発者は言う

TikTokとMetaは、アルゴリズムの軍拡競争に安全性を犠牲にして勝とうとしたと、内部告発者が語る

2時間前

シェア保存

マリアナ・スプリング、ソーシャルメディア調査特派員 兼

マイク・ラドフォード

シェア保存

内部告発者は、TikTokの爆発的な成長に続くアルゴリズムの軍拡競争の内幕を明かした

ソーシャルメディアの巨人たちは、内部調査でアルゴリズムが怒りを煽ることでエンゲージメントを高めていることを示した後、人々のフィードにより有害なコンテンツを増やす決定を下したと、告発者はBBCに語った。

10人以上の内部告発者や関係者は、暴力、性的脅迫、テロなどの問題において、安全性よりもユーザーの注意を引くためにリスクを取った企業の実態を明らかにした。

Meta(FacebookとInstagramを所有)のエンジニアは、TikTokと競争するために、より「境界線上」の有害コンテンツ—性差別や陰謀論を含む—をユーザーフィードに許可するよう上層部から指示されたと語った。

「それは株価が下がっているからだと彼らは私たちに言った」とエンジニアは述べた。

TikTokの社員は、BBCに対し、同社の内部ダッシュボードやユーザーからの苦情のデータにアクセスさせる貴重な情報を提供し、政治家に関するケースを優先するよう指示された一方で、子供を含む有害な投稿の報告には後回しにされていた証拠も示した。

政治家との「良好な関係を維持する」ために決定がなされており、規制や禁止の脅威を避けるためだと、TikTokのスタッフは語った。

BBCのドキュメンタリー『Inside the Rage Machine』に登場した告発者たちは、TikTokの爆発的な成長に続く業界の対応を間近で見てきた様子を詳述し、短動画推薦の高いエンゲージメントを持つアルゴリズムがソーシャルメディアを一変させ、競合他社が追いつくのに苦労していると指摘した。

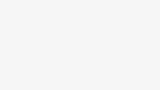

Metaの上級研究員マット・モティルは、TikTokの競合となるInstagram Reelsは2020年に十分な安全策なしで開始されたと述べた。BBCに共有された内部調査によると、Reelsのコメントにはいじめや嫌がらせ、ヘイトスピーチ、暴力や扇動の内容が他のInstagramの投稿よりも著しく多く見られるという。

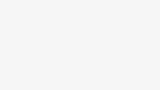

マット・モティルは、MetaがInstagram Reelsを十分な安全策なしで開始したと述べた

同社はReelsの成長のために700人のスタッフを投入したが、安全チームには子供の保護や選挙の公正性を守るための専門スタッフ2人の採用を拒否したと、別の元Meta幹部は語った。

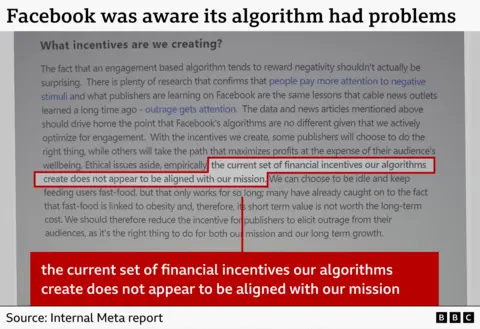

モティルは、BBCに対し、「これらのプラットフォーム上のあらゆる害を示す高レベルの研究資料」を数十点提供した。その中には、Facebookが自社のアルゴリズムによる問題を認識していた証拠も含まれている。

そのアルゴリズムは、コンテンツクリエイターに「利益を最大化しつつ視聴者の福祉を犠牲にする道」を提供し、「現在の経済的インセンティブは私たちのミッション—世界をより近づけること—と一致していない」と内部調査は示している。

また、Facebookは「放置してファストフードを供給し続けることもできるが、それは長続きしない」とも述べている。

告発者の主張に対し、Metaは「意図的に有害コンテンツを増幅させて利益を得ているという主張は誤りです」とコメントした。TikTokはこれらの主張を「捏造されたもの」とし、有害コンテンツが閲覧されるのを防ぐ技術に投資していると述べた。

アルゴリズムは「ブラックボックス」で、その内部動作を詳しく調査するのは難しいと、2020年から2024年までTikTokの推薦エンジンを構築した機械学習エンジニアのルオファン・ディンは語る。

彼は、「こうしたシステムを完全に安全に構築するのは難しい」と述べた。「深層学習アルゴリズム自体をコントロールできない」。

投稿内容にはあまり注意を払わず、「すべてのコンテンツはただのID、異なる数字に過ぎない」と彼は言う。

彼らはコンテンツ安全チームに依存して、有害な投稿がアルゴリズムによって促進されないように除去を確実にしているとし、その関係を車の各部品を担当するチームに例えた。

「加速装置やエンジンを担当するチームがあるでしょう?だから、ブレーキシステムを担当するチームも良い仕事をしていると期待しています」と彼は述べた。

しかし、TikTokが市場シェア拡大のためにほぼ毎週アルゴリズムを改善しようとする中で、彼は「境界線上」のコンテンツや問題のある投稿が増え始め、長時間動画を閲覧した後にだけ現れることに気づいた。

境界線上のコンテンツとは、ソーシャルメディア企業内で一般的に使われる用語で、有害だが合法な投稿を指す。性差別、レイシズム、性的内容、陰謀論なども含まれる。

ユーザーが問題のあるコンテンツを見たくないと示すシステムは機能しておらず、ティーンエイジャーたちはBBCに対し、暴力や憎悪に満ちたコンテンツが依然として推奨されていると語った。

ある極端な例では、19歳のカルムは、14歳の頃から「アルゴリズムに洗脳された」と述べた。彼に表示されたコンテンツは彼を怒らせ、彼は人種差別や性差別的な見解を持つようになったという。

カルムは14歳から「アルゴリズムに洗脳された」と語る

「それらの動画は私を元気づけたけれど、良い意味ではなかった」と彼は言った。「ただ非常に怒りを感じさせるもので、自分の内面の感情と非常に一致していた。周囲の人々に対して怒りを感じていた」。

英国の反テロ警察の専門家は、毎年何千もの投稿を分析し、最近数ヶ月で反ユダヤ主義、人種差別、暴力、極右の投稿の「正常化」を目の当たりにしていると語る。

「人々は現実の暴力に対して鈍感になり、自分の意見を共有することを恐れなくなっている」と一人の警官は述べた。

『TikTokを削除せよ』

2025年の数ヶ月間、BBCはTikTokの信頼と安全チームのメンバー(ニックと呼ぶ)と定期的に話をした。彼のノートパソコンには、彼の担当するケースや対応状況を示す社内ダッシュボードの画面を閲覧できた。

「毎日指示されたことに罪悪感を感じているなら、いつか何かを言う決断をすべきかもしれない」とニックは語った。

彼が評価していたケースの量は多すぎて、ユーザーの安全を守るには追いつかず、特にティーンエイジャーや子供たちが危険にさらされていると指摘した。削減や一部のモデレーションチームの再編成(AI技術に置き換えられる役割もある)により、こうしたコンテンツに効果的に対処する能力は制限されていると彼は述べた。

「テロ、性的暴力、身体的暴力、虐待、人身売買に関する資料の増加が見られる」と告発者は語った。

アプリが推奨し、対策を講じている有害コンテンツの実態は、「公に言われていることとかなり異なる」と付け加えた。

ニックは、政治家に関する比較的些細なケースを優先して審査した例や、未成年者に関わる深刻なケースが低優先度(P2以下)に分類されている証拠も示した。

イラクのケースについて、ニックは「この報告が出ている国は非常にリスクが高い。未成年者であり、性的脅迫に関わるものであり、優先度は高くない」と述べた。

また、テログループへの参加や犯罪行為を促す投稿が最優先とされていない例も示した。

信頼と安全のチームが若者に関わるケースを政治的ケースより優先するよう求めた際、彼らはそうしないよう指示され、与えられた順位に従って対応を続けるよう言われた。

ニックは、最終的に企業は政治家や政府との「良好な関係」を維持することを優先し、規制や禁止を避けるために子供の安全よりも重視していると考えていると述べた。

彼と他のスタッフがこれらの懸念を経営陣に伝えた際も、彼らは「日常的にこのコンテンツに触れていない」ため、あまり耳を貸さなかった。

信頼と安全の担当者の親へのアドバイスは、「削除してください。できるだけ長くアプリから遠ざけてください」と非常に率直なものだった。

TikTokは、政治的コンテンツが若者の安全より優先されているという考えを否定し、「根本的に誤った見解です」と述べた。

ニックの所属するチームは、複数のチームからなる広範な安全システムの一部であり、コンテンツに関する苦情を審査する責任を持つ。TikTokは、「特定の問題に対する専門的なワークフローは、子供の安全ケースの優先順位を下げることにはつながらず、専任のチームが並行して審査しています」と説明した。

TikTokのスポークスパーソンは、「TikTokが何百万人もの人々に新しい興味を発見させ、コミュニティを見つけ、クリエイター経済を支援している現実を無視している」と批判を否定した。

同社は、ティーン向けアカウントには50以上の安全機能と設定が自動的に有効になっていると述べた。また、有害なコンテンツが閲覧されるのを防ぐ技術に投資し、厳格な推奨ポリシーを維持し、ユーザーが体験を調整できる機能も提供している。

『追いつくためにできることをすべて』

2020年、InstagramのReelsがTikTokに対抗して導入され、アルゴリズムの軍拡競争が激化した。

2021年からFacebookとその後継会社Metaで上級研究員として働いたマット・モティルは、これがTikTokの「ユニークな製品」を模倣しようとした試みだったと述べた。

彼の仕事は2019年から2023年まで、「何億人もの人々に対して大規模な実験を行う」ことで、コンテンツのランキング方法をテストしていた。多くの場合、「彼らはこれが行われていることに気づいていなかった」と語る。

「Metaの製品は30億人以上に利用されており、長く使わせるほど広告を売り、収益を上げる。だからこそ、これを正しくやることが非常に重要だ。失敗すれば、非常に悪いことが起きる」と彼は言う。

特にReelsについては、「できるだけ早く進める」ことが方針だったとし、「有害なコンテンツから人々を守ることとエンゲージメントのバランスを取る」という一般的なトレードオフがあったと述べた。

彼が共有した研究資料によると、Reelsの投稿は、Instagramのメインフィードの投稿よりも有害なコメントの割合が高く、いじめや嫌がらせは75%、ヘイトスピーチは19%、暴力や扇動は7%高かった。

彼は、「安全スタッフは、Reelsの担当チームの承認を得て新しい製品や機能を導入し、ユーザーの安全を向上させる必要があった」と指摘した。Reelsのスタッフは、「有害なコンテンツの方がエンゲージメントが高いため、それを防ぐ製品をリリースしないインセンティブがあった」と語る。

Facebookが2016年に買収したソーシャルメディア監視ツールのクラウドテングを使った調査では、競争に対する過剰な警戒心も明らかになった。

CEOのマーク・ザッカーバーグは、「競争の脅威を感じると、いくらお金を使っても構わない」と述べた。

彼は、Reelsの拡大に伴い、安全チームが少人数のスタッフ採用の承認を得るのに苦労したと述べ、当時の状況を次のように振り返った。

「700人のスタッフをInstagram Reelsに投入したとき、他のチームは『OK、わかった』と言っただけだ」と語った。

Metaの元エンジニアであるティムは、TikTokと競争するために、より境界線上の有害コンテンツを許可したと述べた。彼のチームはこのコンテンツの削減に注力していたが、「ビジネスの立ち位置」が変わったことで方針が変わった。

「TikTokに負けて株価が下がるのは避けられない。だからみんなパニックになり、追いつくために何でもやろうとした。次の四半期の収益のために2%、3%でも稼げるところを探した」と彼は語る。

彼は、違法ではなくともユーザーが関与する可能性のあるコンテンツの制限をやめる決定は、ザッカーバーグに直接報告していると考えるMetaの上級副社長によって下されたと述べた。

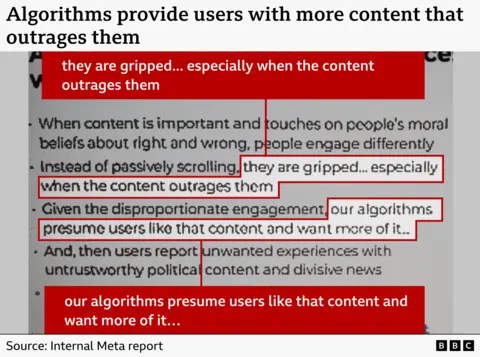

内部資料によると、Metaは、怒りや害を引き起こすコンテンツを増幅させていることを認識していたと明らかにしている。

資料は、倫理的な信念に触れる内容や暴力を扇動する投稿など、敏感なコンテンツが反応やエンゲージメントを引き起こしやすいと指摘している。

「この種のコンテンツは、過剰なエンゲージメントを引き起こすため、アルゴリズムはそれを好むと推測している」と記されている。

Silvermanは、Metaのリーダーシップは最初、プラットフォーム上の有害なコンテンツにどう対応すべきか迷っていたと述べる。

しかし、「次第に防御的な姿勢に変わった」とし、「社会の分極化のすべてに責任があるわけではないが、少なくとも一因ではある」と指摘した。

「少しの変更を加えるだけで、分極化に対する寄与を減らせるかもしれない」とも述べた。

Metaのスポークスパーソンは、告発者の主張を否定した。「私たちは、プラットフォーム上のユーザーを守るための厳格なポリシーを持ち、過去10年にわたり安全とセキュリティに大きく投資してきました」と述べた。

また、「ティーンのオンライン保護のために新たな『ティーンアカウント』機能を導入し、保護と親が管理できるツールも整備しています」と説明した。

ロバート・ファーコア、デイジー・バタ、エズ・ロバーツによる追加取材