世界の金融システムは構造的危機に直面しています。2025年には違法金融活動が推定4.4兆ドルに急増し、わずか2年で1.3兆ドル増加しました。この19.2%の年平均成長率は、金融犯罪が単なる増加にとどまらず、産業化していることを示しています。この急増は、従来のコンプライアンスモデルが失敗していることを意味します。従来のルールベースのシステムや手動の人間による審査は、敵対的AIの進化に追いつくことが数学的に不可能です。業界は現在、高コストの非効率状態で運営されています。銀行は一般的に総人員の10%から15%を顧客確認(KYC)やマネーロンダリング対策(AML)に割り当てていますが、世界の金融犯罪の流れのうちわずか約2%しか検出できていません。この運用コストと効果のギャップが「コンプライアンスの罠」です。私は、エージェントAIこそこの罠から脱出する唯一の信頼できる戦略だと考えています。エージェントAIは、「支援」技術から「自律」実行へのシフトを表します。生成AI(GenAI)がデータを要約し、分析AIがパターンを識別する一方で、エージェントAIは計画、実行、適応を行い、特定の目的を達成します。これは、要約を作成するチャットボットと、ケースを調査するデジタルワーカーの違いです。**ノーコード・ルールベースの枠組みの陳腐化**--------------------------------------------------10年前、「ノーコード」はリスク運用の基準でした。これにより、コンプライアンスチームはエンジニアリング支援なしでルールを構築できました。しかし、犯罪量が増加するにつれ、アナリストがボトルネックとなりました。従来のAMLでは、アラートの95%までが誤検知です。1つの疑わしい活動報告書(SAR)を作成するのに4日以上かかることもあります。ノーコードツールはもはや十分ではありません。今や必要なのはAIリスクインフラです。このインフラは、金融犯罪の全ライフサイクルを実行します:リアルタイムでリスクを検出し、アラートを調査し、規制当局向けの提出書類を作成します。Unit21の2026年のリローンチは、この移行を示しています。同社のプラットフォームは、ノーコードのルールエンジンから、AIエージェントが検出ロジックを調整し、人間のアナリストが関与せずに調査を行うエージェントシステムへと進化しています。**リスク運用におけるエージェントAIの定義**------------------------------------------エージェントAIは、一定の自律性を持ち、定められた目標に向かって行動するシステムを指します。金融犯罪対策においては、AIがどのデータソースを照会し、不一致な情報をどう解釈し、いつケースをエスカレーションするかを決定できることを意味します。### **コンプライアンスにおけるAIの世代比較**エージェントAIの生産性は、手動の実務者に比べて20倍の向上をもたらします。これらのエージェントは、人間の役割を模したチームに分類されます。Retrieval-Augmented Generation(RAG)エージェントは、損益計算書や所有者情報の抽出を担当します。データパイプラインエージェントは、ETLプロセスを調整し、断片化されたデータセット間でエンティティ解決を行います。調査エージェントは、市場動向や取引相手のパターンを監視し、検証エージェントは出力の品質を確認します。**AI調査ワークフロー**----------------------アラートがキューに入ると、AI調査エージェントは、空白から始めるのではなく、構造化されたワークフローに従います。2. **シグナル収集**:エージェントは取引履歴、エンティティプロフィール、リスクスコア、ウォッチリストの一致を取得します。さまざまな画面を横断し、上級アナリストが必要とするコンテキストを構築します。 3. **ワークフローの調整**:エージェントは、機関の標準操作手順(SOP)に合わせて設定されたモジュールステップに従います。これには、過去のアラート履歴の確認、OSINT検索の実行、制裁リストとの照合が含まれます。 4. **調査結果のまとめ**:エージェントは、文章による説明、証拠ログ、推奨処分を含む構造化されたパッケージを作成します。推論は明示的で追跡可能です。最終的な決定には、「人間が関与する」モデルが標準です。アナリストはエージェントのパッケージを承認、修正、または上書きし、人間の責任を確保します。**コンテキストエンジニアリングとプロンプトエンジニアリングの違い**------------------------------------------------------------エージェントAIにおける最も難しいエンジニアリング課題は、より良いプロンプトを書くことではなく、コンテキストの設計です。監査可能な調査ナarrativeを生成するには、モデルが正確な証拠を受け取り、過負荷にならずに適切な情報を提供する必要があります。LLMはトランスフォーマーアーキテクチャに基づき、すべてのトークンが他のすべてのトークンに注意を払うため、関係性はn2となり、コンテキスト長が増加すると注意の希少性が生じます。効果的なコンテキスト設計は、高信号のトークンを選別し、望ましい結果の可能性を最大化する科学です。例えば、Unit21は7年間の人間レビューから得た豊富なデータセットを活用し、特定のタスクを完了するために必要な最適なコンテキストを導き出しています。これらのタスクは、優秀なアナリストによる過去の調査と比較評価され、正確性、一貫性、効果性を確保します。評価は、「LLMを判定者として」用いるアーキテクチャで行われます。二次的により能力の高いモデルが一次エージェントの出力の質を評価し、自己検証層を作り出します。これにより、不整合が人間のレビュアーに届く前にフラグが立てられます。さらに、引用検証も行われ、エージェントの主張が取得したデータに基づいていることを確認します。**調査ワークフローの再掲**--------------------------アラートがキューに入ると、AI調査エージェントは、空白から始めるのではなく、構造化されたワークフローに従います。2. **シグナル収集**:エージェントは取引履歴、エンティティプロフィール、リスクスコア、ウォッチリストの一致を取得します。さまざまな画面を横断し、上級アナリストが必要とするコンテキストを構築します。 3. **ワークフローの調整**:エージェントは、機関の標準操作手順(SOP)に合わせて設定されたモジュールステップに従います。これには、過去のアラート履歴の確認、OSINT検索の実行、制裁リストとの照合が含まれます。 4. **調査結果のまとめ**:エージェントは、文章による説明、証拠ログ、推奨処分を含む構造化されたパッケージを作成します。推論は明示的で追跡可能です。最終的な決定には、「人間が関与する」モデルが標準です。アナリストはエージェントのパッケージを承認、修正、または上書きし、人間の責任を確保します。**エージェントの三つの失敗モード**-----------------------------多くの初期導入のAIエージェントは、モデルの弱さではなく、ガードレールの不備によって失敗します。Sardine2. **幻覚を見せる調査者**:これは、あまりにも多くのコンテキストやオープンエンドのプロンプトを提供したときに起こります。敵対的環境では、モデルはデータのギャップをもっともらしいが誤ったナarrativeで埋めてしまいます。解決策は、「原子エージェント」と呼ばれる狭い決定範囲のエージェントを使うことです。 3. **過剰に疑い深いエージェント**:パターン駆動の訓練だけでは、文脈に基づかないため過剰なエスカレーションにつながります。例えば、関連する内部アカウント間の高額支払いを「レイヤリング」としてフラグ付けするなどです。詐欺のデフォルト結論を防ぐために、根拠となる質問をエージェントのロジックに組み込む必要があります。 4. **ブラックボックスエージェント**:結論を出すだけで、規制当局に対して弁明できない場合があります。正確な出力には証拠の連鎖が必要であり、それがないとリスクとなります。エージェントはデータを決定論的に抽出し、構造化されたドキュメントに集中すべきです。**予測防御とデジタルワーカー**----------------------------2026年に向けて、プライベートステーブルコインとパブリックデジタルマネーの区別は、戦略的に重要な要素となりつつあります。詐欺とAMLの運用の融合は、単なる運用の統合ではなく、技術スタックのより深い統合です。エージェントAIシステムは、パイロット段階からAML防御の中核へと移行しています。単純なパターン認識から、犯罪活動をトランザクションの前に予測し、未然に防ぐ予測システムへと変化しています。正直に言えば、従来のルールベースのシステムは、即時決済のスピードに追いつけません。インパクトを生む道は、採用のスピードと適切な運用モデルにかかっています。主要な金融機関は、パイロット範囲から始めて効果を証明し、その後本格的な展開に備えています。エージェントAIは、KYC/AMLの次なる大きな革新の推進力であり、より強固なコンプライアンスと顧客体験の合理化を実現します。私は、エージェントAIの採用を、現代の金融環境で生き残るための必須条件と見なしています。4.4兆ドルの違法活動は、無策のコストがあまりにも高いことを思い知らされるものです。私たちは、手動の実行者からAI監督者へと移行し、エージェントのデジタル工場を管理し、機械の速度で検出と調査を行う体制を整える必要があります。

ディープダイブ:金融犯罪対策におけるエージェンティックAI

業界は現在、高コストの非効率状態で運営されています。銀行は一般的に総人員の10%から15%を顧客確認(KYC)やマネーロンダリング対策(AML)に割り当てていますが、世界の金融犯罪の流れのうちわずか約2%しか検出できていません。この運用コストと効果のギャップが「コンプライアンスの罠」です。私は、エージェントAIこそこの罠から脱出する唯一の信頼できる戦略だと考えています。

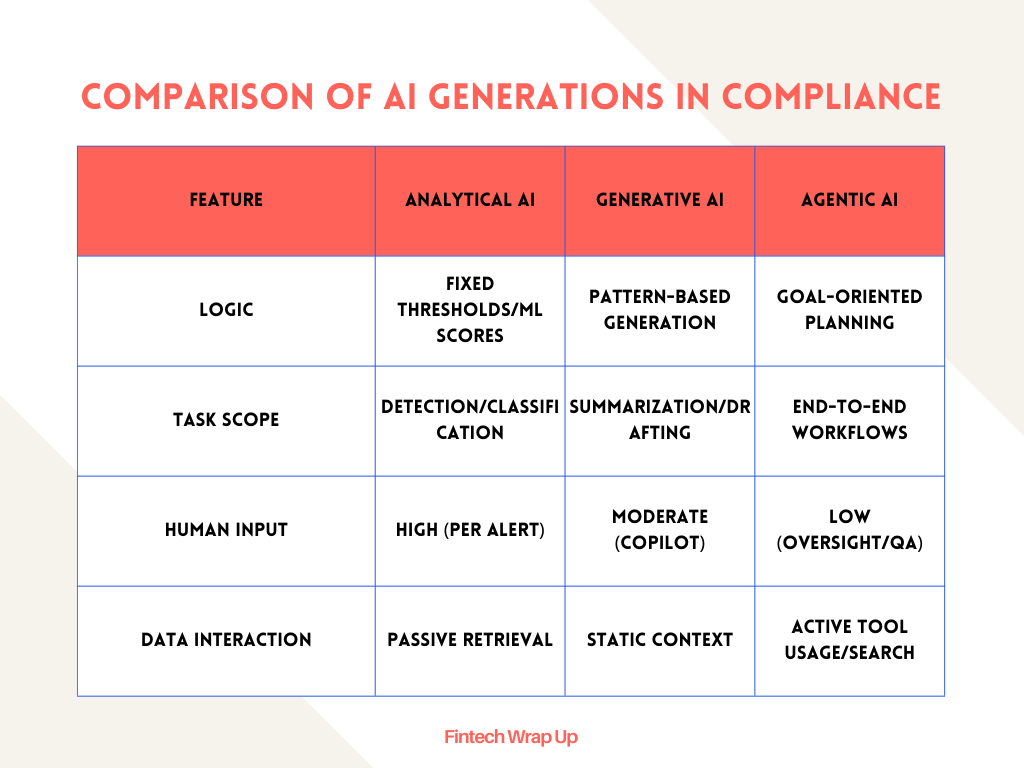

エージェントAIは、「支援」技術から「自律」実行へのシフトを表します。生成AI(GenAI)がデータを要約し、分析AIがパターンを識別する一方で、エージェントAIは計画、実行、適応を行い、特定の目的を達成します。これは、要約を作成するチャットボットと、ケースを調査するデジタルワーカーの違いです。

ノーコード・ルールベースの枠組みの陳腐化

10年前、「ノーコード」はリスク運用の基準でした。これにより、コンプライアンスチームはエンジニアリング支援なしでルールを構築できました。しかし、犯罪量が増加するにつれ、アナリストがボトルネックとなりました。従来のAMLでは、アラートの95%までが誤検知です。1つの疑わしい活動報告書(SAR)を作成するのに4日以上かかることもあります。

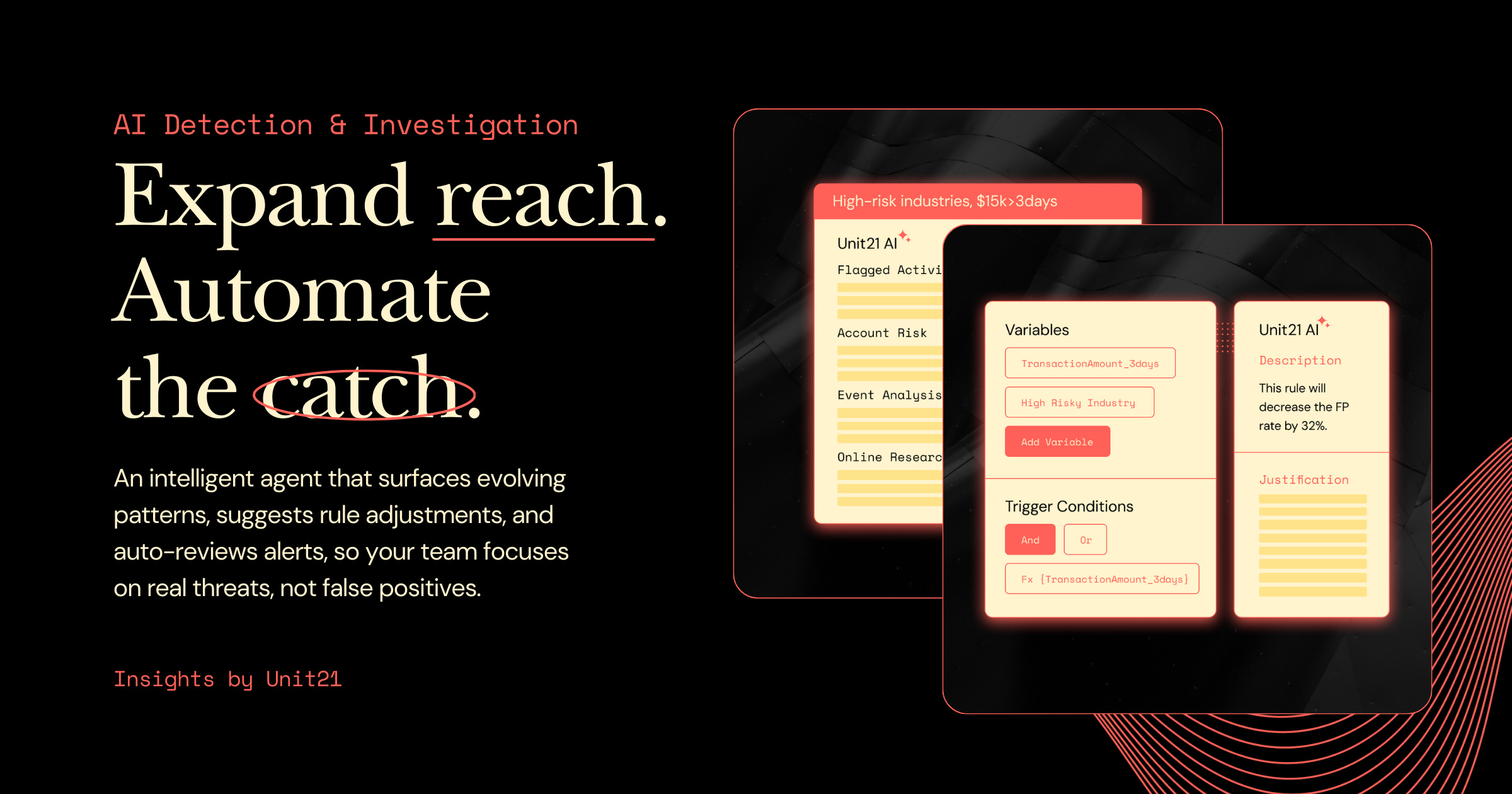

ノーコードツールはもはや十分ではありません。今や必要なのはAIリスクインフラです。このインフラは、金融犯罪の全ライフサイクルを実行します:リアルタイムでリスクを検出し、アラートを調査し、規制当局向けの提出書類を作成します。Unit21の2026年のリローンチは、この移行を示しています。同社のプラットフォームは、ノーコードのルールエンジンから、AIエージェントが検出ロジックを調整し、人間のアナリストが関与せずに調査を行うエージェントシステムへと進化しています。

リスク運用におけるエージェントAIの定義

エージェントAIは、一定の自律性を持ち、定められた目標に向かって行動するシステムを指します。金融犯罪対策においては、AIがどのデータソースを照会し、不一致な情報をどう解釈し、いつケースをエスカレーションするかを決定できることを意味します。

コンプライアンスにおけるAIの世代比較

エージェントAIの生産性は、手動の実務者に比べて20倍の向上をもたらします。これらのエージェントは、人間の役割を模したチームに分類されます。Retrieval-Augmented Generation(RAG)エージェントは、損益計算書や所有者情報の抽出を担当します。データパイプラインエージェントは、ETLプロセスを調整し、断片化されたデータセット間でエンティティ解決を行います。調査エージェントは、市場動向や取引相手のパターンを監視し、検証エージェントは出力の品質を確認します。

AI調査ワークフロー

アラートがキューに入ると、AI調査エージェントは、空白から始めるのではなく、構造化されたワークフローに従います。

シグナル収集:エージェントは取引履歴、エンティティプロフィール、リスクスコア、ウォッチリストの一致を取得します。さまざまな画面を横断し、上級アナリストが必要とするコンテキストを構築します。

ワークフローの調整:エージェントは、機関の標準操作手順(SOP)に合わせて設定されたモジュールステップに従います。これには、過去のアラート履歴の確認、OSINT検索の実行、制裁リストとの照合が含まれます。

調査結果のまとめ:エージェントは、文章による説明、証拠ログ、推奨処分を含む構造化されたパッケージを作成します。推論は明示的で追跡可能です。

最終的な決定には、「人間が関与する」モデルが標準です。アナリストはエージェントのパッケージを承認、修正、または上書きし、人間の責任を確保します。

コンテキストエンジニアリングとプロンプトエンジニアリングの違い

エージェントAIにおける最も難しいエンジニアリング課題は、より良いプロンプトを書くことではなく、コンテキストの設計です。監査可能な調査ナarrativeを生成するには、モデルが正確な証拠を受け取り、過負荷にならずに適切な情報を提供する必要があります。LLMはトランスフォーマーアーキテクチャに基づき、すべてのトークンが他のすべてのトークンに注意を払うため、関係性はn2となり、コンテキスト長が増加すると注意の希少性が生じます。

効果的なコンテキスト設計は、高信号のトークンを選別し、望ましい結果の可能性を最大化する科学です。例えば、Unit21は7年間の人間レビューから得た豊富なデータセットを活用し、特定のタスクを完了するために必要な最適なコンテキストを導き出しています。これらのタスクは、優秀なアナリストによる過去の調査と比較評価され、正確性、一貫性、効果性を確保します。

評価は、「LLMを判定者として」用いるアーキテクチャで行われます。二次的により能力の高いモデルが一次エージェントの出力の質を評価し、自己検証層を作り出します。これにより、不整合が人間のレビュアーに届く前にフラグが立てられます。さらに、引用検証も行われ、エージェントの主張が取得したデータに基づいていることを確認します。

調査ワークフローの再掲

アラートがキューに入ると、AI調査エージェントは、空白から始めるのではなく、構造化されたワークフローに従います。

シグナル収集:エージェントは取引履歴、エンティティプロフィール、リスクスコア、ウォッチリストの一致を取得します。さまざまな画面を横断し、上級アナリストが必要とするコンテキストを構築します。

ワークフローの調整:エージェントは、機関の標準操作手順(SOP)に合わせて設定されたモジュールステップに従います。これには、過去のアラート履歴の確認、OSINT検索の実行、制裁リストとの照合が含まれます。

調査結果のまとめ:エージェントは、文章による説明、証拠ログ、推奨処分を含む構造化されたパッケージを作成します。推論は明示的で追跡可能です。

最終的な決定には、「人間が関与する」モデルが標準です。アナリストはエージェントのパッケージを承認、修正、または上書きし、人間の責任を確保します。

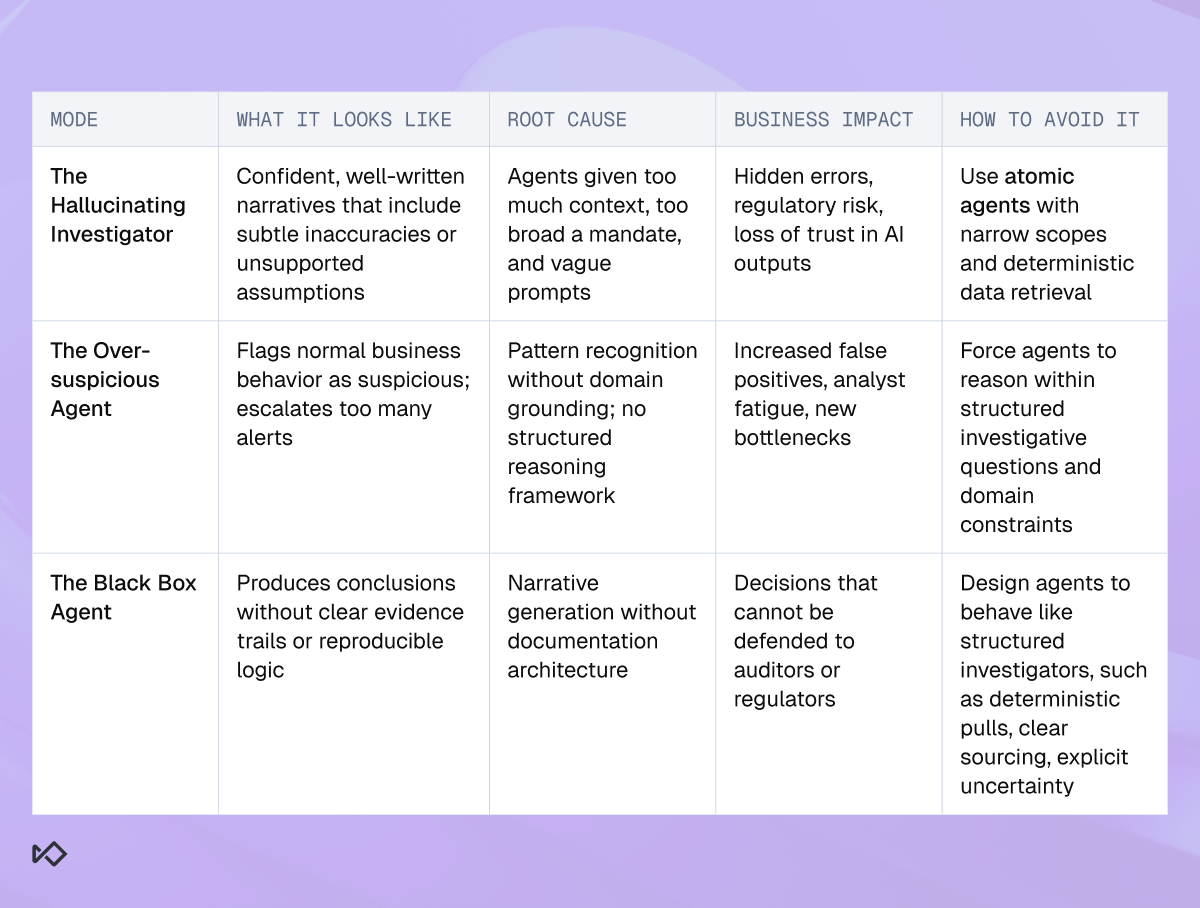

エージェントの三つの失敗モード

多くの初期導入のAIエージェントは、モデルの弱さではなく、ガードレールの不備によって失敗します。

Sardine

幻覚を見せる調査者:これは、あまりにも多くのコンテキストやオープンエンドのプロンプトを提供したときに起こります。敵対的環境では、モデルはデータのギャップをもっともらしいが誤ったナarrativeで埋めてしまいます。解決策は、「原子エージェント」と呼ばれる狭い決定範囲のエージェントを使うことです。

過剰に疑い深いエージェント:パターン駆動の訓練だけでは、文脈に基づかないため過剰なエスカレーションにつながります。例えば、関連する内部アカウント間の高額支払いを「レイヤリング」としてフラグ付けするなどです。詐欺のデフォルト結論を防ぐために、根拠となる質問をエージェントのロジックに組み込む必要があります。

ブラックボックスエージェント:結論を出すだけで、規制当局に対して弁明できない場合があります。正確な出力には証拠の連鎖が必要であり、それがないとリスクとなります。エージェントはデータを決定論的に抽出し、構造化されたドキュメントに集中すべきです。

予測防御とデジタルワーカー

2026年に向けて、プライベートステーブルコインとパブリックデジタルマネーの区別は、戦略的に重要な要素となりつつあります。詐欺とAMLの運用の融合は、単なる運用の統合ではなく、技術スタックのより深い統合です。

エージェントAIシステムは、パイロット段階からAML防御の中核へと移行しています。単純なパターン認識から、犯罪活動をトランザクションの前に予測し、未然に防ぐ予測システムへと変化しています。正直に言えば、従来のルールベースのシステムは、即時決済のスピードに追いつけません。

インパクトを生む道は、採用のスピードと適切な運用モデルにかかっています。主要な金融機関は、パイロット範囲から始めて効果を証明し、その後本格的な展開に備えています。エージェントAIは、KYC/AMLの次なる大きな革新の推進力であり、より強固なコンプライアンスと顧客体験の合理化を実現します。

私は、エージェントAIの採用を、現代の金融環境で生き残るための必須条件と見なしています。4.4兆ドルの違法活動は、無策のコストがあまりにも高いことを思い知らされるものです。私たちは、手動の実行者からAI監督者へと移行し、エージェントのデジタル工場を管理し、機械の速度で検出と調査を行う体制を整える必要があります。