OpenAIは火曜日に、これまでで最も高性能な二つの小型モデル、GPT-5.4 miniとGPT-5.4 nanoをリリースしました。これらは低遅延・低コストを実現し、フラッグシップモデルとの性能差を大きく縮めています。**GPT-5.4 miniは、プログラミング、推論、多模態理解、ツール呼び出しなどの主要な分野で前世代のGPT-5 miniを全面的に上回り、動作速度は2倍以上向上し、SWE-Bench Proなどのベンチマークテストでより大きなGPT-5.4に近づいています。****GPT-5.4 nanoは、コスト最小、遅延最短の軽量オプションとして位置付けられ、APIを通じて開発者にのみ提供され、データ分類、抽出、簡単なプログラミングサブタスクに特化しています。**これら二つのモデルのリリースは、リアルタイムインタラクションの場面で遅延が高すぎて実用化が難しかった大規模モデルの課題を埋めることを目的としています。これにより、プログラミングアシスタント、AIエージェントシステム、多模態アプリケーションなど、急成長する商業市場への影響も期待されます。miniは消費者向け、nanoは専用API-------------------GPT-5.4 miniは本日より、OpenAI API、Codexプラットフォーム、ChatGPTの三つのチャネルで同時に利用可能となります。**GPT-5.4 miniのAPI価格は、入力トークン100万あたり0.75ドル、出力トークン100万あたり4.50ドルです。**テキストと画像の入力、ツール呼び出し、関数呼び出し、ウェブ検索、ファイル検索、コンピュータ操作、スキル拡張をサポートし、コンテキストウィンドウは40万トークンに達します。**Codexプラットフォームでは、GPT-5.4 miniはGPT-5.4のクォータの30%しか消費せず、開発者が簡単なプログラミングタスクを処理するコストはフラッグシップモデルの約3分の1に削減されます。**また、GPT-5.4 miniを動かすサブインテリジェントエージェントにタスクを委任することも可能で、推論密度の低いタスクはより安価なモデルに自動的に振り分けられます。**ChatGPTでは、FreeおよびGoユーザーは「+」メニューから「Thinking」機能を選択してGPT-5.4 miniを利用可能です。その他の有料ユーザーは、GPT-5.4 Thinkingのアクセス上限に達した場合、自動的にダウングレードの代替としてこのモデルが有効になります。**GPT-5.4 nanoは現時点ではAPI経由のみで提供され、価格は入力トークン100万あたり0.20ドル、出力トークン100万あたり1.25ドルです。これら二つの新モデルの中で最も低価格です。OpenAIは、nanoは高階モデルによる調整と補助的なサブインテリジェントエージェントの役割に適していると述べています。miniはフラッグシップに近づき、nanoは前世代を超える-----------------OpenAIが公開した評価データによると、GPT-5.4 miniはプログラミングや多模態タスクで特に優れたパフォーマンスを示しています。**SWE-bench Proのプログラミングベンチマークでは、miniは54.4%の得点を獲得し、GPT-5.4の57.7%との差は3.3ポイントに縮まり、GPT-5 miniの45.7%を大きく上回っています。****OSWorld-Verifiedのコンピュータ操作ベンチマークでは、miniは72.1%でGPT-5.4の75.0%に迫り、GPT-5 miniの42.0%を大きく上回っています。****ツール呼び出し能力に関しては、GPT-5.4 miniはτ2-benchの電気通信テストで93.4%を記録し、GPT-5 miniの74.1%から大きく向上しています。**また、汎用インテリジェンスのGPQA Diamondテストでは、miniは88.0%、nanoは82.8%を達成し、いずれもGPT-5 miniの81.6%を超えています。注目すべきは、GPT-5.4 nanoは一部のビジュアルタスクではGPT-5 miniに劣る場合もあり、OSWorld-Verifiedの得点は39.0%で、後者の42.0%を下回っています。しかし、プログラミングやツール呼び出しのタスクでは、前世代よりも明らかに改善しています。**OpenAIは、nanoの設計優先順位は低遅延と低コストにあり、総合的な性能は二の次であると述べています。開発者は具体的なタスクに応じて選択を検討すべきです。**サブインテリジェントエージェントアーキテクチャ、多モデル協調による新たな製品設計パラダイム--------------------OpenAIはリリース資料の中で、これら二つの新モデルが多層システムにおいてどのような位置付けにあるかを強調しています。**例として、自社開発のプログラミングアシスタントCodexを挙げると、GPT-5.4は計画・調整・最終判断を担当し、GPT-5.4 miniのサブインテリジェントエージェントは、コードベースの検索、大規模ファイルのレビュー、補助ドキュメント処理などのより細かいサブタスクを並行して処理します。****OpenAIは、小型モデルは高速かつ高機能であるため、すべてのタスクを単一モデルで処理する必要はなく、システムを構築できると述べています。大規模モデルが意思決定を担当し、小型モデルは迅速かつ大規模にタスクを実行します。**OpenAIは次のように述べています。> **GPT-5.4 miniは、これまでで最も強力な小型モデルの一つです。**このアーキテクチャは高並列処理の作業にとって特に重要であり、プログラミングアシスタント、スクリーンショット解析、リアルタイム画像理解などのシナリオでは、応答遅延が製品体験に直接影響します。最適な選択は、能力の最も高いモデルではなく、速度、ツールの信頼性、タスクのパフォーマンスのバランスが取れるモデルです。開発者にとって、GPT-5.4 miniとnanoのリリースは、システム全体の知能レベルを犠牲にすることなく、推論コストを大幅に削減する道筋がさらに明確になったことを意味します。リスクと免責事項市場にはリスクが伴います。投資は自己責任で行ってください。本記事は個別の投資アドバイスではなく、特定の投資目的、財務状況、ニーズを考慮したものではありません。読者は本記事の意見、見解、結論が自身の状況に適合するかどうかを判断し、投資の責任は自己負担です。

OpenAIがGPT-5.4 miniおよびnanoをリリース、より低コストでフラッグシップモデルのパフォーマンスに接近

OpenAIは火曜日に、これまでで最も高性能な二つの小型モデル、GPT-5.4 miniとGPT-5.4 nanoをリリースしました。これらは低遅延・低コストを実現し、フラッグシップモデルとの性能差を大きく縮めています。

GPT-5.4 miniは、プログラミング、推論、多模態理解、ツール呼び出しなどの主要な分野で前世代のGPT-5 miniを全面的に上回り、動作速度は2倍以上向上し、SWE-Bench Proなどのベンチマークテストでより大きなGPT-5.4に近づいています。

GPT-5.4 nanoは、コスト最小、遅延最短の軽量オプションとして位置付けられ、APIを通じて開発者にのみ提供され、データ分類、抽出、簡単なプログラミングサブタスクに特化しています。

これら二つのモデルのリリースは、リアルタイムインタラクションの場面で遅延が高すぎて実用化が難しかった大規模モデルの課題を埋めることを目的としています。これにより、プログラミングアシスタント、AIエージェントシステム、多模態アプリケーションなど、急成長する商業市場への影響も期待されます。

miniは消費者向け、nanoは専用API

GPT-5.4 miniは本日より、OpenAI API、Codexプラットフォーム、ChatGPTの三つのチャネルで同時に利用可能となります。

**GPT-5.4 miniのAPI価格は、入力トークン100万あたり0.75ドル、出力トークン100万あたり4.50ドルです。**テキストと画像の入力、ツール呼び出し、関数呼び出し、ウェブ検索、ファイル検索、コンピュータ操作、スキル拡張をサポートし、コンテキストウィンドウは40万トークンに達します。

**Codexプラットフォームでは、GPT-5.4 miniはGPT-5.4のクォータの30%しか消費せず、開発者が簡単なプログラミングタスクを処理するコストはフラッグシップモデルの約3分の1に削減されます。**また、GPT-5.4 miniを動かすサブインテリジェントエージェントにタスクを委任することも可能で、推論密度の低いタスクはより安価なモデルに自動的に振り分けられます。

ChatGPTでは、FreeおよびGoユーザーは「+」メニューから「Thinking」機能を選択してGPT-5.4 miniを利用可能です。その他の有料ユーザーは、GPT-5.4 Thinkingのアクセス上限に達した場合、自動的にダウングレードの代替としてこのモデルが有効になります。

GPT-5.4 nanoは現時点ではAPI経由のみで提供され、価格は入力トークン100万あたり0.20ドル、出力トークン100万あたり1.25ドルです。これら二つの新モデルの中で最も低価格です。OpenAIは、nanoは高階モデルによる調整と補助的なサブインテリジェントエージェントの役割に適していると述べています。

miniはフラッグシップに近づき、nanoは前世代を超える

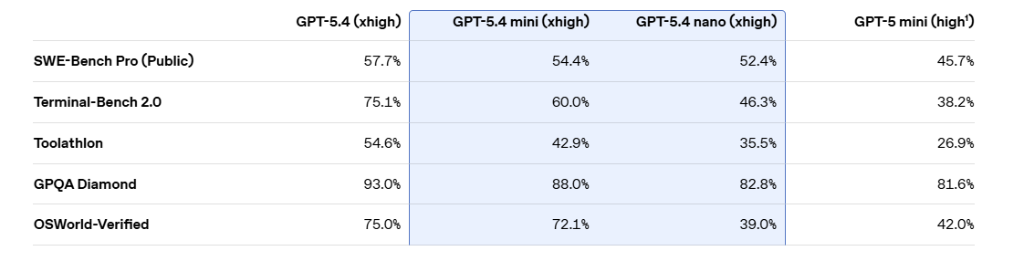

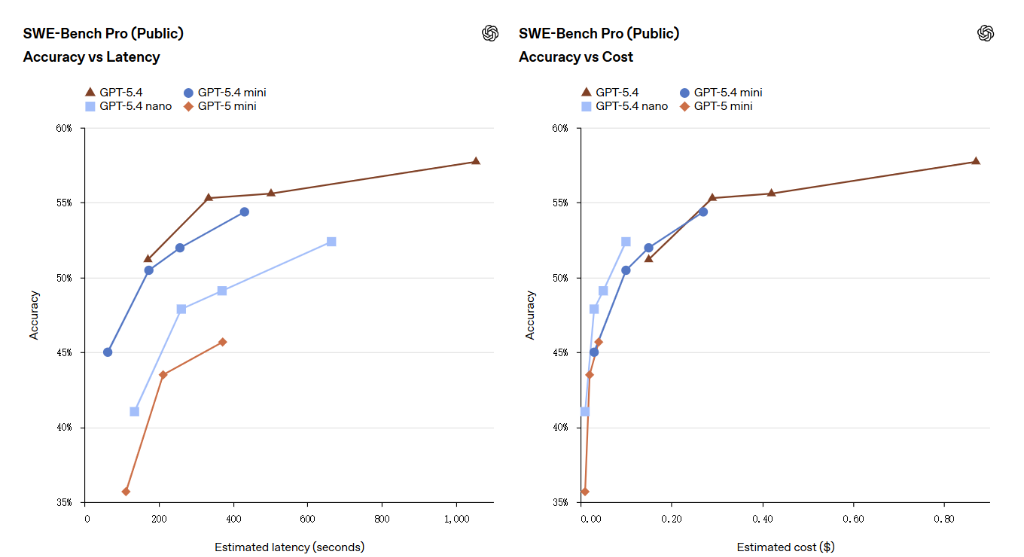

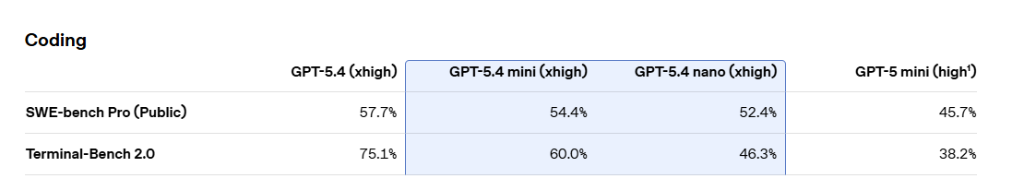

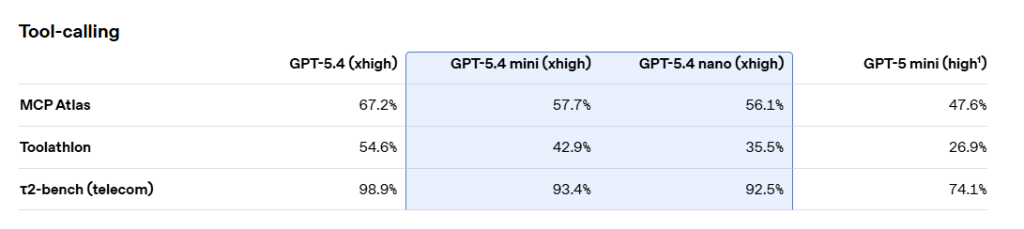

OpenAIが公開した評価データによると、GPT-5.4 miniはプログラミングや多模態タスクで特に優れたパフォーマンスを示しています。

SWE-bench Proのプログラミングベンチマークでは、miniは54.4%の得点を獲得し、GPT-5.4の57.7%との差は3.3ポイントに縮まり、GPT-5 miniの45.7%を大きく上回っています。

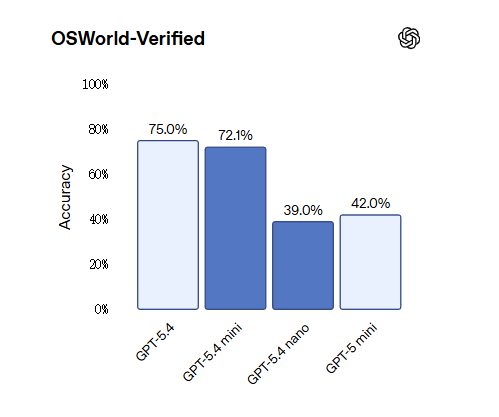

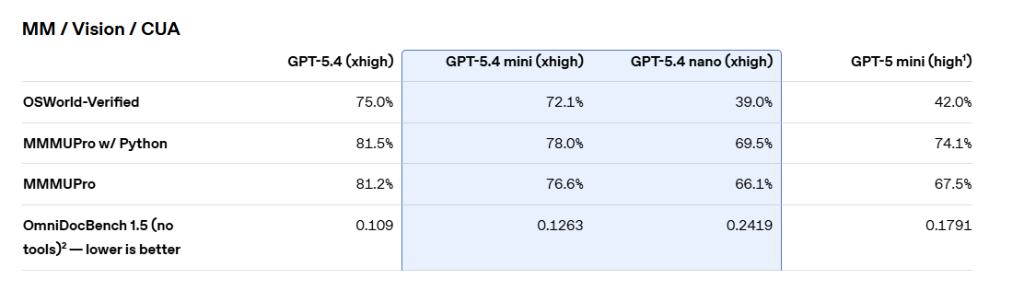

OSWorld-Verifiedのコンピュータ操作ベンチマークでは、miniは72.1%でGPT-5.4の75.0%に迫り、GPT-5 miniの42.0%を大きく上回っています。

**ツール呼び出し能力に関しては、GPT-5.4 miniはτ2-benchの電気通信テストで93.4%を記録し、GPT-5 miniの74.1%から大きく向上しています。**また、汎用インテリジェンスのGPQA Diamondテストでは、miniは88.0%、nanoは82.8%を達成し、いずれもGPT-5 miniの81.6%を超えています。

注目すべきは、GPT-5.4 nanoは一部のビジュアルタスクではGPT-5 miniに劣る場合もあり、OSWorld-Verifiedの得点は39.0%で、後者の42.0%を下回っています。しかし、プログラミングやツール呼び出しのタスクでは、前世代よりも明らかに改善しています。

OpenAIは、nanoの設計優先順位は低遅延と低コストにあり、総合的な性能は二の次であると述べています。開発者は具体的なタスクに応じて選択を検討すべきです。

サブインテリジェントエージェントアーキテクチャ、多モデル協調による新たな製品設計パラダイム

OpenAIはリリース資料の中で、これら二つの新モデルが多層システムにおいてどのような位置付けにあるかを強調しています。

例として、自社開発のプログラミングアシスタントCodexを挙げると、GPT-5.4は計画・調整・最終判断を担当し、GPT-5.4 miniのサブインテリジェントエージェントは、コードベースの検索、大規模ファイルのレビュー、補助ドキュメント処理などのより細かいサブタスクを並行して処理します。

**OpenAIは、小型モデルは高速かつ高機能であるため、すべてのタスクを単一モデルで処理する必要はなく、システムを構築できると述べています。大規模モデルが意思決定を担当し、小型モデルは迅速かつ大規模にタスクを実行します。**OpenAIは次のように述べています。

このアーキテクチャは高並列処理の作業にとって特に重要であり、プログラミングアシスタント、スクリーンショット解析、リアルタイム画像理解などのシナリオでは、応答遅延が製品体験に直接影響します。最適な選択は、能力の最も高いモデルではなく、速度、ツールの信頼性、タスクのパフォーマンスのバランスが取れるモデルです。

開発者にとって、GPT-5.4 miniとnanoのリリースは、システム全体の知能レベルを犠牲にすることなく、推論コストを大幅に削減する道筋がさらに明確になったことを意味します。

リスクと免責事項

市場にはリスクが伴います。投資は自己責任で行ってください。本記事は個別の投資アドバイスではなく、特定の投資目的、財務状況、ニーズを考慮したものではありません。読者は本記事の意見、見解、結論が自身の状況に適合するかどうかを判断し、投資の責任は自己負担です。