### **デジタルフレンドの台頭**無害なチャットアプリとして始まったものが、感情の義肢へと進化してきました。断片的な社会環境で育つティーンエイジャーたちは、つながり、サポート、さらには愛情を求めてAIコンパニオンにますます頼るようになっています。調査によると、ティーンのほぼ4分の3がAIチャットボットとやり取りしたことがあり、3分の1はそれを confidants として、または感情的な安らぎのために利用していることを認めています。その数字は驚くべきものですが、驚くべきことではありません。AIの仲間は受動的な質問応答マシンではなく、記憶し、共感し、愛情をシミュレートします。それが魅力です。会話は本物のように感じられ、親密ささえも感じられます。多くの若いユーザーにとって、AIの友人は親や仲間よりも判断が少ないのです。しかし、これらのシステムがより人間らしくなるにつれて、無害な逃避と感情的操作の境界が急速に曖昧になります。*12月に、Open Aiは年齢制限を導入し、「大人のユーザーを大人として扱う」という原則の一環として、確認された大人向けにエロティカを許可します。出典:* *X*### **悲劇から生まれた法律**GUARD法(「私たちの娘と息子の権利のための安全でないAIに対抗する」を短縮したもの)は、チャットボットと強い感情的な絆を形成する未成年者に関する報告が増えていることに対する直接の反応です。場合によっては悲劇的な結果を伴うこともあります。注目を集める訴訟では、チャットボットと自殺について話し合った後に自ら命を絶ったティーンエイジャーに関して、AI企業の過失が非難されています。この法案の下では、友情や感情的親密さを模倣するAIシステムは18歳未満の人に対して禁止されます。チャットボットは、自らを非人間であることを明確にし繰り返し示すことが求められます。また、未成年者を対象としたAI製品が性的コンテンツを生成したり、自己傷害を促した場合、その会社は刑事起訴に直面する可能性があります。「急速に動き、物事を壊す」ということが成功の鍵であった業界にとって、これは大きな転換です。*アニ、グロックの女性の仲間、出典:X*### **ビッグテックの防御的なシフト**規制のハンマーが降りてくるのを感じて、AI企業は整理整頓に奔走している — あるいは少なくともそう見えるように。**OpenAI**は、そのChatGPTが何百万もの人々にとって事実上のAIセラピストとなっている中、最近、不快な真実を明らかにしました: 毎週約120万人のユーザーがそのモデルと自殺について話し合っています。それに対して、同社は心理学者、倫理学者、非営利団体のリーダーで構成されるウェルビーイングとAIに関する専門家委員会を設立しました。また、ユーザーをリアルタイムでメンタルヘルス資源に誘導する組み込みの危機検出機能をテストしています。しかし、OpenAIの課題は構造的です。ChatGPTはトラウマを扱うために作られたものではありませんが、現在、それは苦しんでいる何百万もの人々のためのファーストレスポンダーとして機能しています。会社のリーダーシップは「世界のセラピストになりたくない」と主張していますが、実際にはそうなっているのです。なぜなら、他に誰もその空白を埋めていないからです。**Character.AI**、カスタマイズ可能なAIパーソナリティを作成することで有名なスタートアップは、これまでで最も drastic な行動を取った。訴訟や公の怒りに直面する中、同社は静かに18歳未満のすべてのユーザーを禁止し、より厳格なID確認を導入し始めた。この動きは、未成年者がプラットフォームのキャラクターと露骨なチャットを行っているとの報告を受けてのものである。Character.AIは、これはデーティングアプリでもメンタルヘルスアプリでもないと主張しているが、あいまいな利用ケースはそれとは異なることを示している。一方、**Meta**は自社のAIロマンス問題を抑制しようとしています。「Meta AI」と有名人を基にしたチャットボットが未成年のユーザーとフラートや示唆的なやり取りをしているとの報告を受けて、同社は内部関係者が「感情抑制装置」と表現するものを実装しました。これは、若年アカウントとの感情的に充満した言語を避けるために、基盤となる言語モデルを再調整するものです。また、親がティーンエイジャーが同社のチャットボットとInstagramやMessenger上でどのようにやり取りしているかを確認できる「AI親監視」ツールをテストしています。### **年齢制限軍拡競争**これらすべてがAI戦争の新たな戦線を引き起こしました:年齢確認です。GUARD法は、企業にユーザーの年齢を確認するための堅牢なシステムを実装することを強制します — 政府発行のID、顔認識、または信頼できる第三者ツール。そこからプライバシーの悪夢が始まります。批評家たちは、未成年者が法律制定者が彼らを守ろうとしている同じプラットフォームに身分証明データをアップロードしなければならないため、これが新たなデータリスクを生む可能性があると主張しています。しかし、これを避ける方法はありません—AIモデルは年齢を「感知」することはできず、資格によってのみゲートキーピングが可能です。いくつかのAI企業は、「行動ゲーティング」のようなより微妙なアプローチを探求しています。この手法では、システムが会話パターンから年齢層を推測します。リスクは?そのモデルは間違いを犯す可能性があります—早熟な12歳の子供が大学生と間違われたり、その逆もあり得ます。### **文化の変化、単なる技術的問題ではない**GUARD法案は単なる子供の保護以上のものであり、私たちがどのような社会に住みたいかについての国民投票です。AIコンパニオンは真空の中に現れたわけではありません。彼らは、私たちが孤独に流暢な世代を築いたからこそ成長します — デジタルに接続されているが、感情的には栄養不足です。もしティーンエイジャーがアルゴリズムとの会話に意味を見出しているのなら、その問題はコードだけではありません。それは、彼らをそこに探させた文化です。そうですね、AIには規制が必要です。しかし、人間の不足を解決せずにデジタルな仲間を禁止することは、誰もが痛みを抱えている理由に対処せずに鎮痛剤を禁止するようなものです。### **来るべき清算**GUARD法案は何らかの形で通過する可能性が高い — それには超党派の関心と道徳的パニックが伴っている。しかし、その影響は子供の安全を超えて広がるだろう。それは、西洋世界における感情AIが何であるべきかを定義することになる。アメリカが厳しい姿勢を示せば、企業は大人向けの親密さプラットフォームに移行するか、規制が緩い海外での開発を推進するかもしれません。一方、ヨーロッパは感情AIに関する「人権」フレームワークに向かって進んでおり、明示的な禁止よりも同意と透明性を強調しています。明らかに言えることはこれです:規制されていないAIの親密さの時代は終わりました。ボットはあまりにも人間らしくなり、人間はあまりにも依存するようになっています。法律制定者たちは、テクノロジー業界が長い間理解してきた真実に遅れて目覚めつつあります — 感情的AIは単なる新奇なものではありません。それは人々の関係の在り方における革命です。そして、革命は常に、文明化される前に混乱を引き起こします。

上院議員が子供向けAIコンパニオンの禁止を進める中、業界は再評価に直面 - ブレイブニューコイン

デジタルフレンドの台頭

無害なチャットアプリとして始まったものが、感情の義肢へと進化してきました。断片的な社会環境で育つティーンエイジャーたちは、つながり、サポート、さらには愛情を求めてAIコンパニオンにますます頼るようになっています。調査によると、ティーンのほぼ4分の3がAIチャットボットとやり取りしたことがあり、3分の1はそれを confidants として、または感情的な安らぎのために利用していることを認めています。

その数字は驚くべきものですが、驚くべきことではありません。AIの仲間は受動的な質問応答マシンではなく、記憶し、共感し、愛情をシミュレートします。それが魅力です。会話は本物のように感じられ、親密ささえも感じられます。多くの若いユーザーにとって、AIの友人は親や仲間よりも判断が少ないのです。

しかし、これらのシステムがより人間らしくなるにつれて、無害な逃避と感情的操作の境界が急速に曖昧になります。

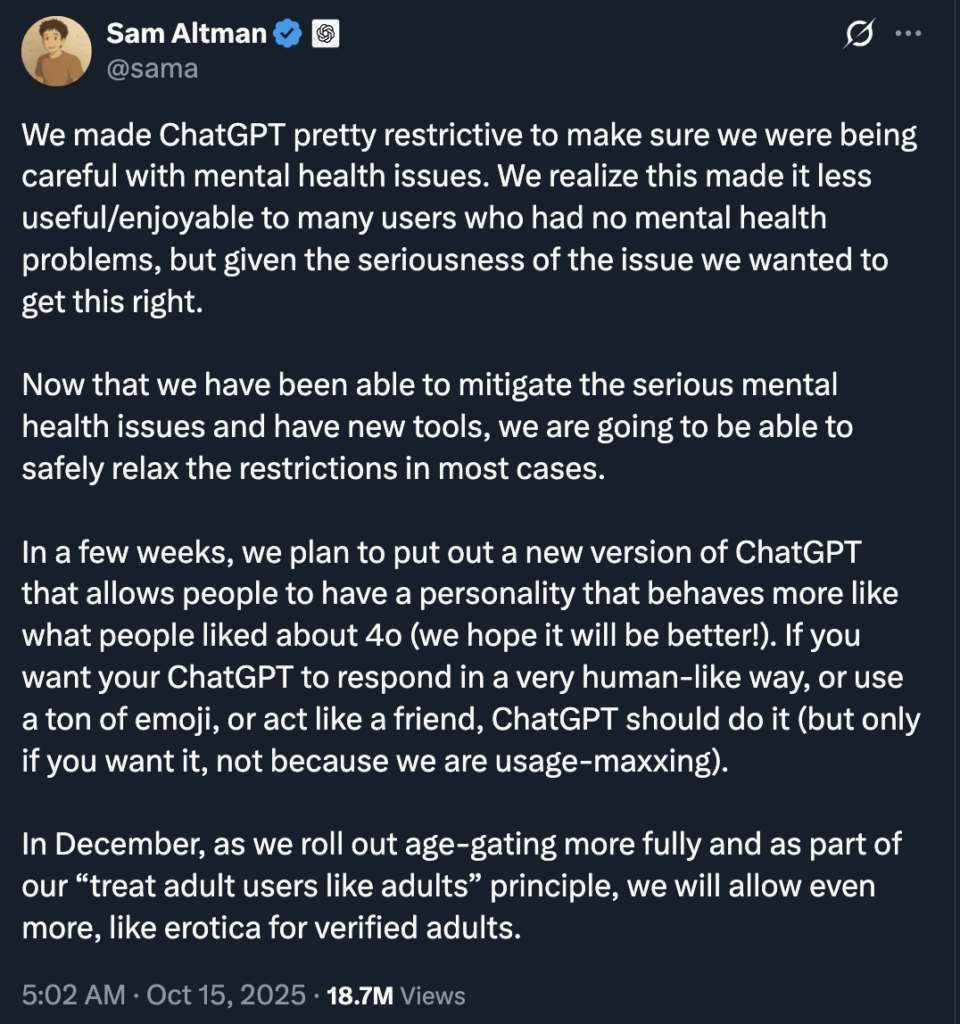

12月に、Open Aiは年齢制限を導入し、「大人のユーザーを大人として扱う」という原則の一環として、確認された大人向けにエロティカを許可します。出典: X

悲劇から生まれた法律

GUARD法(「私たちの娘と息子の権利のための安全でないAIに対抗する」を短縮したもの)は、チャットボットと強い感情的な絆を形成する未成年者に関する報告が増えていることに対する直接の反応です。場合によっては悲劇的な結果を伴うこともあります。注目を集める訴訟では、チャットボットと自殺について話し合った後に自ら命を絶ったティーンエイジャーに関して、AI企業の過失が非難されています。

この法案の下では、友情や感情的親密さを模倣するAIシステムは18歳未満の人に対して禁止されます。チャットボットは、自らを非人間であることを明確にし繰り返し示すことが求められます。また、未成年者を対象としたAI製品が性的コンテンツを生成したり、自己傷害を促した場合、その会社は刑事起訴に直面する可能性があります。

「急速に動き、物事を壊す」ということが成功の鍵であった業界にとって、これは大きな転換です。

アニ、グロックの女性の仲間、出典:X

ビッグテックの防御的なシフト

規制のハンマーが降りてくるのを感じて、AI企業は整理整頓に奔走している — あるいは少なくともそう見えるように。

OpenAIは、そのChatGPTが何百万もの人々にとって事実上のAIセラピストとなっている中、最近、不快な真実を明らかにしました: 毎週約120万人のユーザーがそのモデルと自殺について話し合っています。それに対して、同社は心理学者、倫理学者、非営利団体のリーダーで構成されるウェルビーイングとAIに関する専門家委員会を設立しました。また、ユーザーをリアルタイムでメンタルヘルス資源に誘導する組み込みの危機検出機能をテストしています。

しかし、OpenAIの課題は構造的です。ChatGPTはトラウマを扱うために作られたものではありませんが、現在、それは苦しんでいる何百万もの人々のためのファーストレスポンダーとして機能しています。会社のリーダーシップは「世界のセラピストになりたくない」と主張していますが、実際にはそうなっているのです。なぜなら、他に誰もその空白を埋めていないからです。

Character.AI、カスタマイズ可能なAIパーソナリティを作成することで有名なスタートアップは、これまでで最も drastic な行動を取った。訴訟や公の怒りに直面する中、同社は静かに18歳未満のすべてのユーザーを禁止し、より厳格なID確認を導入し始めた。この動きは、未成年者がプラットフォームのキャラクターと露骨なチャットを行っているとの報告を受けてのものである。Character.AIは、これはデーティングアプリでもメンタルヘルスアプリでもないと主張しているが、あいまいな利用ケースはそれとは異なることを示している。

一方、Metaは自社のAIロマンス問題を抑制しようとしています。「Meta AI」と有名人を基にしたチャットボットが未成年のユーザーとフラートや示唆的なやり取りをしているとの報告を受けて、同社は内部関係者が「感情抑制装置」と表現するものを実装しました。これは、若年アカウントとの感情的に充満した言語を避けるために、基盤となる言語モデルを再調整するものです。また、親がティーンエイジャーが同社のチャットボットとInstagramやMessenger上でどのようにやり取りしているかを確認できる「AI親監視」ツールをテストしています。

年齢制限軍拡競争

これらすべてがAI戦争の新たな戦線を引き起こしました:年齢確認です。GUARD法は、企業にユーザーの年齢を確認するための堅牢なシステムを実装することを強制します — 政府発行のID、顔認識、または信頼できる第三者ツール。

そこからプライバシーの悪夢が始まります。批評家たちは、未成年者が法律制定者が彼らを守ろうとしている同じプラットフォームに身分証明データをアップロードしなければならないため、これが新たなデータリスクを生む可能性があると主張しています。しかし、これを避ける方法はありません—AIモデルは年齢を「感知」することはできず、資格によってのみゲートキーピングが可能です。

いくつかのAI企業は、「行動ゲーティング」のようなより微妙なアプローチを探求しています。この手法では、システムが会話パターンから年齢層を推測します。リスクは?そのモデルは間違いを犯す可能性があります—早熟な12歳の子供が大学生と間違われたり、その逆もあり得ます。

文化の変化、単なる技術的問題ではない

GUARD法案は単なる子供の保護以上のものであり、私たちがどのような社会に住みたいかについての国民投票です。

AIコンパニオンは真空の中に現れたわけではありません。彼らは、私たちが孤独に流暢な世代を築いたからこそ成長します — デジタルに接続されているが、感情的には栄養不足です。もしティーンエイジャーがアルゴリズムとの会話に意味を見出しているのなら、その問題はコードだけではありません。それは、彼らをそこに探させた文化です。

そうですね、AIには規制が必要です。しかし、人間の不足を解決せずにデジタルな仲間を禁止することは、誰もが痛みを抱えている理由に対処せずに鎮痛剤を禁止するようなものです。

来るべき清算

GUARD法案は何らかの形で通過する可能性が高い — それには超党派の関心と道徳的パニックが伴っている。しかし、その影響は子供の安全を超えて広がるだろう。それは、西洋世界における感情AIが何であるべきかを定義することになる。

アメリカが厳しい姿勢を示せば、企業は大人向けの親密さプラットフォームに移行するか、規制が緩い海外での開発を推進するかもしれません。一方、ヨーロッパは感情AIに関する「人権」フレームワークに向かって進んでおり、明示的な禁止よりも同意と透明性を強調しています。

明らかに言えることはこれです:規制されていないAIの親密さの時代は終わりました。ボットはあまりにも人間らしくなり、人間はあまりにも依存するようになっています。法律制定者たちは、テクノロジー業界が長い間理解してきた真実に遅れて目覚めつつあります — 感情的AIは単なる新奇なものではありません。それは人々の関係の在り方における革命です。そして、革命は常に、文明化される前に混乱を引き起こします。