#### 要約* AIエンジニアのカイル・ヘスリングは、ジャクロングのクローズドモデルであるClaude Opus 4.6とGLM-5.1の蒸留ファインチューンを「フランケンマージ」と呼ばれる単一のモデルに統合した。* マージ後の「ヒール・ファインチューン」が必要で、2つの独立して訓練されたモデル間の層境界による乱れたコード出力を修正した。* このモデルは一部のタスクで過剰推論を行うが、解決可能な問題である。 QwopusがQwenとOpusを統合した点がクールだと思った? しかし、知識豊富で時間の余裕もあるAIエンジニアのカイル・ヘスリングは、そのレシピを取り、最も優れた推論モデルの一つであるGLMを加えた。結果は、18億パラメータのフランケンマージで、安価なGPUに収まり、Alibabaの最新35Bモデルを上回る性能を発揮している。パラメータとは、訓練中にニューラルネットワークに埋め込まれる数値で、調整可能なダイヤルのようなものだ。パラメータが多いほど、モデルはより多くの知識と複雑さを扱え、動作に必要なメモリも増える。ヘスリングは、AIインフラエンジニアとして、ジャクロングのQwen3.5のファインチューンを2つ積み重ねた:層0から31まではQwopus 3.5-9B-v3.5から、Claude 4.6 Opusの推論スタイルを蒸留したQwenをベースモデルとして、層32から63まではQwen 3.5-9B-GLM5.1-Distill-v1から、z.AIのGLM-5.1教師モデルの推論データで訓練されたものを、同じQwenベースの上に重ねた。仮説:モデルの前半にOpusスタイルの構造化計画を持たせ、後半にGLMの問題分解の枠組みを導入—合計64層を一つのモデルに。<span style="display:inline-block;width:0px;overflow:hidden;line-height:0" data-mce-type="bookmark" class="mce_SELRES_start"></span>この技術はパススルーフランケンマージと呼ばれ、重みのブレンドや平均化は行わず、層をそのまま積み重ねるだけだ。ヘスリングは既存のツールがQwen 3.5のハイブリッド線形/完全注意アーキテクチャをサポートしていないため、自作のマージスクリプトを書いた。結果のモデルは44の能力テストのうち40に合格し、22GBのVRAMを必要とするAlibabaのQwen 3.6-35B-A3B MoEを上回った。Q4_K_M量子化でわずか9.2GBで動作しながらだ。NVIDIA RTX 3060でも理論上は問題なく動作するはずだ。ヘスリングは、このモデル作成は簡単ではなかったと説明する。生のマージは以前は乱れたコードを出力していた。しかし、彼が公開したテストモデルは熱狂的な支持を得た。最終的な修正は「ヒール・ファインチューン」—基本的にはQLoRAのコードの一部をモデルに埋め込み、付録のようにして最終出力を強く条件付けるものだ。私たちも試したが、Qwen、Claude Opus、GLM 5.1をローカルで動かすのは魅力的だが、実際にはモデルが推論に非常に優れているため、過剰に考えすぎてしまうことがわかった。M1 MacBook上で、Mac用に最適化されたMLX量子化モデルを動かしてテストしたところ、通常のテストゲームを生成させると推論チェーンが長くなりすぎてトークン制限に達し、結果的に長い推論だけを出し、実用的な結果が得られなかった。これは、消費者向けハードウェアで本格的な用途にローカル実行したい人にとって日常的な障壁だ。少し控えめにした結果でも、依然として難しかった。例えば、「スネークゲームを書いて」というプロンプトには40分以上推論にかかり、多くの時間を要した。結果は私たちのGithubリポジトリで確認できる。これはQwopus系の既知の問題点の一つだ:ジャクロングのv2ファインチューンは、Qwen 3.5の反復的な内部ループや「より経済的に考える」傾向に対処するために作られた。64層の2つの推論蒸留を積み重ねると、その挙動が特定のプロンプトで増幅されるようだ。これは解決可能な問題であり、オープンソースコミュニティが解決する可能性が高い。重要なのは、ここでの広いパターンだ:仮名の開発者が専門的なファインチューンと完全な訓練ガイドを公開し、別の熱心なユーザーがそれらをカスタムスクリプトで積み重ね、1,000回のヒーリングステップを経て、世界最大級のAI研究所の35Bパラメータリリースを凌駕するモデルを作り出す。しかも、その全てが小さなファイルに収まる。これこそがオープンソースの価値だ—重みだけを公開する大手研究所だけでなく、層ごとの解決策や、レーダーの下で進む専門化の動きだ。開発者が増えるほど、週末のプロジェクトと最前線の展開の差は狭まる。ジャクロングはヘスリングのリポジトリをミラーリングし、そのモデルは公開から2週間で3000回以上ダウンロードされた。

このフランケンシュタインAIはClaude Opus、GLM、Qwenを統合し、トップモデルを上回る性能を発揮

要約

QwopusがQwenとOpusを統合した点がクールだと思った? しかし、知識豊富で時間の余裕もあるAIエンジニアのカイル・ヘスリングは、そのレシピを取り、最も優れた推論モデルの一つであるGLMを加えた。結果は、18億パラメータのフランケンマージで、安価なGPUに収まり、Alibabaの最新35Bモデルを上回る性能を発揮している。 パラメータとは、訓練中にニューラルネットワークに埋め込まれる数値で、調整可能なダイヤルのようなものだ。パラメータが多いほど、モデルはより多くの知識と複雑さを扱え、動作に必要なメモリも増える。 ヘスリングは、AIインフラエンジニアとして、ジャクロングのQwen3.5のファインチューンを2つ積み重ねた:層0から31まではQwopus 3.5-9B-v3.5から、Claude 4.6 Opusの推論スタイルを蒸留したQwenをベースモデルとして、層32から63まではQwen 3.5-9B-GLM5.1-Distill-v1から、z.AIのGLM-5.1教師モデルの推論データで訓練されたものを、同じQwenベースの上に重ねた。

仮説:モデルの前半にOpusスタイルの構造化計画を持たせ、後半にGLMの問題分解の枠組みを導入—合計64層を一つのモデルに。 この技術はパススルーフランケンマージと呼ばれ、重みのブレンドや平均化は行わず、層をそのまま積み重ねるだけだ。ヘスリングは既存のツールがQwen 3.5のハイブリッド線形/完全注意アーキテクチャをサポートしていないため、自作のマージスクリプトを書いた。結果のモデルは44の能力テストのうち40に合格し、22GBのVRAMを必要とするAlibabaのQwen 3.6-35B-A3B MoEを上回った。Q4_K_M量子化でわずか9.2GBで動作しながらだ。 NVIDIA RTX 3060でも理論上は問題なく動作するはずだ。

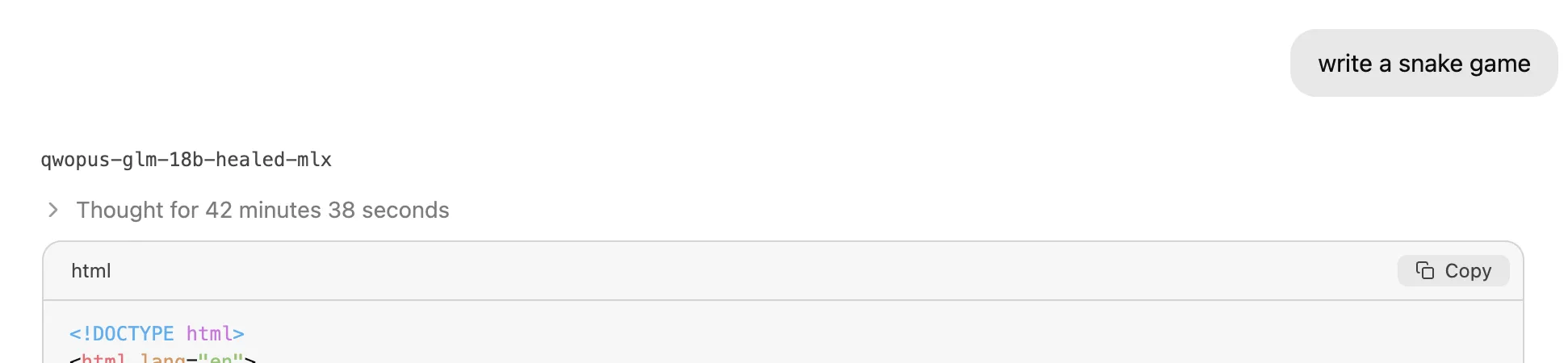

ヘスリングは、このモデル作成は簡単ではなかったと説明する。生のマージは以前は乱れたコードを出力していた。しかし、彼が公開したテストモデルは熱狂的な支持を得た。 最終的な修正は「ヒール・ファインチューン」—基本的にはQLoRAのコードの一部をモデルに埋め込み、付録のようにして最終出力を強く条件付けるものだ。 私たちも試したが、Qwen、Claude Opus、GLM 5.1をローカルで動かすのは魅力的だが、実際にはモデルが推論に非常に優れているため、過剰に考えすぎてしまうことがわかった。 M1 MacBook上で、Mac用に最適化されたMLX量子化モデルを動かしてテストしたところ、通常のテストゲームを生成させると推論チェーンが長くなりすぎてトークン制限に達し、結果的に長い推論だけを出し、実用的な結果が得られなかった。これは、消費者向けハードウェアで本格的な用途にローカル実行したい人にとって日常的な障壁だ。 少し控えめにした結果でも、依然として難しかった。例えば、「スネークゲームを書いて」というプロンプトには40分以上推論にかかり、多くの時間を要した。

結果は私たちのGithubリポジトリで確認できる。 これはQwopus系の既知の問題点の一つだ:ジャクロングのv2ファインチューンは、Qwen 3.5の反復的な内部ループや「より経済的に考える」傾向に対処するために作られた。64層の2つの推論蒸留を積み重ねると、その挙動が特定のプロンプトで増幅されるようだ。

これは解決可能な問題であり、オープンソースコミュニティが解決する可能性が高い。重要なのは、ここでの広いパターンだ:仮名の開発者が専門的なファインチューンと完全な訓練ガイドを公開し、別の熱心なユーザーがそれらをカスタムスクリプトで積み重ね、1,000回のヒーリングステップを経て、世界最大級のAI研究所の35Bパラメータリリースを凌駕するモデルを作り出す。しかも、その全てが小さなファイルに収まる。 これこそがオープンソースの価値だ—重みだけを公開する大手研究所だけでなく、層ごとの解決策や、レーダーの下で進む専門化の動きだ。開発者が増えるほど、週末のプロジェクトと最前線の展開の差は狭まる。 ジャクロングはヘスリングのリポジトリをミラーリングし、そのモデルは公開から2週間で3000回以上ダウンロードされた。