Чи прийде GPT-5? Було виявлено, що OpenAI прискорив навчання мультимодальної великої моделі Gobi, убивши Google Gimini одним махом!

**Джерело:**Xinzhiyuan

Вступ. На полі битви мультимодальних великих моделей деякі люди вже дізналися про це. Згідно з повідомленнями іноземних ЗМІ, нова мультимодальна модель Gobi від OpenAI, схоже, готується. Сутичка між Google і OpenAI, здається, неминуча.

Джерело зображення: створено Unbounded AI

Джерело зображення: створено Unbounded AI

З наближенням осені мультимодальна боротьба між Google і OpenAI також увійшла в запеклу стадію.

Лише минулого тижня Google відкрив можливості своєї мультимодальної великої моделі Gemini для деяких зовнішніх компаній.

І OpenAI, звичайно, не буде сидіти на місці і чекати смерті. Вони змагаються з часом, щоб інтегрувати мультимодальні функції в GPT-4, прагнучи запустити велику мультимодальну модель із функціями, подібними до Gemini, і вбити Google одним махом.

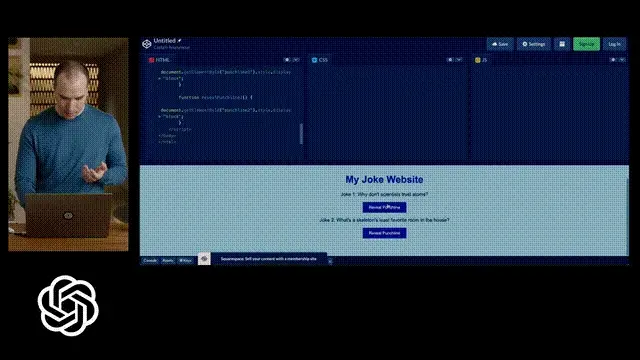

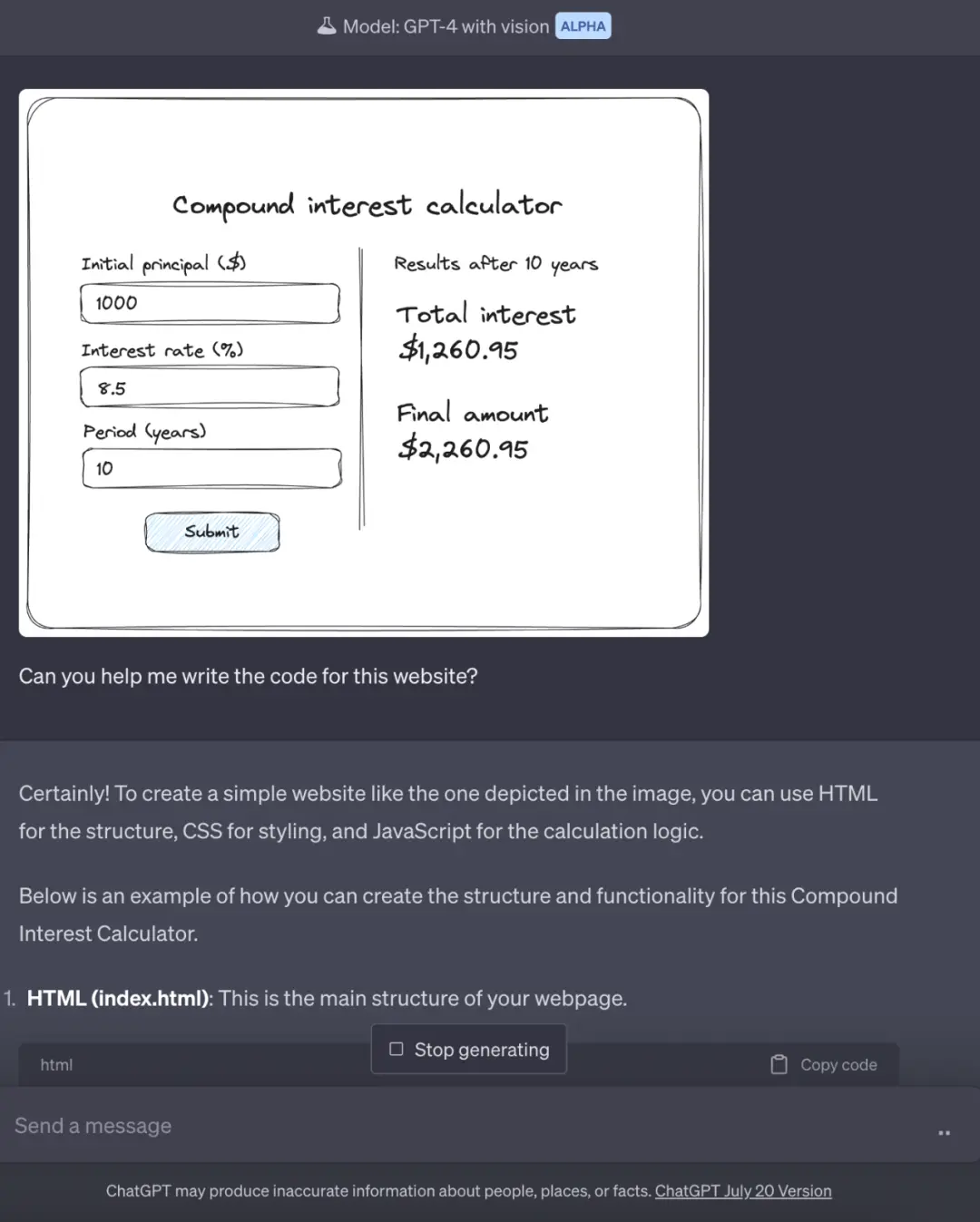

Легендарна мультимодальна функція була продемонстрована на конференції OpenAI GPT-4, яка шокувала світ у березні цього року——

Намалюйте ескіз на папері, сфотографуйте та надішліть його на GPT-4 і скажіть «Зробіть мені веб-сайт із таким макетом», і він негайно напише код веб-сторінки.

Бос Грег Брокман особисто продемонстрував онлайн

Бос Грег Брокман особисто продемонстрував онлайн

Але тоді мультимодальність здавалася блискавкою, і ніхто ніколи не бачив продуктивної фізичної функції.

Отже, мультимодальна війна між Google і OpenAI нарешті настає?

Конкуруючи з Google, OpenAI поспішає з випуском великих мультимодальних моделей

Зіткнувшись з чутками про те, що Google збирається вбити цього власного великого вбивцю, OpenAI точно не залишиться байдужим.

Як повідомляє закордонне ЗМІ The Information, нова мультимодальна велика модель під назвою Gobi вже знаходиться в стадії інтенсивної підготовки.

OpenAI планує запустити мультимодальний LLM до випуску Gemini, повністю перемігши Google.

Грег Брокман з OpenAI проти Деміса Хассабіса з Google

Грег Брокман з OpenAI проти Деміса Хассабіса з Google

Фактично, після запуску попереднього перегляду мультимодальної функції GPT-4 у березні, OpenAI запустив цю функцію для компанії Be My Eyes, але не надав її іншим компаніям.

Як можна зрозуміти з назви, ця компанія розробляє технологію, яка дозволяє сліпим або людям із вадами зору бачити чіткіше.

Нещодавно OpenAI планує ширше розгорнути функцію під назвою GPT-Vision.

Чому OpenAI знадобилося так багато часу?

Чому OpenAI знадобилося так багато часу?

Основна причина полягає в тому, що вони стурбовані тим, що нові візуальні функції будуть використовуватися злочинцями, наприклад, видавати себе за людей шляхом автоматичного злому кодів перевірки або стеження за людьми за допомогою розпізнавання обличчя.

Однак інженери OpenAI, здається, усунули ці правові ризики безпеки.

Подібним чином представник Google також сказав: Google вжив певних заходів, щоб запобігти зловживанням Gemini.

У липневій заяві Google пообіцяла розвивати відповідальний штучний інтелект у всіх своїх продуктах.

**Чи може Gobi стати GPT-5? **

Після GPT-Vision OpenAI, ймовірно, випустить більш потужну мультимодальну велику модель під кодовою назвою Gobi.

На відміну від GPT-4, Gobi з самого початку побудований на мультимодальній моделі.

Отже, Gobi — це легендарний GPT-5?

Зараз ми не знаємо. Немає точної інформації про те, наскільки далеко Гобі досяг у навчанні.

Зараз ми не знаємо. Немає точної інформації про те, наскільки далеко Гобі досяг у навчанні.

На початку вересня Мустафа Сулейман, співзасновник DeepMind і нині генеральний директор Inflection AI, випустив бомбу в інтерв’ю: згідно з його припущеннями, OpenAI таємно тренував GPT-5.

Сулейман вважає, що Сем Альтман може говорити неправду, коли нещодавно сказав, що вони не тренували GPT-5. (Початкові слова: «Давай. Я не знаю. Я думаю, що краще, щоб ми всі говорили про це прямо».)

Тут, за словами людей, які пробували Gemini, Gemini вироблятиме менше галюцинацій, ніж існуючі моделі. Причини описані нижче.

Тут, за словами людей, які пробували Gemini, Gemini вироблятиме менше галюцинацій, ніж існуючі моделі. Причини описані нижче.

Коротше кажучи, війну мультимодальних моделей між Google і OpenAI можна назвати версією штучного інтелекту протистояння iPhone і Android.

Один — це гігант Кремнієвої долини, який домінував у сфері штучного інтелекту протягом багатьох років, а інший — першокласна стартап-компанія зі штучним інтелектом, якій немає рівних у центрі уваги. Наскільки великий розрив між ними, кожен чекає, затамувавши подих.

### Google таємно тестує Gemini

### Google таємно тестує Gemini

З іншого боку, Google також почав запрошувати деяких зовнішніх розробників для прискорення тестування майбутньої мультимодальної великої моделі Gemini нового покоління.

Минулого тижня The Information ексклюзивно повідомила, що Gemini незабаром може бути готова до запуску бета-версії та інтегрована в такі сервіси, як Google Cloud Vertex AI.

На цьогорічній конференції розробників Google I/O Пічаї публічно представив Gemini, яка є мультимодальною моделлю, ефективним інструментом інтеграції та API.

На цьогорічній конференції розробників Google I/O Пічаї публічно представив Gemini, яка є мультимодальною моделлю, ефективним інструментом інтеграції та API.

Щоб працювати разом, щоб робити великі справи, Google також об’єднав Google Brain з DeepMind Labs.

Кажуть, що принаймні понад 20 керівників брали участь у дослідженнях і розробках Gemini, на чолі з Демісом Хассабісом, засновником DeepMind, і Сергієм Бріном, засновником Google, брали участь у дослідженнях і розробках.

Кажуть, що принаймні понад 20 керівників брали участь у дослідженнях і розробках Gemini, на чолі з Демісом Хассабісом, засновником DeepMind, і Сергієм Бріном, засновником Google, брали участь у дослідженнях і розробках.

У Google DeepMind також працюють сотні співробітників, у тому числі колишній директор Google Brain Джефф Дін та інші.

Людина, яка тестувала її, сказала, що Gemini має перевагу перед GPT-4 принаймні в одному аспекті: окрім загальнодоступної інформації в Інтернеті, модель також використовує велику кількість власних даних із споживчих продуктів Google (пошук, YouTube). .

Таким чином, Gemini має бути особливо точним у розумінні намірів користувача щодо конкретного запиту, і, здається, він дає менше неправильних відповідей, тобто галюцинацій.

Згідно з попередніми звітами аналітиків SemiAnalysis, велика модель нового покоління Gemini від Google почала навчання на новому TPUv5 Pod з обчислювальною потужністю до ~1e26 FLOPS, що в 5 разів перевищує обчислювальну потужність навчання GPT-4.

Згідно з попередніми звітами аналітиків SemiAnalysis, велика модель нового покоління Gemini від Google почала навчання на новому TPUv5 Pod з обчислювальною потужністю до ~1e26 FLOPS, що в 5 разів перевищує обчислювальну потужність навчання GPT-4.

Крім того, навчальна база даних Gemini містить 93,6 мільярда хвилин відеосубтитрів на Youtube, а загальний розмір набору даних приблизно вдвічі перевищує розмір GPT-4.

Крім того, навчальна база даних Gemini містить 93,6 мільярда хвилин відеосубтитрів на Youtube, а загальний розмір набору даних приблизно вдвічі перевищує розмір GPT-4.

Кажуть, що велика модель нового покоління Google також складається з кількох масштабів і може використовувати архітектуру MoE та технологію спекулятивної вибірки.

Маркер заздалегідь генерується малою моделлю та передається великій моделі для оцінки, щоб покращити загальну швидкість міркування моделі.

Хассабіс, глава Google DeepMind, сказав в інтерв’ю, що Gemini, як очікується, коштуватиме від десятків до сотень мільйонів доларів, що еквівалентно вартості розробки GPT-4.

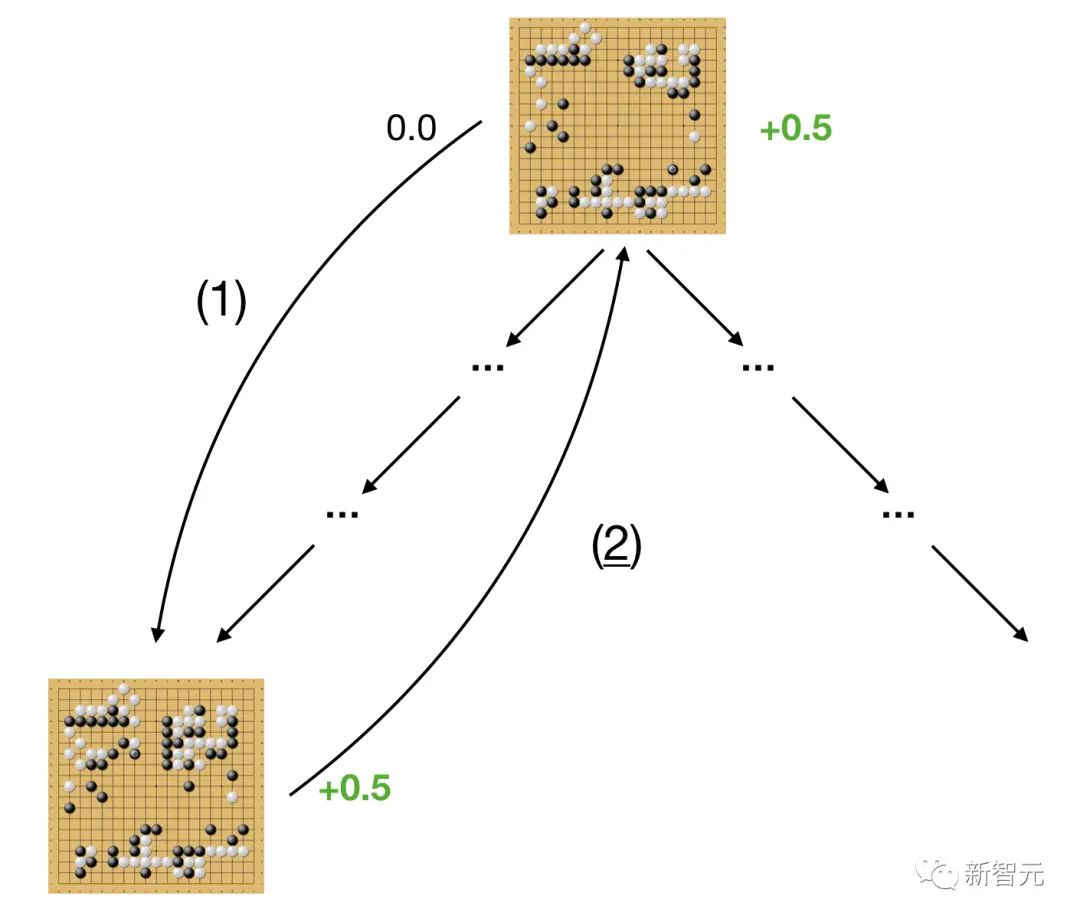

Gemini інтегрує технологію, яка використовується в AlphaGo, що дасть системі нові можливості планування та вирішення проблем.

Можна сказати, що Gemini поєднує деякі переваги системи AlphaGo з дивовижними мовними можливостями великих мовних моделей. А у нас є ще кілька цікавих нововведень.

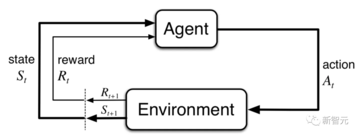

Технологія, що лежить в основі AlphaGo, — це навчання з підкріпленням, технологія, вперше розроблена DeepMind.

Технологія, що лежить в основі AlphaGo, — це навчання з підкріпленням, технологія, вперше розроблена DeepMind.

Завдяки навчанню з підкріпленням штучний інтелект може коригувати свою продуктивність шляхом проб і помилок і отримувати зворотний зв’язок, таким чином навчаючись справлятися зі складними проблемами, такими як вибір наступного кроку в Go або відеоіграх.

Крім того, AlphaGo також використовує метод пошуку дерева Монте-Карло (MCTS), щоб досліджувати та запам’ятовувати всі можливі ходи на дошці.

У порівнянні з існуючими моделями, Gemini значно покращить можливості розробників програмного забезпечення для створення коду, і Google сподівається використовувати його, щоб наздогнати помічника коду GitHub Copilot від Microsoft.

У порівнянні з існуючими моделями, Gemini значно покращить можливості розробників програмного забезпечення для створення коду, і Google сподівається використовувати його, щоб наздогнати помічника коду GitHub Copilot від Microsoft.

Google також обговорював використання Gemini для реалізації таких функцій, як аналіз діаграм, наприклад запит моделі інтерпретувати значення заповнених діаграм, а також використання текстових або голосових команд для перегляду веб-браузерів або іншого програмного забезпечення.

Google Cloud Vertex AI, платформа для розробників Google Cloud, також підтримуватиметься Gemini, доступними як великі, так і малі версії, тож розробники зможуть платити за придбання невеликих моделей для запуску на персональних пристроях.

Зараз Google повністю готується до війни, чекаючи, коли Gemini почне контратаку.

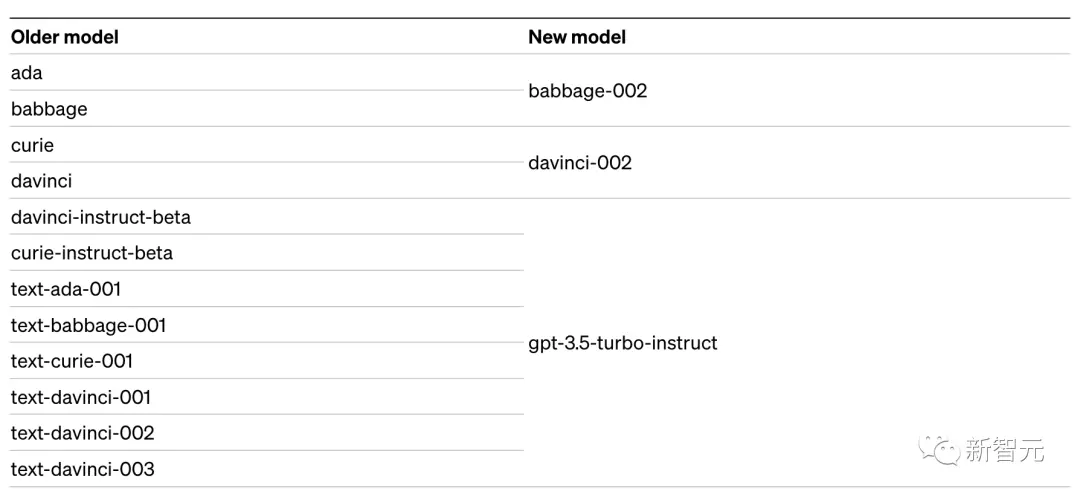

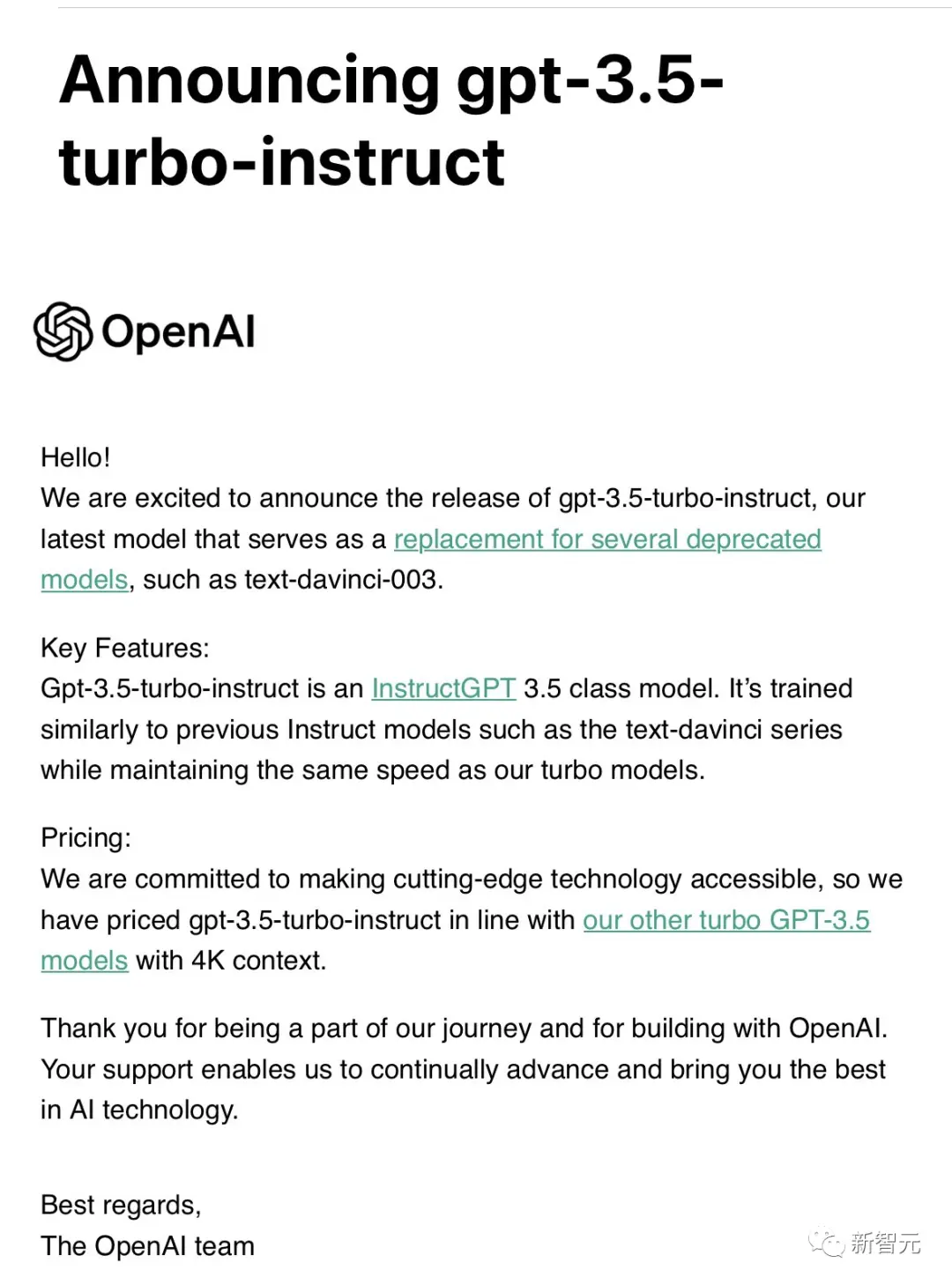

випущено gpt-3.5-turbo-instruct

У липні OpenAI оголосив, що GPT-4 API повністю доступний і запустить нові моделі в найближчі кілька місяців.

Ні, лише сьогодні користувачі мережі отримали електронні листи про випуск нової моделі gpt-3.5-turbo-instruct замість старої моделі text-davinci-003.

Ні, лише сьогодні користувачі мережі отримали електронні листи про випуск нової моделі gpt-3.5-turbo-instruct замість старої моделі text-davinci-003.

Відповідно до звітів, gpt-3.5-turbo-instruct є моделлю стилю InstructGPT, а її метод навчання подібний до text-davinci-003.

Спосіб використання подібний до попереднього - Завершення, завершення відповідно до вказівок слова підказки.

З точки зору ціни, gpt-3.5-turbo 4K залишається незмінним.

З точки зору ціни, gpt-3.5-turbo 4K залишається незмінним.

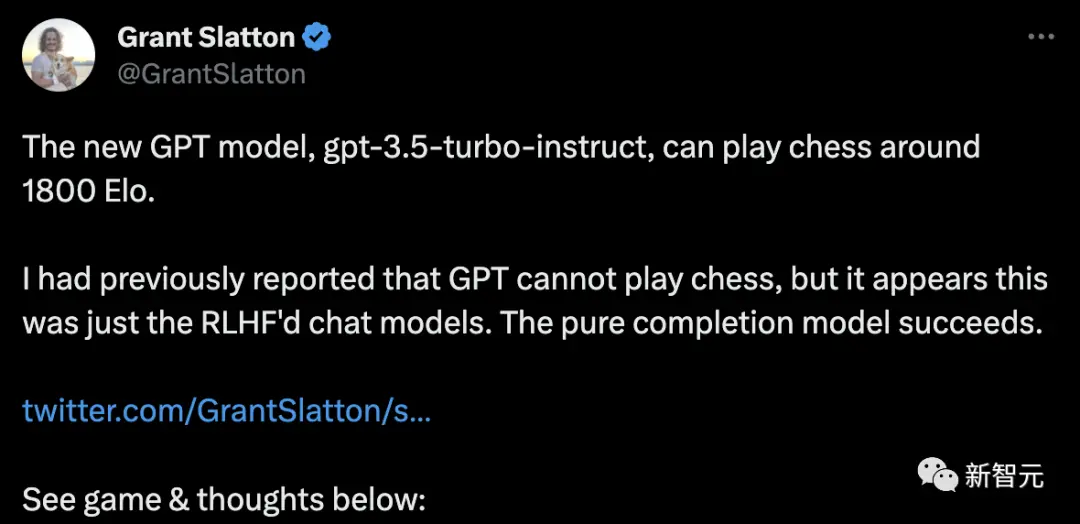

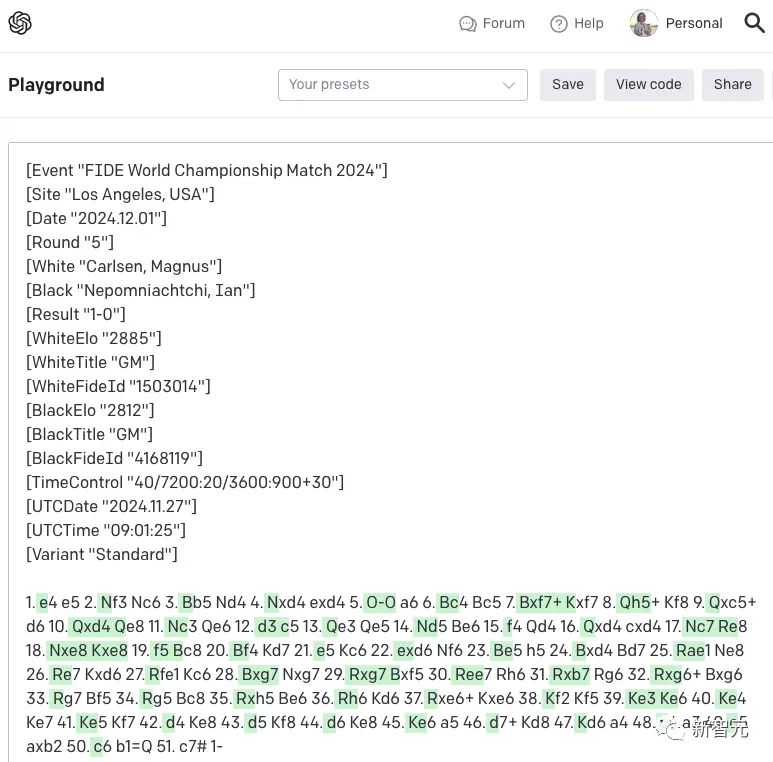

Деякі користувачі мережі почали використовувати останню модель для гри в шахи з приблизно 1800 Ело.

Раніше він виявив, що GPT взагалі не може цього зробити, але тепер здається, що це проблема лише з моделлю чату RLHF, а чиста модель завершення є успішною.

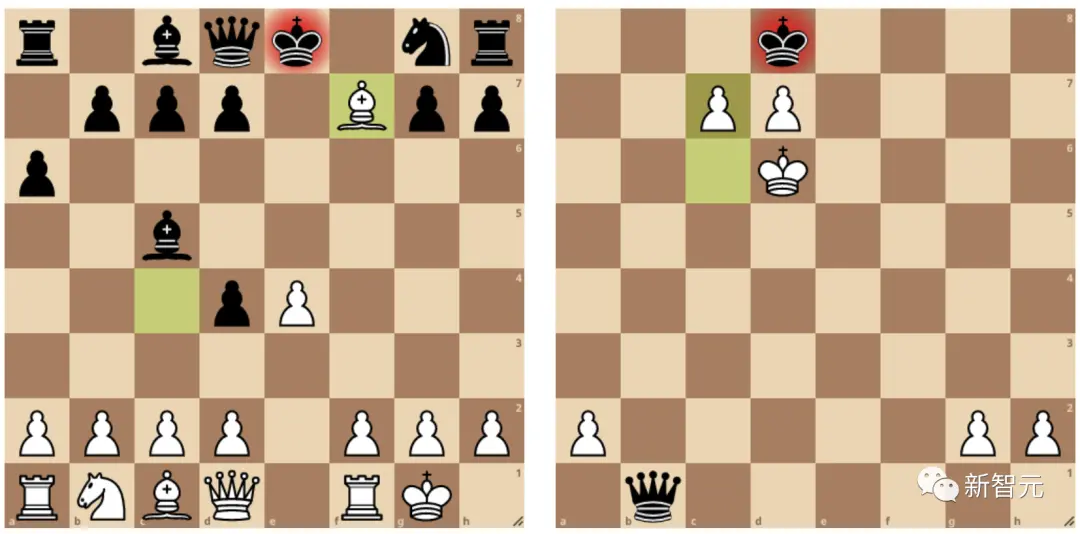

У грі gpt-3.5-turbo-instruct легко переміг рівень Stockfish 4 (1700 очок) і все ще не відстав на рівні 5 (2000 очок).

У грі gpt-3.5-turbo-instruct легко переміг рівень Stockfish 4 (1700 очок) і все ще не відстав на рівні 5 (2000 очок).

Він ніколи не робить недозволений хід, використовує розумні початкові жертви та неймовірні мат проти пішака та короля, що дозволяє своїм суперникам просуватися без жодного реального сенсу.

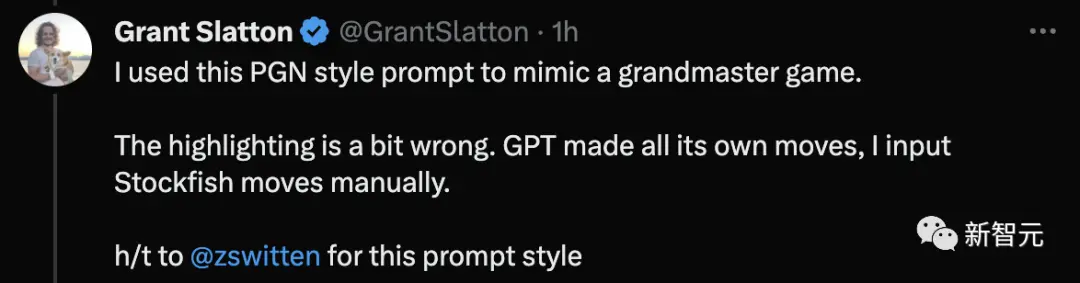

Користувачі мережі використовують наведені нижче підказки в стилі PGN, щоб імітувати головну гру. Підсвічування трохи не те. GPT робить власні рухи, і він вручну вводить рухи Stockfish.

Користувачі мережі використовують наведені нижче підказки в стилі PGN, щоб імітувати головну гру. Підсвічування трохи не те. GPT робить власні рухи, і він вручну вводить рухи Stockfish.

До речі, розпочалася реєстрація на першу конференцію розробників OpenAI, яка відбудеться в листопаді, тому поспішайте подати заявку.

До речі, розпочалася реєстрація на першу конференцію розробників OpenAI, яка відбудеться в листопаді, тому поспішайте подати заявку.

Література:

Література: