Ф'ючерси

Сотні безстрокових контрактів

TradFi

Золото

Одна платформа для світових активів

Опціони

Hot

Торгівля ванільними опціонами європейського зразка

Єдиний рахунок

Максимізуйте ефективність вашого капіталу

Демо торгівля

Вступ до ф'ючерсної торгівлі

Підготуйтеся до ф’ючерсної торгівлі

Ф'ючерсні події

Заробляйте, беручи участь в подіях

Демо торгівля

Використовуйте віртуальні кошти для безризикової торгівлі

Запуск

CandyDrop

Збирайте цукерки, щоб заробити аірдропи

Launchpool

Швидкий стейкінг, заробляйте нові токени

HODLer Airdrop

Утримуйте GT і отримуйте масові аірдропи безкоштовно

Pre-IPOs

Отримайте повний доступ до глобальних IPO акцій.

Alpha Поінти

Ончейн-торгівля та аірдропи

Ф'ючерсні бали

Заробляйте фʼючерсні бали та отримуйте аірдроп-винагороди

Інвестиції

Simple Earn

Заробляйте відсотки за допомогою неактивних токенів

Автоінвестування

Автоматичне інвестування на регулярній основі

Подвійні інвестиції

Прибуток від волатильності ринку

Soft Staking

Earn rewards with flexible staking

Криптопозика

0 Fees

Заставте одну криптовалюту, щоб позичити іншу

Центр кредитування

Єдиний центр кредитування

Центр багатства VIP

Преміальні плани зростання капіталу

Управління приватним капіталом

Розподіл преміальних активів

Квантовий фонд

Квантові стратегії найвищого рівня

Стейкінг

Стейкайте криптовалюту, щоб заробляти на продуктах PoS

Розумне кредитне плече

Кредитне плече без ліквідації

Випуск GUSD

Мінтинг GUSD для прибутку RWA

Акції

AI

Gate AI

Ваш універсальний AI-помічник для спілкування

Gate AI Bot

Використовуйте Gate AI безпосередньо у своєму соціальному додатку

GateClaw

Gate Блакитний Лобстер — готовий до використання

Gate for AI Agent

AI-інфраструктура, Gate MCP, Skills і CLI

Gate Skills Hub

Понад 10 000 навичок

Від офісу до трейдингу: універсальна база навичок для ефективнішої роботи з AI

GateRouter

Розумний вибір із понад 40 моделей ШІ, без додаткових витрат (0%)

Розкриття трансформера в iPhone: на основі архітектури GPT-2 слово segmenter містить емодзі, створені випускниками MIT

Оригінальне джерело: Qubits

«Секрет» трансформера від Apple розкрили ентузіасти.

На хвилі великих моделей, навіть якщо ви такий консервативний, як Apple, ви повинні згадувати «Трансформер» на кожній прес-конференції.

Наприклад, на цьогорічному WWDC Apple оголосила, що нові версії iOS і macOS матимуть вбудовані мовні моделі Transformer, щоб забезпечити методи введення з можливостями передбачення тексту.

Хлопець на ім’я Джек Кук перевернув бета-версію macOS Sonoma з ніг на голову та дізнався багато свіжої інформації:

Давайте розглянемо докладніше.

На основі архітектури GPT-2

По-перше, давайте розглянемо, які функції мовна модель Apple на основі Transformer може реалізувати на iPhone, MacBook та інших пристроях.

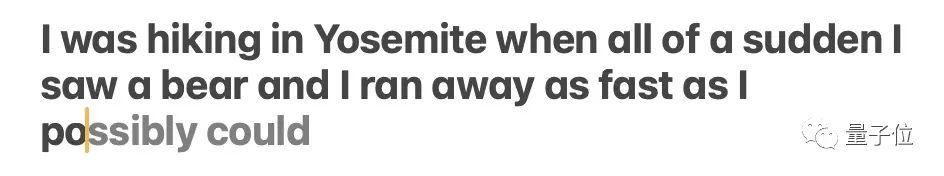

В основному відбивається на способі введення. Власний метод введення Apple, який підтримується мовною моделлю, може використовувати функції прогнозування слів і виправлення помилок.

** **### △Джерело: публікація в блозі Джека Кука

**### △Джерело: публікація в блозі Джека Кука

Модель іноді передбачає кілька наступних слів, але це обмежено ситуаціями, коли семантика речення дуже очевидна, подібно до функції автозаповнення в Gmail.

** **### △Джерело: публікація в блозі Джека Кука

**### △Джерело: публікація в блозі Джека Кука

Так де саме встановлена ця модель? Після деяких глибоких копань брат Кук визначив:

Оскільки:

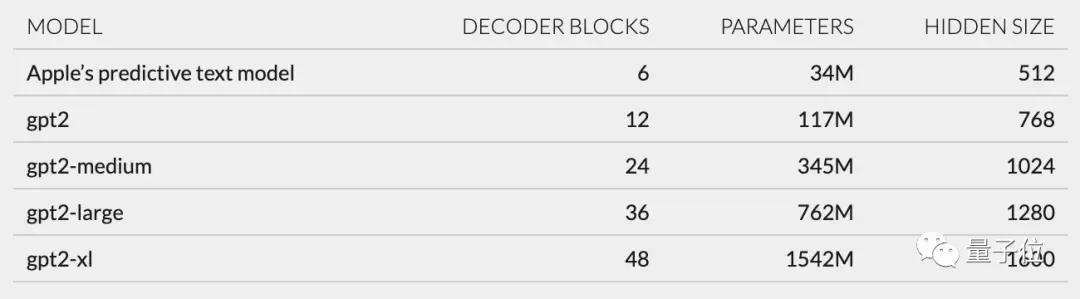

Крім того, на основі структури мережі, описаної в unilm_joint_cpu, я припустив, що модель Apple базується на архітектурі GPT-2:

В основному він включає вбудовування маркерів, кодування позиції, блок декодера та вихідний рівень. Кожен блок декодера має такі слова, як gpt2_transformer_layer_3d.

** **### △Джерело: публікація в блозі Джека Кука

**### △Джерело: публікація в блозі Джека Кука

Виходячи з розміру кожного шару, я також припустив, що модель Apple має приблизно 34 мільйони параметрів, а розмір прихованого шару становить 512. Тобто він менший за найменшу версію GPT-2.

Я вважаю, що це головним чином тому, що Apple хоче модель, яка споживає менше енергії, але може працювати швидко та часто.

Офіційна заява Apple на WWDC полягає в тому, що «кожного натискання клавіші iPhone запускатиме модель один раз».

Однак це також означає, що ця модель передбачення тексту не дуже добре продовжує речення або абзаци повністю.

** **### △Джерело: публікація в блозі Джека Кука

**### △Джерело: публікація в блозі Джека Кука

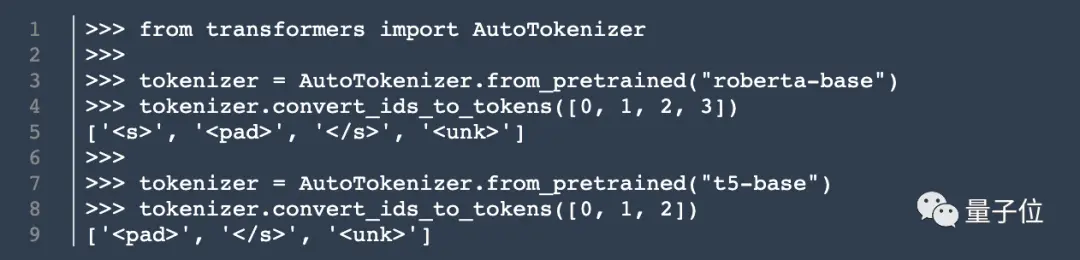

Крім архітектури моделі, Кук також розкопав інформацію про токенизатор.

У unilm.bundle/sp.dat він знайшов набір із 15 000 токенів, варто зазначити, що він містить 100 емодзі.

Кухар розкриває Кука

Хоча цей кухар не кухар, мій допис у блозі все одно привернув багато уваги, щойно його опублікували.

Раніше він стажувався в NVIDIA, зосереджуючись на дослідженні мовних моделей, таких як BERT. Він також є старшим інженером з досліджень і розробок обробки природної мови в The New York Times.

Отже, його одкровення також викликало у вас якісь думки? Ласкаво просимо поділитися своїми думками в області коментарів ~

Оригінальне посилання: