Ф'ючерси

Сотні безстрокових контрактів

CFD

Золото

Одна платформа для світових активів

Опціони

Hot

Торгівля ванільними опціонами європейського зразка

Єдиний рахунок

Максимізуйте ефективність вашого капіталу

Демо торгівля

Вступ до ф'ючерсної торгівлі

Підготуйтеся до ф’ючерсної торгівлі

Ф'ючерсні події

Заробляйте, беручи участь в подіях

Демо торгівля

Використовуйте віртуальні кошти для безризикової торгівлі

Запуск

CandyDrop

Збирайте цукерки, щоб заробити аірдропи

Launchpool

Швидкий стейкінг, заробляйте нові токени

HODLer Airdrop

Утримуйте GT і отримуйте масові аірдропи безкоштовно

Pre-IPOs

Отримайте повний доступ до глобальних IPO акцій.

Alpha Поінти

Ончейн-торгівля та аірдропи

Ф'ючерсні бали

Заробляйте фʼючерсні бали та отримуйте аірдроп-винагороди

Інвестиції

Simple Earn

Заробляйте відсотки за допомогою неактивних токенів

Автоінвестування

Автоматичне інвестування на регулярній основі

Подвійні інвестиції

Прибуток від волатильності ринку

Soft Staking

Earn rewards with flexible staking

Криптопозика

0 Fees

Заставте одну криптовалюту, щоб позичити іншу

Центр кредитування

Єдиний центр кредитування

Центр багатства VIP

Преміальні плани зростання капіталу

Управління приватним капіталом

Розподіл преміальних активів

Квантовий фонд

Квантові стратегії найвищого рівня

Стейкінг

Стейкайте криптовалюту, щоб заробляти на продуктах PoS

Розумне кредитне плече

Кредитне плече без ліквідації

Випуск GUSD

Мінтинг GUSD для прибутку RWA

Акції

AI

Gate AI

Ваш універсальний AI-помічник для спілкування

Gate AI Bot

Використовуйте Gate AI безпосередньо у своєму соціальному додатку

GateClaw

Gate Блакитний Лобстер — готовий до використання

Gate for AI Agent

AI-інфраструктура, Gate MCP, Skills і CLI

Gate Skills Hub

Понад 10 000 навичок

Від офісу до трейдингу: універсальна база навичок для ефективнішої роботи з AI

GateRouter

Розумний вибір із понад 40 моделей ШІ, без додаткових витрат (0%)

Ваш штучний інтелект-чатбот може витікати ваші розмови до Meta, TikTok і Google

Коротко

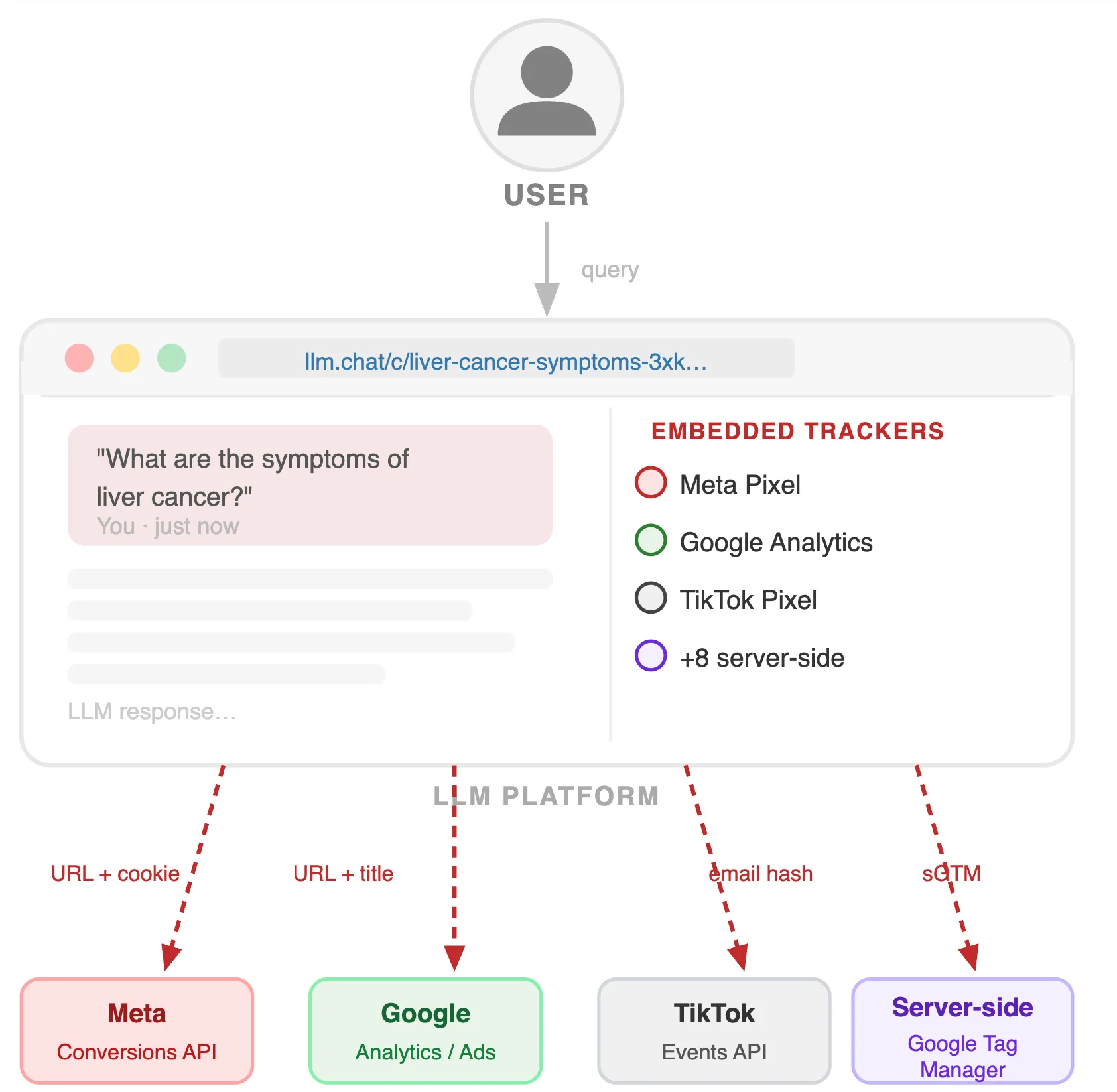

Коли ви щось вводите у чат-боті AI, ви, ймовірно, припускаєте, що розмова залишається між вами та машиною. Ви помиляєтеся — і нове дослідження чітко показує, хто ще слухає. Дослідники з Інституту IMDEA Networks опублікували результати 4 травня, показуючи, що всі чотири найбільші помічники AI — ChatGPT, Claude, Grok і Perplexity — тихо діляться даними з сторонніми сервісами реклами та аналітики, включаючи Meta, Google і TikTok. Проєкт, під назвою LeakyLM, виявив понад 13 трекерів, вбудованих у ці платформи. Жоден з них не розкривається користувачам зрозумілою мовою.

Зображення: Інститут IMDEA Networks

Уявіть так: кожного разу, коли ви відкриваєте чат, невидимі програмні засоби, вбудовані у веб-сторінку, дзвонять додому до рекламних мереж — передаючи деталі про вас, про те, на якій сторінці ви перебуваєте, і іноді навіть про те, що ви ввели. Що фактично витікає Найпростіша витік — це URL вашої розмови — веб-адреса, яка вказує на конкретний чат. Звучить безпечно, правда? Проблема в тому, що кілька платформ роблять ці URL публічно доступними за замовчуванням, тобто будь-хто, хто має посилання, може прочитати вашу розмову без входу в систему. Коли ці URL також надсилаються до систем реклами Meta або Google, ці компанії отримують можливість доступу та читання ваших чатів. “Витік URL — це не просто метадані, — кажуть дослідники, — це може бути еквівалентом витоку самої розмови.” Grok, AI-чатбот від Elon Musk з xAI, є найбільш відкритим. Гостеві розмови за замовчуванням є публічними на платформі — входу не потрібно, щоб їх прочитати. Трекер TikTok отримував не лише URL-адреси, а й дослівний вміст повідомлень через так звані метадані Open Graph, стандарт, який використовується для створення попередніх зображень при поширенні посилання. Фактично, система TikTok отримувала скріншот вашої розмови.

Зображення: Інститут IMDEA Networks

Claude (Anthropic) і ChatGPT (OpenAI) мають більш жорсткий контроль доступу — ваші чати не є публічними, якщо ви не вирішите їх поділитися. Але вони все одно передають URL-адреси розмов і ідентифікаційні дані, такі як рекламні файли cookie, до Meta і Google. Для Claude ці дані передаються через 11 рекламних платформ через сервери Anthropic, а не через браузер, тому блокувальник реклами цього не зупинить. Perplexity минулого місяця видалив свій трекер Meta. Що ви можете зробити Дослідження визнає, що воно не довело, що Meta або Google дійсно читали чиїсь чати. Але інфраструктура для цього існує, і дані передаються. “Обрані LLM пропонують засоби контролю приватності для обмеження видимості розмов, але можуть вводити користувачів в оману, натякаючи на більш сильний захист, ніж він фактично забезпечений,” стверджують дослідники. «Хоча у нас ще немає доказів, що трекери читають розмови, поширення постійних посилань і, відповідно, здатність їх читати існує, і тому потенційний ризик є.» Це не перший випадок, коли платформи AI стикаються з питаннями приватності. Нещодавно Claude почав вимагати підтвердження особи державним посвідченням для нових підписників — крок, який викликав обурення тих користувачів, які перейшли з ChatGPT через побоювання щодо спостереження, повідомляє Decrypt минулого місяця. Поки що практичних кроків обмежено. На Grok обмежте видимість розмов у налаштуваннях і явно відкличте будь-яке посилання, яке ви вже поділилися. На Claude хоча б відмовтеся від необов’язкових файлів cookie — це принаймні вимикає Meta Pixel. На Perplexity зробіть розмови приватними. На ChatGPT відмовтеся від файлів cookie там, де можливо, щоб зменшити ризик, хоча Google Analytics все ще працює для безкоштовних користувачів із входом. Якщо хочете ще глибше і бути повністю захищеними, наш посібник з приватності AI може стати хорошим ресурсом для ознайомлення. Дослідники планують розширити свій аналіз на Meta AI, Microsoft Copilot і Google Gemini — їх виключили з цього раунду, оскільки вони працюють як одночасно провайдери AI, так і рекламні компанії, що ускладнює модель загрози. Результати були подані до органів захисту даних 13 квітня 2026 року. xAI було повідомлено 17 квітня. На момент публікації жодна компанія не відповіла.