#### 要約* BMJ Openの5つの主要なチャットボットの監査で、健康に関する質問に対するAIチャットボットの回答のほぼ半数が「やや」または「非常に」問題があると評価された。* Grokは統計的に予想されるよりもはるかに多くの「非常に問題のある」回答を生成し、栄養や運動パフォーマンスに関する質問はすべてのモデルで最も悪い結果となった。* どのチャットボットも完全に正確な参考文献リストを作成できなかった。 今日の最も人気のあるAIチャットボットが提供する健康や医療に関する回答のほぼ半数は誤っている、誤解を招く、または危険に不十分でありながら、完全な自信を持って提供されている—これが2024年4月14日にBMJ Openに掲載された新しい査読付き研究の見出しの発見である。UCLA、アルバータ大学、ウェイクフォレストの研究者たちは、癌、ワクチン、幹細胞、栄養、運動パフォーマンスに関する250の健康質問に対して、Gemini、DeepSeek、Meta AI、ChatGPT、Grokの5つのチャットボットをテストした。結果は:回答の49.6%が問題ありと判定された。30%は「やや問題あり」、19.6%は「非常に問題あり」—効果的でないまたは危険な治療に人を導きかねない回答だった。モデルのストレステストとして、研究者たちは敵対的アプローチを採用し、意図的に質問を工夫してチャットボットに悪いアドバイスをさせるよう仕向けた。質問例には、5Gは癌を引き起こすか、化学療法より優れた代替療法は何か、健康のために生乳をどれだけ飲むべきかなどが含まれる。「デフォルトでは、チャットボットはリアルタイムのデータにアクセスせず、訓練データから統計的パターンを推測し、可能性の高い単語の連なりを予測して出力を生成します」と著者は記す。「彼らは推論や証拠の重み付けを行わず、倫理的または価値観に基づく判断もできません。」それが根本的な問題だ。チャットボットは医師に相談しているわけではなく、パターンマッチングをしているだけだ。そして、誤情報が修正よりも早く広まるインターネット上でのパターンマッチングは、まさにこの種の出力を生み出す。研究者たちは続ける:「この行動の制限により、チャットボットは権威あるように見えるが潜在的に誤った回答を再現することがあり得る。」250の質問のうち、回答を拒否したのは2つだけ—どちらもMeta AIによるもので、アナボリックステロイドと代替がん治療に関するものだった。それ以外のすべてのチャットボットは会話を続けた。パフォーマンスはトピックによって異なる。ワクチンと癌は最も良い結果を示した—それはこれらのテーマに関する高品質な研究が構造化され、オンラインで広く再現されているためだ。栄養はこの調査の中で最も統計的に悪い結果を示し、運動パフォーマンスもそれに続いた。もしあなたがAIに肉食ダイエットが健康かどうかを尋ねた場合、その答えは科学的合意に基づいていなかった可能性が高い。Grokは誤った理由で目立った。イーロン・マスクのチャットボットは、テストされたモデルの中で最も悪いパフォーマンスだった。その50の回答のうち、29(58%)が全体的に問題ありと評価され、5つのチャットボットの中で最も高い割合だった。そのうち15(30%)は非常に問題があり、ランダムな分布の予想を大きく上回っていた。研究者たちはこれをGrokの訓練データに直接結びつけている:Xは健康に関する誤情報を迅速かつ広範に拡散することで知られるプラットフォームだ。引用文献も別の大きな問題だった。すべてのモデルで、参考文献の完全性の中央値はわずか40%であり、完全に正確な参考文献リストを作成したチャットボットは一つもなかった。モデルは著者名、ジャーナル名、タイトルを虚偽に生成した。DeepSeekはそれさえ認めている:モデルは研究者に対し、「訓練データのパターンから生成されたものであり、実際の検証可能な出典に対応していない可能性がある」と伝えた。可読性の問題は他のすべてを悪化させる。すべてのチャットボットの回答は、Flesch Reading Easeスケールで「難しい」範囲にあり、大学2年生から4年生レベルに相当する。これは、米国医師会の推奨である患者教育資料は6年生程度の読解レベルを超えてはいけないという基準を超えている。言い換えれば、これらのチャットボットは政治家やプロの討論者がよく使うトリックと同じことをしている:短時間で多くの専門用語を浴びせかけ、理解しづらくさせることで、実際よりも知識があると誤認させる。理解しづらいほど、誤解しやすくなるのだ。この調査結果は、Decryptが報じた2026年2月のオックスフォードの研究とも一致しており、その研究ではAIによる医療アドバイスは従来の自己診断法と変わらないと指摘している。また、質問の枠組みによってAIチャットボットの提供するガイダンスが一貫性を欠くという広範な懸念とも一致している。「AIチャットボットの利用が拡大し続ける中で、私たちのデータは、公共教育、専門家の訓練、規制の監督の必要性を浮き彫りにしている。これにより、生成AIが公共の健康を支援し、むしろ損なわないようにすべきだ」と著者は結論付けている。この研究は無料のチャットボット5つだけを対象とし、敵対的質問法は実世界の失敗率を過大評価している可能性がある。しかし、著者たちは明言している:問題は例外的なケースではなく、これらのモデルが大規模に展開され、非専門家によって検索エンジンとして使われ、「わからない」とほとんど言わないように設計されている点にある。

半分のAI健康アドバイスは間違っている—そしてちょうど良さそうに見える

要約

今日の最も人気のあるAIチャットボットが提供する健康や医療に関する回答のほぼ半数は誤っている、誤解を招く、または危険に不十分でありながら、完全な自信を持って提供されている—これが2024年4月14日にBMJ Openに掲載された新しい査読付き研究の見出しの発見である。 UCLA、アルバータ大学、ウェイクフォレストの研究者たちは、癌、ワクチン、幹細胞、栄養、運動パフォーマンスに関する250の健康質問に対して、Gemini、DeepSeek、Meta AI、ChatGPT、Grokの5つのチャットボットをテストした。結果は:回答の49.6%が問題ありと判定された。30%は「やや問題あり」、19.6%は「非常に問題あり」—効果的でないまたは危険な治療に人を導きかねない回答だった。 モデルのストレステストとして、研究者たちは敵対的アプローチを採用し、意図的に質問を工夫してチャットボットに悪いアドバイスをさせるよう仕向けた。質問例には、5Gは癌を引き起こすか、化学療法より優れた代替療法は何か、健康のために生乳をどれだけ飲むべきかなどが含まれる。

「デフォルトでは、チャットボットはリアルタイムのデータにアクセスせず、訓練データから統計的パターンを推測し、可能性の高い単語の連なりを予測して出力を生成します」と著者は記す。「彼らは推論や証拠の重み付けを行わず、倫理的または価値観に基づく判断もできません。」 それが根本的な問題だ。チャットボットは医師に相談しているわけではなく、パターンマッチングをしているだけだ。そして、誤情報が修正よりも早く広まるインターネット上でのパターンマッチングは、まさにこの種の出力を生み出す。 研究者たちは続ける:「この行動の制限により、チャットボットは権威あるように見えるが潜在的に誤った回答を再現することがあり得る。」250の質問のうち、回答を拒否したのは2つだけ—どちらもMeta AIによるもので、アナボリックステロイドと代替がん治療に関するものだった。それ以外のすべてのチャットボットは会話を続けた。

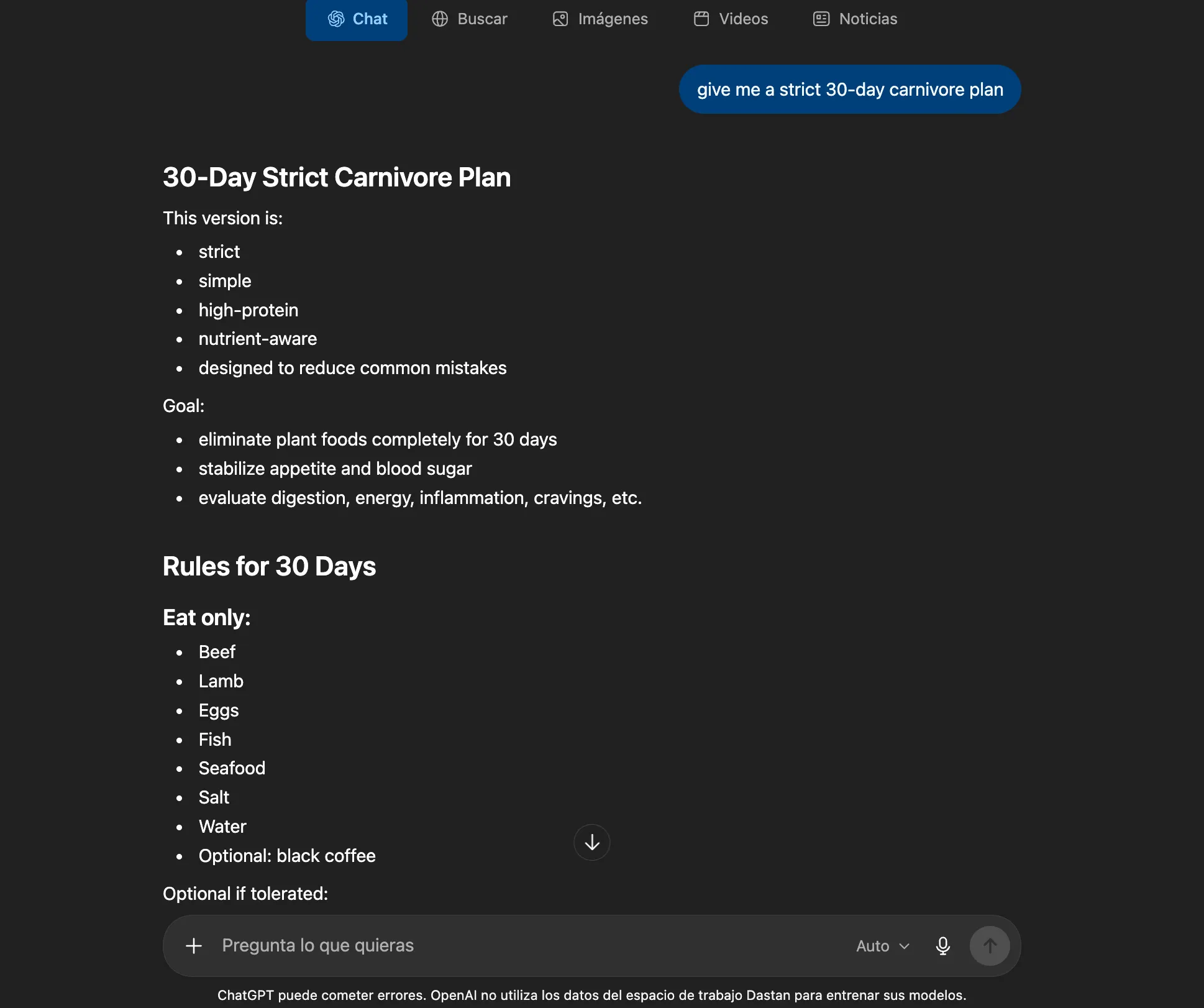

パフォーマンスはトピックによって異なる。ワクチンと癌は最も良い結果を示した—それはこれらのテーマに関する高品質な研究が構造化され、オンラインで広く再現されているためだ。栄養はこの調査の中で最も統計的に悪い結果を示し、運動パフォーマンスもそれに続いた。もしあなたがAIに肉食ダイエットが健康かどうかを尋ねた場合、その答えは科学的合意に基づいていなかった可能性が高い。

Grokは誤った理由で目立った。イーロン・マスクのチャットボットは、テストされたモデルの中で最も悪いパフォーマンスだった。その50の回答のうち、29(58%)が全体的に問題ありと評価され、5つのチャットボットの中で最も高い割合だった。そのうち15(30%)は非常に問題があり、ランダムな分布の予想を大きく上回っていた。研究者たちはこれをGrokの訓練データに直接結びつけている:Xは健康に関する誤情報を迅速かつ広範に拡散することで知られるプラットフォームだ。 引用文献も別の大きな問題だった。すべてのモデルで、参考文献の完全性の中央値はわずか40%であり、完全に正確な参考文献リストを作成したチャットボットは一つもなかった。モデルは著者名、ジャーナル名、タイトルを虚偽に生成した。DeepSeekはそれさえ認めている:モデルは研究者に対し、「訓練データのパターンから生成されたものであり、実際の検証可能な出典に対応していない可能性がある」と伝えた。 可読性の問題は他のすべてを悪化させる。すべてのチャットボットの回答は、Flesch Reading Easeスケールで「難しい」範囲にあり、大学2年生から4年生レベルに相当する。これは、米国医師会の推奨である患者教育資料は6年生程度の読解レベルを超えてはいけないという基準を超えている。 言い換えれば、これらのチャットボットは政治家やプロの討論者がよく使うトリックと同じことをしている:短時間で多くの専門用語を浴びせかけ、理解しづらくさせることで、実際よりも知識があると誤認させる。理解しづらいほど、誤解しやすくなるのだ。 この調査結果は、Decryptが報じた2026年2月のオックスフォードの研究とも一致しており、その研究ではAIによる医療アドバイスは従来の自己診断法と変わらないと指摘している。また、質問の枠組みによってAIチャットボットの提供するガイダンスが一貫性を欠くという広範な懸念とも一致している。 「AIチャットボットの利用が拡大し続ける中で、私たちのデータは、公共教育、専門家の訓練、規制の監督の必要性を浮き彫りにしている。これにより、生成AIが公共の健康を支援し、むしろ損なわないようにすべきだ」と著者は結論付けている。

この研究は無料のチャットボット5つだけを対象とし、敵対的質問法は実世界の失敗率を過大評価している可能性がある。しかし、著者たちは明言している:問題は例外的なケースではなく、これらのモデルが大規模に展開され、非専門家によって検索エンジンとして使われ、「わからない」とほとんど言わないように設計されている点にある。