Фьючерсы

Доступ к сотням фьючерсов

CFD

Золото

Одна платформа мировых активов

Опционы

Hot

Торги опционами Vanilla в европейском стиле

Единый счет

Увеличьте эффективность вашего капитала

Демо-торговля

Введение в торговлю фьючерсами

Подготовьтесь к торговле фьючерсами

Фьючерсные события

Получайте награды в событиях

Демо-торговля

Используйте виртуальные средства для торговли без риска

Запуск

CandyDrop

Собирайте конфеты, чтобы заработать аирдропы

Launchpool

Быстрый стейкинг, заработайте потенциальные новые токены

HODLer Airdrop

Удерживайте GT и получайте огромные аирдропы бесплатно

Pre-IPOs

Откройте полный доступ к глобальным IPO акций

Alpha Points

Торгуйте и получайте аирдропы

Фьючерсные баллы

Зарабатывайте баллы и получайте награды аирдропа

Инвестиции

Simple Earn

Зарабатывайте проценты с помощью неиспользуемых токенов

Автоинвест.

Автоинвестиции на регулярной основе.

Бивалютные инвестиции

Доход от волатильности рынка

Мягкий стейкинг

Получайте вознаграждения с помощью гибкого стейкинга

Криптозаймы

0 Fees

Заложите одну криптовалюту, чтобы занять другую

Центр кредитования

Единый центр кредитования

Рекламные акции

AI

Gate AI

Ваш универсальный AI-ассистент для любых задач

Gate AI Bot

Используйте Gate AI прямо в вашем социальном приложении

GateClaw

Gate Синий Лобстер — готов к использованию

Gate for AI Agent

AI-инфраструктура: Gate MCP, Skills и CLI

Gate Skills Hub

Более 10 тыс навыков

От офиса до трейдинга: единая база навыков для эффективного использования ИИ

GateRouter

Умный выбор из более чем 40 моделей ИИ, без дополнительных затрат (0%)

Ваш AI-чатбот может утекать ваши беседы в Meta, TikTok и Google

Вкратце

Когда вы вводите что-то в чат-боте ИИ, вы, вероятно, предполагаете, что разговор остается между вами и машиной. Вы ошибаетесь — и новое исследование подробно объясняет, кто еще слушает. Исследователи из IMDEA Networks Institute опубликовали 4 мая результаты, показывающие, что все четыре крупнейших помощника ИИ — ChatGPT, Claude, Grok и Perplexity — тихо делятся данными с сторонними рекламными и аналитическими службами, включая Meta, Google и TikTok. Проект под названием LeakyLM выявил более 13 встроенных трекеров по этим платформам. Ни один из них не раскрыт пользователям в понятной форме.

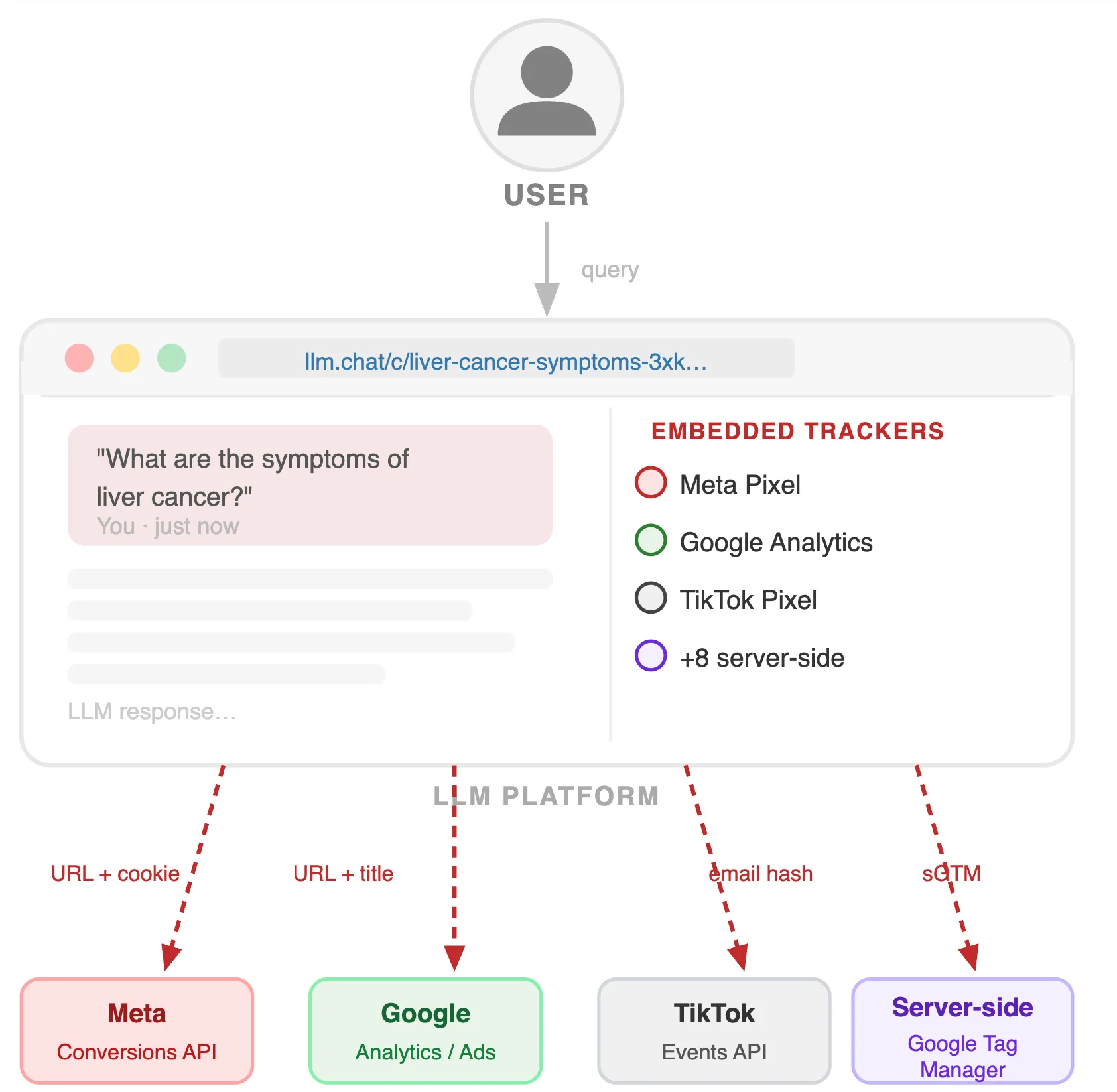

Изображение: IMDEA Networks Institute

Думайте об этом так: каждый раз, когда вы открываете чат, невидимые программные инструменты, встроенные в веб-страницу, отправляют данные в рекламные сети — передавая информацию о том, кто вы, на какой странице находитесь и иногда даже о том, что вы набрали. Что именно утечет Самая простая утечка — это URL вашего разговора — веб-адрес, указывающий на конкретный чат. Звучит безобидно, правда? Проблема в том, что несколько платформ делают эти URL публично доступными по умолчанию, то есть любой, у кого есть ссылка, может прочитать ваш разговор без входа в систему. Когда эти URL также отправляются в рекламные системы Meta или Google, эти компании получают возможность получать доступ и читать ваши чаты. «Утечка URL — это не просто метаданные, — говорят исследователи, — это может быть эквивалентом утечки самого разговора». Grok, чат-бот ИИ от xAI Илона Маска, — самый уязвимый. Гостевые беседы по умолчанию являются публичными на платформе — вход не требуется, чтобы их прочитать. Трекер TikTok получал не только URL, но и дословное содержание сообщений через так называемые метаданные Open Graph, стандарт, используемый для генерации изображений предпросмотра при обмене ссылками. По сути, система TikTok получила скриншот вашего разговора.

Изображение: IMDEA Networks Institute

Claude (Anthropic) и ChatGPT (OpenAI) имеют более строгие контроль доступа — ваши беседы не являются публичными, если вы сами не решите их поделиться. Но они все равно передают URL разговоров и идентифицирующие данные, такие как рекламные cookies, в Meta и Google. Для Claude эти данные отправляются на 11 рекламных платформ через собственные серверы Anthropic, а не через браузер, поэтому блокировщик рекламы не остановит их. Perplexity в прошлом месяце убрала свой трекер Meta. Что вы можете сделать В исследовании признается, что оно не доказало, что Meta или Google действительно читали чьи-либо чаты. Но инфраструктура для этого существует, и данные передаются. «Изученные LLM предоставляют средства контроля конфиденциальности для ограничения видимости разговоров, но могут вводить пользователей в заблуждение, создавая впечатление о более строгой защите, чем есть на самом деле», — утверждают исследователи. «Хотя у нас еще нет доказательств того, что разговоры читаются трекерами, распространение постоянных ссылок и, следовательно, возможность их чтения существуют, а значит, существует потенциальный риск». Это не первый случай, когда платформы ИИ подвергаются критике за конфиденциальность. Недавно Claude начал требовать подтверждение личности через государственный ID для новых подписчиков — шаг, вызвавший негативную реакцию тех же пользователей, которые перешли с ChatGPT из-за опасений по поводу слежки, как сообщила Decrypt в прошлом месяце. Пока что практических мер ограничено. В Grok ограничьте видимость бесед в настройках и явно отмените любую уже отправленную ссылку. В Claude хотя бы отключите несущественные cookies, чтобы отключить Meta Pixel. В Perplexity установите беседы как Частные. В ChatGPT отказ от cookies там, где возможно, уменьшает риск утечки, хотя Google Analytics все равно работает для авторизованных пользователей бесплатно. Если хотите пойти еще дальше и полностью защититься, наш гид по конфиденциальности ИИ может стать хорошим ресурсом. Исследователи планируют расширить свой анализ на Meta AI, Microsoft Copilot и Google Gemini — их исключили из этого раунда, потому что они одновременно выступают и поставщиками ИИ, и рекламными компаниями, что усложняет модель угроз. Результаты были переданы в органы по защите данных 13 апреля 2026 года. xAI было уведомлено 17 апреля. На момент публикации ни одна компания не дала ответа.