Futures

Accédez à des centaines de contrats perpétuels

TradFi

Or

Une plateforme pour les actifs mondiaux

Options

Hot

Tradez des options classiques de style européen

Compte unifié

Maximiser l'efficacité de votre capital

Trading démo

Introduction au trading futures

Préparez-vous à trader des contrats futurs

Événements futures

Participez aux événements et gagnez

Demo Trading

Utiliser des fonds virtuels pour faire l'expérience du trading sans risque

Lancer

CandyDrop

Collecte des candies pour obtenir des airdrops

Launchpool

Staking rapide, Gagnez de potentiels nouveaux jetons

HODLer Airdrop

Conservez des GT et recevez d'énormes airdrops gratuitement

Pre-IPOs

Accédez à l'intégralité des introductions en bourse mondiales

Points Alpha

Tradez on-chain et gagnez des airdrops

Points Futures

Gagnez des points Futures et réclamez vos récompenses d’airdrop.

Investissement

Simple Earn

Gagner des intérêts avec des jetons inutilisés

Investissement automatique

Auto-invest régulier

Double investissement

Profitez de la volatilité du marché

Staking souple

Gagnez des récompenses grâce au staking flexible

Prêt Crypto

0 Fees

Mettre en gage un crypto pour en emprunter une autre

Centre de prêts

Centre de prêts intégré

Promotions

Centre d'activités

Participez et gagnez des récompenses

Parrainage

20 USDT

Invitez des amis et gagnez des récompenses

Programme d'affiliation

Obtenez des commissions exclusives

Gate Booster

Développez votre influence et gagnez des airdrops

Annoncement

Mises à jour en temps réel

Blog Gate

Articles sur le secteur de la crypto

AI

Gate AI

Votre assistant IA polyvalent pour toutes vos conversations

Gate AI Bot

Utilisez Gate AI directement dans votre application sociale

GateClaw

Gate Blue Lobster, prêt à l’emploi

Gate for AI Agent

Infrastructure IA, Gate MCP, Skills et CLI

Gate Skills Hub

+10K compétences

De la bureautique au trading, une bibliothèque de compétences tout-en-un pour exploiter pleinement l’IA

GateRouter

Choisissez intelligemment parmi plus de 40 modèles d’IA, avec 0 % de frais supplémentaires

Révéler le Transformer dans l'iPhone : basé sur l'architecture GPT-2, le segmenteur de mots contient des emoji, produits par des anciens élèves du MIT

Source originale : Qubits

Le “secret” du Transformer d’Apple a été révélé par des passionnés.

Dans la vague des grands modèles, même si l’on est aussi conservateur qu’Apple, il faut mentionner « Transformer » à chaque conférence de presse.

Par exemple, lors de la WWDC de cette année, Apple a annoncé que les nouvelles versions d’iOS et de macOS auront des modèles de langage Transformer intégrés pour fournir des méthodes de saisie avec des capacités de prédiction de texte.

Un gars nommé Jack Cook a bouleversé la version bêta de macOS Sonoma et a découvert de nombreuses nouvelles informations :

Jetons un coup d’oeil à plus de détails.

Basé sur l’architecture GPT-2

Tout d’abord, examinons les fonctions que le modèle de langage basé sur Transformer d’Apple peut implémenter sur iPhone, MacBook et autres appareils.

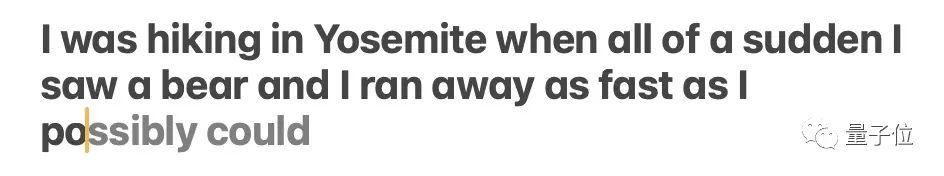

Cela se reflète principalement dans la méthode de saisie. La propre méthode de saisie d’Apple, prise en charge par le modèle de langage, peut réaliser des fonctions de prédiction de mots et de correction d’erreurs.

** **### △Source : article de blog de Jack Cook

**### △Source : article de blog de Jack Cook

Le modèle prédit parfois plusieurs mots à venir, mais cela est limité aux situations où la sémantique de la phrase est très évidente, similaire à la fonction de saisie semi-automatique de Gmail.

** **### △Source : article de blog de Jack Cook

**### △Source : article de blog de Jack Cook

Alors, où exactement ce modèle est-il installé ? Après quelques recherches approfondies, frère Cook a déterminé :

Parce que:

De plus, sur la base de la structure du réseau décrite dans unilm_joint_cpu, j’ai supposé que le modèle Apple est basé sur l’architecture GPT-2 :

Il comprend principalement l’intégration de jetons, le codage de position, le bloc décodeur et la couche de sortie. Chaque bloc décodeur contient des mots tels que gpt2_transformer_layer_3d.

** **### △Source : article de blog de Jack Cook

**### △Source : article de blog de Jack Cook

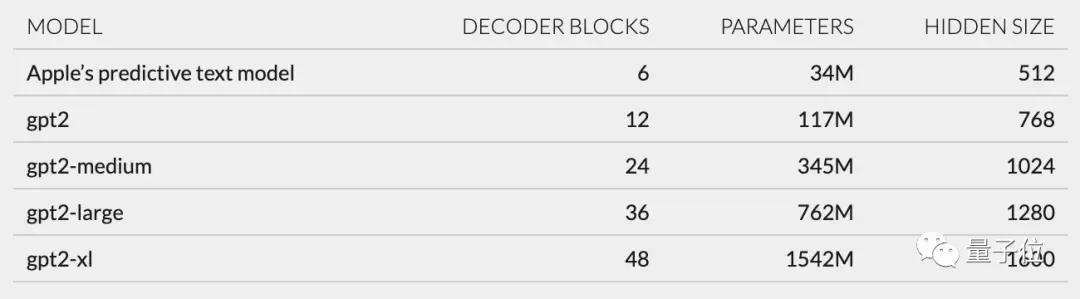

Sur la base de la taille de chaque couche, j’ai également supposé que le modèle Apple comporte environ 34 millions de paramètres et que la taille de la couche cachée est de 512. Autrement dit, il est plus petit que la plus petite version de GPT-2.

Je pense que c’est principalement parce qu’Apple souhaite un modèle qui consomme moins d’énergie mais qui puisse fonctionner rapidement et fréquemment.

La déclaration officielle d’Apple à la WWDC est que “chaque fois que vous cliquez sur une touche, l’iPhone exécutera le modèle une fois”.

Cependant, cela signifie également que ce modèle de prédiction de texte n’est pas très efficace pour poursuivre complètement des phrases ou des paragraphes.

** **### △Source : article de blog de Jack Cook

**### △Source : article de blog de Jack Cook

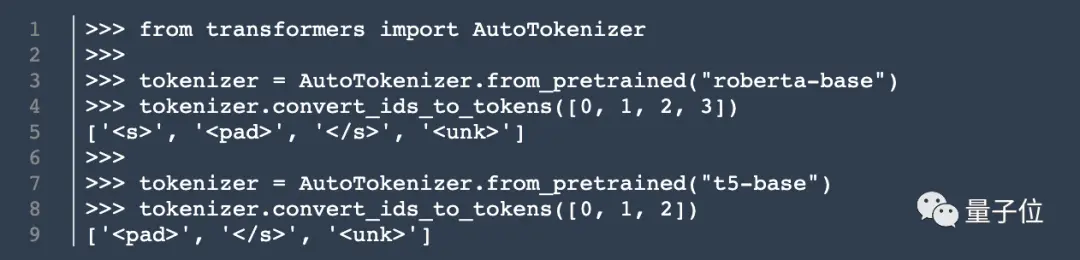

En plus de l’architecture du modèle, Cook a également découvert des informations sur le tokenizer.

Il a trouvé un ensemble de 15 000 jetons dans unilm.bundle/sp.dat. Il convient de noter qu’il contient 100 emoji.

Cook révèle Cook

Bien que ce cuisinier ne soit pas un cuisinier, mon article de blog a quand même attiré beaucoup d’attention dès sa publication.

Auparavant, il a effectué un stage chez NVIDIA, se concentrant sur la recherche de modèles de langage tels que BERT. Il est également ingénieur principal en recherche et développement pour le traitement du langage naturel au New York Times.

Alors, sa révélation a-t-elle également déclenché des réflexions dans votre esprit ? Bienvenue pour partager votre point de vue dans la zone de commentaires ~

Lien d’origine :