Futuros

Aceda a centenas de contratos perpétuos

TradFi

Ouro

Plataforma de ativos tradicionais globais

Opções

Hot

Negoceie Opções Vanilla ao estilo europeu

Conta Unificada

Maximize a eficiência do seu capital

Negociação de demonstração

Introdução à negociação de futuros

Prepare-se para a sua negociação de futuros

Eventos de futuros

Participe em eventos para recompensas

Negociação de demonstração

Utilize fundos virtuais para experimentar uma negociação sem riscos

Lançamento

CandyDrop

Recolher doces para ganhar airdrops

Launchpool

Faça staking rapidamente, ganhe potenciais novos tokens

HODLer Airdrop

Detenha GT e obtenha airdrops maciços de graça

Pre-IPOs

Desbloquear acesso completo a IPO de ações globais

Pontos Alpha

Negoceie ativos on-chain para airdrops

Pontos de futuros

Ganhe pontos de futuros e receba recompensas de airdrop

Investimento

Simple Earn

Ganhe juros com tokens inativos

Investimento automático

Invista automaticamente de forma regular.

Investimento Duplo

Aproveite a volatilidade do mercado

Soft Staking

Ganhe recompensas com staking flexível

Empréstimo de criptomoedas

0 Fees

Dê em garantia uma criptomoeda para pedir outra emprestada

Centro de empréstimos

Centro de empréstimos integrado

Promoções

Centro de atividades

Participe de atividades para recompensas

Referência

20 USDT

Convide amigos para recompensas de ref.

Programa de afiliados

Ganhe recomp. de comissão exclusivas

Gate Booster

Aumente a influência e ganhe airdrops

Announcements

Atualizações na plataforma em tempo real

Blog da Gate

Artigos da indústria cripto

AI

Gate AI

O seu parceiro de IA conversacional tudo-em-um

Gate AI Bot

Utilize o Gate AI diretamente na sua aplicação social

GateClaw

Gate Lagosta Azul, pronto a usar

Gate for AI Agent

Infraestrutura de IA, Gate MCP, Skills e CLI

Gate Skills Hub

Mais de 10 mil competências

Do escritório à negociação, uma biblioteca de competências tudo-em-um torna a IA ainda mais útil

GateRouter

Escolha inteligentemente entre mais de 40 modelos de IA, com 0% de taxas adicionais

Revelando o Transformer no iPhone: Baseado na arquitetura GPT-2, a palavra segmentador contém emoji, produzido por ex-alunos do MIT

Fonte original: Qubits

O “segredo” do Transformer da Apple foi revelado por entusiastas.

Na onda dos modelos grandes, mesmo que você seja tão conservador quanto a Apple, deve mencionar “Transformer” em todas as coletivas de imprensa.

Por exemplo, na WWDC deste ano, a Apple anunciou que as novas versões do iOS e macOS terão modelos de linguagem Transformer integrados para fornecer métodos de entrada com recursos de previsão de texto.

Um cara chamado Jack Cook virou o beta do macOS Sonoma de cabeça para baixo e descobriu muitas informações novas:

Vamos dar uma olhada em mais detalhes.

Baseado na arquitetura GPT-2

Primeiro, vamos revisar quais funções o modelo de linguagem baseado em Transformer da Apple pode implementar no iPhone, MacBook e outros dispositivos.

Refletido principalmente no método de entrada. O próprio método de entrada da Apple, suportado pelo modelo de linguagem, pode realizar funções de previsão de palavras e correção de erros.

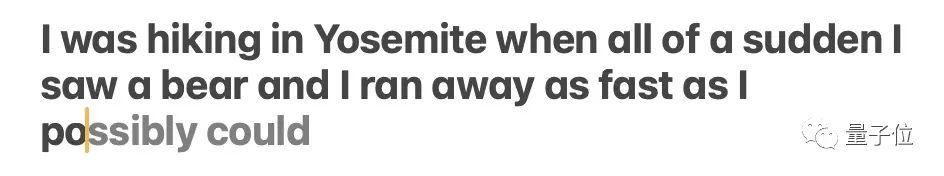

** **### △Fonte: postagem do blog Jack Cook

**### △Fonte: postagem do blog Jack Cook

O modelo às vezes prevê várias palavras futuras, mas isso é limitado a situações em que a semântica da frase é muito óbvia, semelhante à função de preenchimento automático do Gmail.

** **### △Fonte: postagem do blog Jack Cook

**### △Fonte: postagem do blog Jack Cook

Então, onde exatamente esse modelo está instalado? Depois de pesquisar profundamente, o irmão Cook determinou:

Porque:

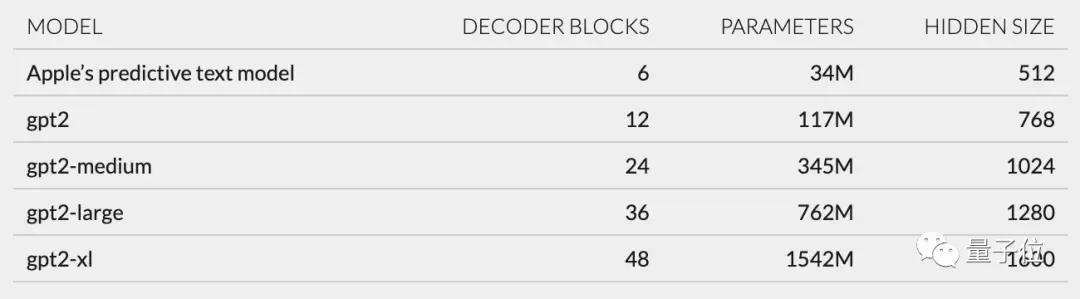

Além disso, com base na estrutura de rede descrita em unilm_joint_cpu, especulei que o modelo Apple é baseado na arquitetura GPT-2:

Inclui principalmente incorporações de token, codificação de posição, bloco decodificador e camada de saída. Cada bloco decodificador possui palavras como gpt2_transformer_layer_3d.

** **### △Fonte: postagem do blog Jack Cook

**### △Fonte: postagem do blog Jack Cook

Com base no tamanho de cada camada, também especulei que o modelo Apple tem aproximadamente 34 milhões de parâmetros e o tamanho da camada oculta é 512. Ou seja, é menor que a menor versão do GPT-2.

Acredito que isso se deva principalmente ao fato de a Apple querer um modelo que consuma menos energia, mas que possa funcionar com rapidez e frequência.

A declaração oficial da Apple na WWDC é que “cada vez que uma tecla é clicada, o iPhone executará o modelo uma vez”.

No entanto, isso também significa que este modelo de previsão de texto não é muito bom para continuar frases ou parágrafos completamente.

** **### △Fonte: postagem do blog Jack Cook

**### △Fonte: postagem do blog Jack Cook

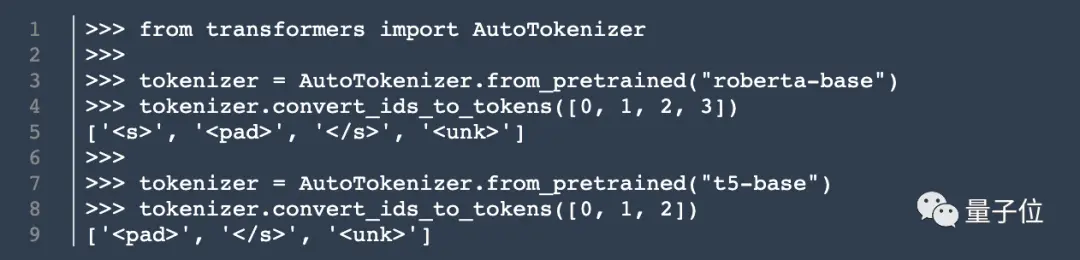

Além da arquitetura do modelo, Cook também desenterrou informações sobre o tokenizer.

Ele encontrou um conjunto de 15.000 tokens em unilm.bundle/sp.dat. Vale ressaltar que ele contém 100 emojis.

Cook revela Cook

Embora este cozinheiro não seja cozinheiro, meu post no blog ainda atraiu muita atenção assim que foi publicado.

Anteriormente, estagiou na NVIDIA, com foco na pesquisa de modelos de linguagem como BERT. Ele também é engenheiro sênior de pesquisa e desenvolvimento para processamento de linguagem natural no The New York Times.

Então, a revelação dele também despertou alguns pensamentos em você? Bem-vindo a compartilhar suas opiniões na área de comentários ~

Links originais: