Básico

Spot

Opera con criptomonedas libremente

Margen

Multiplica tus beneficios con el apalancamiento

Convertir e Inversión automática

0 Fees

Opera cualquier volumen sin tarifas ni deslizamiento

ETF

Obtén exposición a posiciones apalancadas de forma sencilla

Trading premercado

Opera nuevos tokens antes de su listado

Contrato

Accede a cientos de contratos perpetuos

TradFi

Oro

Plataforma global de activos tradicionales

Opciones

Hot

Opera con opciones estándar al estilo europeo

Cuenta unificada

Maximiza la eficacia de tu capital

Trading de prueba

Introducción al trading de futuros

Prepárate para operar con futuros

Eventos de futuros

Únete a eventos para ganar recompensas

Trading de prueba

Usa fondos virtuales para probar el trading sin asumir riesgos

Lanzamiento

CandyDrop

Acumula golosinas para ganar airdrops

Launchpool

Staking rápido, ¡gana nuevos tokens con potencial!

HODLer Airdrop

Holdea GT y consigue airdrops enormes gratis

Pre-IPOs

Accede al acceso completo a las OPV de acciones globales

Puntos Alpha

Opera activos on-chain y recibe airdrops

Puntos de futuros

Gana puntos de futuros y reclama recompensas de airdrop

Inversión

Simple Earn

Genera intereses con los tokens inactivos

Inversión automática

Invierte automáticamente de forma regular

Inversión dual

Aprovecha la volatilidad del mercado

Staking flexible

Gana recompensas con el staking flexible

Préstamo de criptomonedas

0 Fees

Usa tu cripto como garantía y pide otra en préstamo

Centro de préstamos

Centro de préstamos integral

Centro de patrimonio VIP

Planes de aumento patrimonial prémium

Gestión patrimonial privada

Asignación de activos prémium

Quant Fund

Estrategias cuantitativas de alto nivel

Staking

Haz staking de criptomonedas para ganar en productos PoS

Apalancamiento inteligente

Apalancamiento sin liquidación

Acuñación de GUSD

Acuña GUSD y gana rentabilidad de RWA

Promociones

Centro de actividades

Únete a actividades y gana recompensas

Referido

20 USDT

Invita amigos y gana por tus referidos

Programa de afiliados

Gana recompensas de comisión exclusivas

Gate Booster

Aumenta tu influencia y gana airdrops

Anuncio

Novedades de plataforma en tiempo real

Gate Blog

Artículos del sector de las criptomonedas

AI

Gate AI

Tu compañero de IA conversacional para todo

Gate AI Bot

Usa Gate AI directamente en tu aplicación social

GateClaw

Gate Blue Lobster, listo para usar

Gate for AI Agent

Infraestructura de IA, Gate MCP, Skills y CLI

Gate Skills Hub

+10 000 habilidades

De la oficina al trading, una biblioteca de habilidades todo en uno para sacar el máximo partido a la IA

GateRouter

Elige inteligentemente entre más de 40 modelos de IA, con 0% de costos adicionales

Revelando el transformador en el iPhone: basado en la arquitectura GPT-2, la palabra segmentador contiene emoji, producido por ex alumnos del MIT

Fuente original: Qubits

Los entusiastas han revelado el “secreto” del Transformer de Apple.

En la ola de modelos grandes, incluso si eres tan conservador como Apple, debes mencionar “Transformer” en cada conferencia de prensa.

Por ejemplo, en la WWDC de este año, Apple anunció que las nuevas versiones de iOS y macOS tendrán modelos de lenguaje Transformer integrados para proporcionar métodos de entrada con capacidades de predicción de texto.

Un tipo llamado Jack Cook puso patas arriba la versión beta de macOS Sonoma y descubrió mucha información nueva:

Echemos un vistazo a más detalles.

Basado en la arquitectura GPT-2

Primero, revisemos qué funciones puede implementar el modelo de lenguaje basado en Transformer de Apple en iPhone, MacBook y otros dispositivos.

Reflejado principalmente en el método de entrada. El método de entrada propio de Apple, respaldado por el modelo de lenguaje, puede realizar funciones de predicción de palabras y corrección de errores.

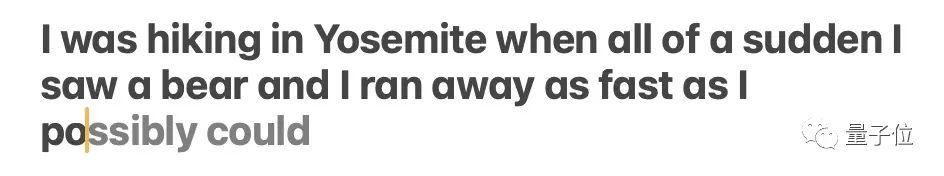

** **### △Fuente: publicación del blog de Jack Cook

**### △Fuente: publicación del blog de Jack Cook

El modelo a veces predice varias palabras próximas, pero esto se limita a situaciones en las que la semántica de la oración es muy obvia, similar a la función de autocompletar de Gmail.

** **### △Fuente: publicación del blog de Jack Cook

**### △Fuente: publicación del blog de Jack Cook

Entonces, ¿dónde está instalado exactamente este modelo? Después de investigar un poco en profundidad, el hermano Cook determinó:

Porque:

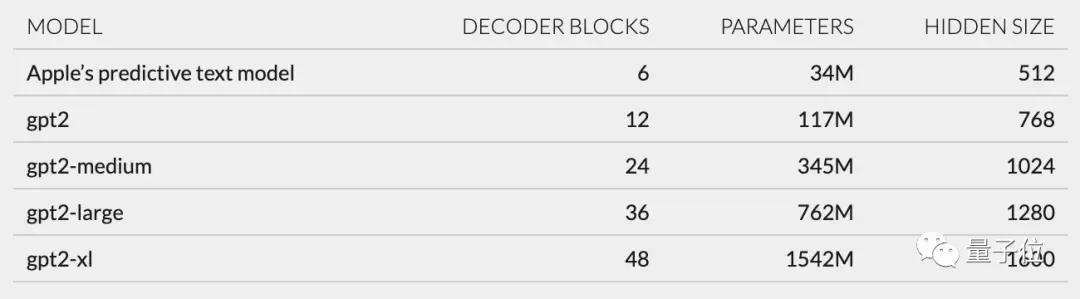

Además, basándome en la estructura de red descrita en unilm_joint_cpu, especulé que el modelo de Apple se basa en la arquitectura GPT-2:

Incluye principalmente incrustaciones de tokens, codificación de posición, bloque decodificador y capa de salida. Cada bloque decodificador tiene palabras como gpt2_transformer_layer_3d.

** **### △Fuente: publicación del blog de Jack Cook

**### △Fuente: publicación del blog de Jack Cook

Según el tamaño de cada capa, también especulé que el modelo de Apple tiene aproximadamente 34 millones de parámetros y el tamaño de la capa oculta es 512. Es decir, es más pequeño que la versión más pequeña de GPT-2.

Creo que esto se debe principalmente a que Apple quiere un modelo que consuma menos energía pero que pueda funcionar con rapidez y frecuencia.

La declaración oficial de Apple en la WWDC es que “cada vez que se hace clic en una tecla, el iPhone ejecutará el modelo una vez”.

Sin embargo, esto también significa que este modelo de predicción de texto no es muy bueno para continuar oraciones o párrafos por completo.

** **### △Fuente: publicación del blog de Jack Cook

**### △Fuente: publicación del blog de Jack Cook

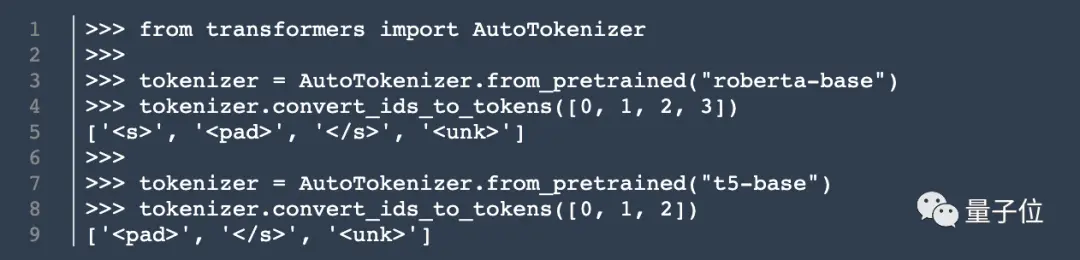

Además de la arquitectura del modelo, Cook también desenterró información sobre el tokenizador.

Encontró un conjunto de 15.000 tokens en unilm.bundle/sp.dat. Vale la pena señalar que contiene 100 emoji.

El cocinero revela al cocinero

Aunque este cocinero no es cocinero, la publicación de mi blog atrajo mucha atención tan pronto como se publicó.

Anteriormente, realizó una pasantía en NVIDIA, enfocándose en la investigación de modelos de lenguaje como BERT. También es ingeniero senior de investigación y desarrollo para el procesamiento del lenguaje natural en The New York Times.

Entonces, ¿su revelación también provocó algunos pensamientos en usted? Bienvenido a compartir sus puntos de vista en el área de comentarios ~

Enlace original: