¿Viene GPT-5? Se reveló que OpenAI aceleró el entrenamiento del gran modelo multimodal Gobi, ¡matando a Google Gimini de un solo golpe!

**Fuente:**Xinzhiyuan

Introducción: En el campo de batalla de los modelos grandes multimodales, algunas personas ya se han enterado. Según informes de medios extranjeros, el nuevo modelo multimodal Gobi de OpenAI parece estar en preparación. El enfrentamiento entre Google y OpenAI parece inminente.

Fuente de la imagen: Generada por IA ilimitada

Fuente de la imagen: Generada por IA ilimitada

A medida que se acerca el otoño, la batalla del modelo multimodal entre Google y OpenAI también ha entrado en una etapa feroz.

La semana pasada, Google abrió las capacidades de su gran modelo multimodal Gemini a algunas empresas externas.

Y OpenAI, por supuesto, no se quedará quieto esperando la muerte. Están compitiendo contra el tiempo para integrar funciones multimodales en GPT-4, esforzándose por lanzar un modelo multimodal grande con funciones similares a Gemini y matar a Google de una sola vez.

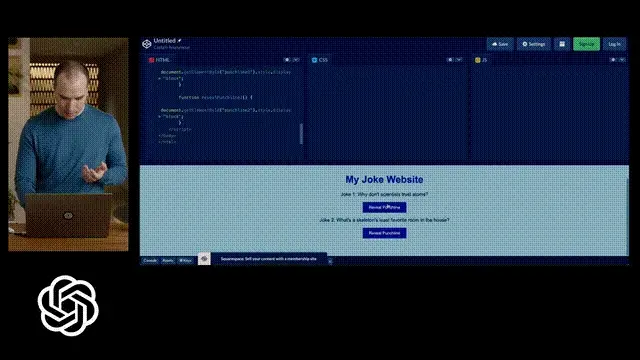

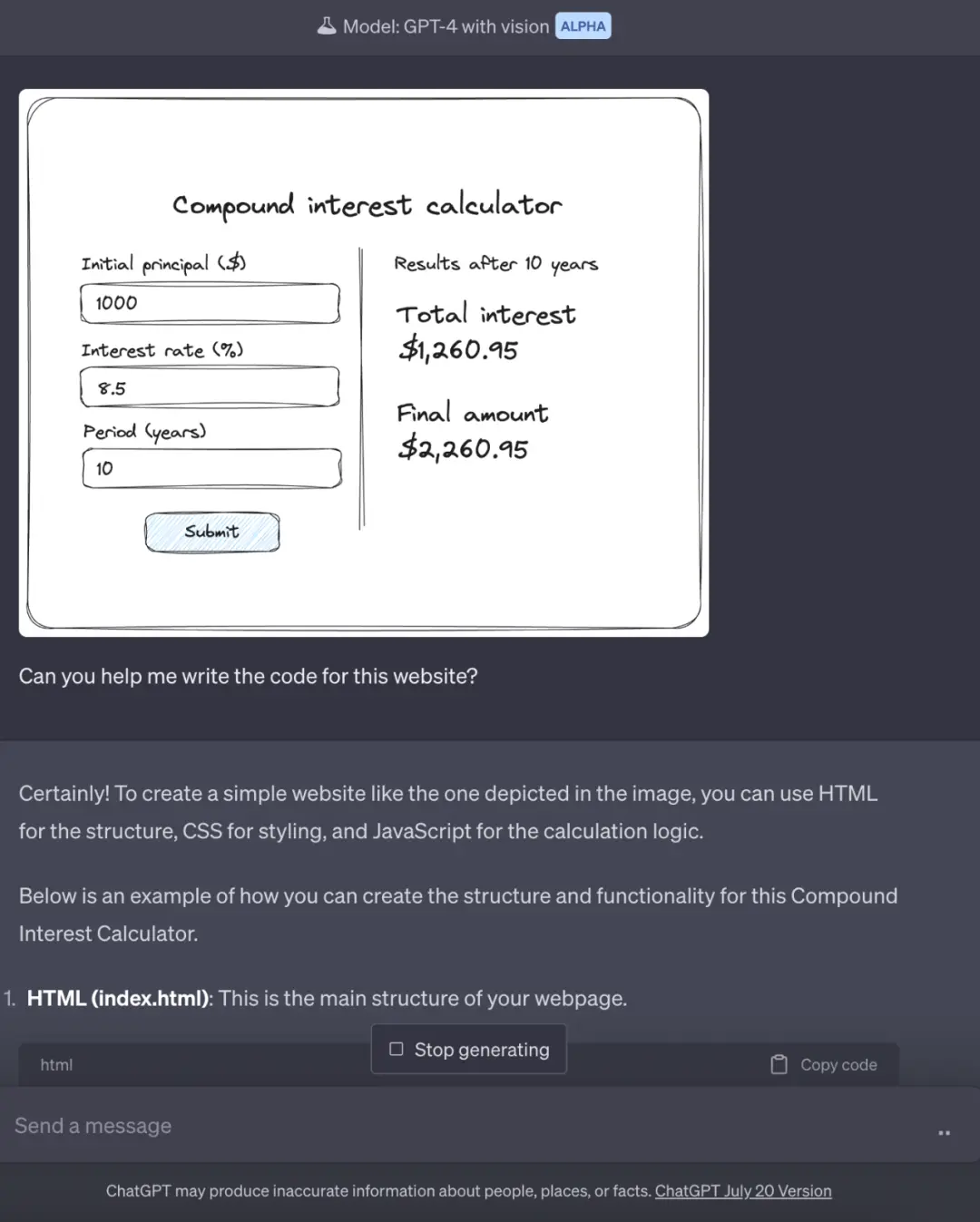

La legendaria función multimodal se demostró en la conferencia GPT-4 de OpenAI que conmocionó al mundo en marzo de este año——

Dibuja un boceto en papel, toma una foto y envíala a GPT-4, y di “Hazme un sitio web con este diseño”, e inmediatamente escribirá el código de la página web.

El jefe Greg Brockman demostró personalmente en línea

El jefe Greg Brockman demostró personalmente en línea

Pero entonces, la multimodalidad parecía ser un destello de la sartén, y nadie ha visto nunca una función física productiva.

Entonces, ¿finalmente llegará la guerra multimodal entre Google y OpenAI?

Compitiendo con Google, OpenAI se apresura a lanzar grandes modelos multimodales

Ante los rumores de que Google va a acabar con este gran asesino, OpenAI no permanecerá indiferente.

Según el medio extranjero The Information, ya se está preparando intensamente un nuevo modelo grande multimodal llamado Gobi.

OpenAI planea lanzar un LLM multimodal antes del lanzamiento de Gemini, derrotando por completo a Google.

Greg Brockman de OpenAI contra Demis Hassabis de Google

Greg Brockman de OpenAI contra Demis Hassabis de Google

De hecho, después de lanzar una vista previa de la función multimodal GPT-4 en marzo, OpenAI lanzó esta función a una empresa llamada Be My Eyes, pero no la ha proporcionado a otras empresas.

Como se puede ver por el nombre, esta empresa está desarrollando tecnología que permite a las personas ciegas o con discapacidad visual ver con mayor claridad.

Recientemente, OpenAI planea implementar una función llamada GPT-Vision de manera más amplia.

¿Por qué OpenAI tardó tanto?

¿Por qué OpenAI tardó tanto?

La razón principal es que les preocupa que los delincuentes utilicen las nuevas funciones visuales, como hacerse pasar por humanos descifrando automáticamente códigos de verificación o rastrear humanos mediante reconocimiento facial.

Sin embargo, los ingenieros de OpenAI parecen haber resuelto estos riesgos de seguridad legal.

De manera similar, un portavoz de Google también dijo: Google ha tomado algunas medidas para evitar que se abuse de Gemini.

En un compromiso realizado en julio, Google se comprometió a desarrollar inteligencia artificial responsable en todos sus productos.

**¿Puede Gobi convertirse en GPT-5? **

Después de GPT-Vision, es probable que OpenAI lance un modelo grande multimodal más potente, cuyo nombre en código es Gobi.

A diferencia de GPT-4, Gobi se basa en un modelo multimodal desde el principio.

Entonces, ¿Gobi es el legendario GPT-5?

En este momento, no lo sabemos. No hay información definitiva sobre hasta dónde ha llegado Gobi en los entrenamientos.

En este momento, no lo sabemos. No hay información definitiva sobre hasta dónde ha llegado Gobi en los entrenamientos.

A principios de septiembre, Mustafa Suleyman, cofundador de DeepMind y ahora director ejecutivo de Inflection AI, lanzó una bomba en una entrevista: según sus especulaciones, OpenAI estaba entrenando en secreto GPT-5.

Suleyman cree que Sam Altman puede no estar diciendo la verdad cuando dijo recientemente que no entrenaron a GPT-5. (Las palabras originales son: Vamos. No lo sé. Creo que es mejor que todos seamos sinceros al respecto).

Aquí, según las personas que han probado Gemini, Gemini producirá menos alucinaciones que los modelos existentes. Los motivos se detallan a continuación.

Aquí, según las personas que han probado Gemini, Gemini producirá menos alucinaciones que los modelos existentes. Los motivos se detallan a continuación.

En resumen, se puede decir que la guerra de modelos multimodal entre Google y OpenAI es la versión AI del enfrentamiento entre iPhone y Android.

Uno es un gigante de Silicon Valley que ha dominado el campo de la IA durante muchos años, y el otro es una nueva empresa de IA de primer nivel que no tiene igual en el centro de atención. esperando con gran expectación.

### Google prueba en secreto a Gemini

### Google prueba en secreto a Gemini

Por otro lado, Google también ha comenzado a invitar a algunos desarrolladores externos para acelerar las pruebas del próximo modelo grande multimodal Gemini de próxima generación.

La semana pasada, The Information informó exclusivamente que Gemini pronto podría estar listo para una versión beta e integrarse en servicios como Google Cloud Vertex AI.

En la Conferencia de desarrolladores de Google I/O de este año, Pichai presentó públicamente Gemini, que es un modelo multimodal, una herramienta de integración eficiente y una API.

En la Conferencia de desarrolladores de Google I/O de este año, Pichai presentó públicamente Gemini, que es un modelo multimodal, una herramienta de integración eficiente y una API.

Para trabajar juntos y hacer grandes cosas, Google también fusionó Google Brain con DeepMind Labs.

Se dice que al menos más de 20 ejecutivos participaron en la investigación y el desarrollo de Gemini, liderados por Demis Hassabis, el fundador de DeepMind, y Sergey Brin, el fundador de Google, participó en la investigación y el desarrollo.

Se dice que al menos más de 20 ejecutivos participaron en la investigación y el desarrollo de Gemini, liderados por Demis Hassabis, el fundador de DeepMind, y Sergey Brin, el fundador de Google, participó en la investigación y el desarrollo.

También hay cientos de empleados en Google DeepMind, incluido el ex director de Google Brain, Jeff Dean, y otros.

Una persona que lo probó dijo que Gemini tiene una ventaja sobre GPT-4 al menos en un sentido: además de la información disponible públicamente en la web, el modelo también aprovecha una gran cantidad de datos patentados de los productos de consumo de Google (búsqueda, YouTube). .

Por lo tanto, Gemini debería ser particularmente preciso a la hora de comprender la intención del usuario ante una consulta específica y parece producir menos respuestas incorrectas, es decir, alucinaciones.

Según informes anteriores de los analistas de SemiAnalysis, el modelo grande de próxima generación Gemini de Google ha comenzado a entrenarse en el nuevo Pod TPUv5, con una potencia informática de hasta ~1e26 FLOPS, que es 5 veces mayor que la potencia informática del GPT-4 de entrenamiento.

Según informes anteriores de los analistas de SemiAnalysis, el modelo grande de próxima generación Gemini de Google ha comenzado a entrenarse en el nuevo Pod TPUv5, con una potencia informática de hasta ~1e26 FLOPS, que es 5 veces mayor que la potencia informática del GPT-4 de entrenamiento.

Además, la base de datos de entrenamiento de Gemini contiene 93,6 mil millones de minutos de subtítulos de video en Youtube, y el tamaño total del conjunto de datos es aproximadamente el doble que el de GPT-4.

Además, la base de datos de entrenamiento de Gemini contiene 93,6 mil millones de minutos de subtítulos de video en Youtube, y el tamaño total del conjunto de datos es aproximadamente el doble que el de GPT-4.

Se dice que el modelo grande de próxima generación de Google también se compone de múltiples escalas y puede utilizar arquitectura MoE y tecnología de muestreo especulativo.

El modelo pequeño genera el token de antemano y lo pasa al modelo grande para su evaluación y mejorar la velocidad de razonamiento general del modelo.

Hassabis, director de Google DeepMind, dijo en una entrevista que se espera que Gemini cueste entre decenas y cientos de millones de dólares, lo que equivale al coste de desarrollar GPT-4.

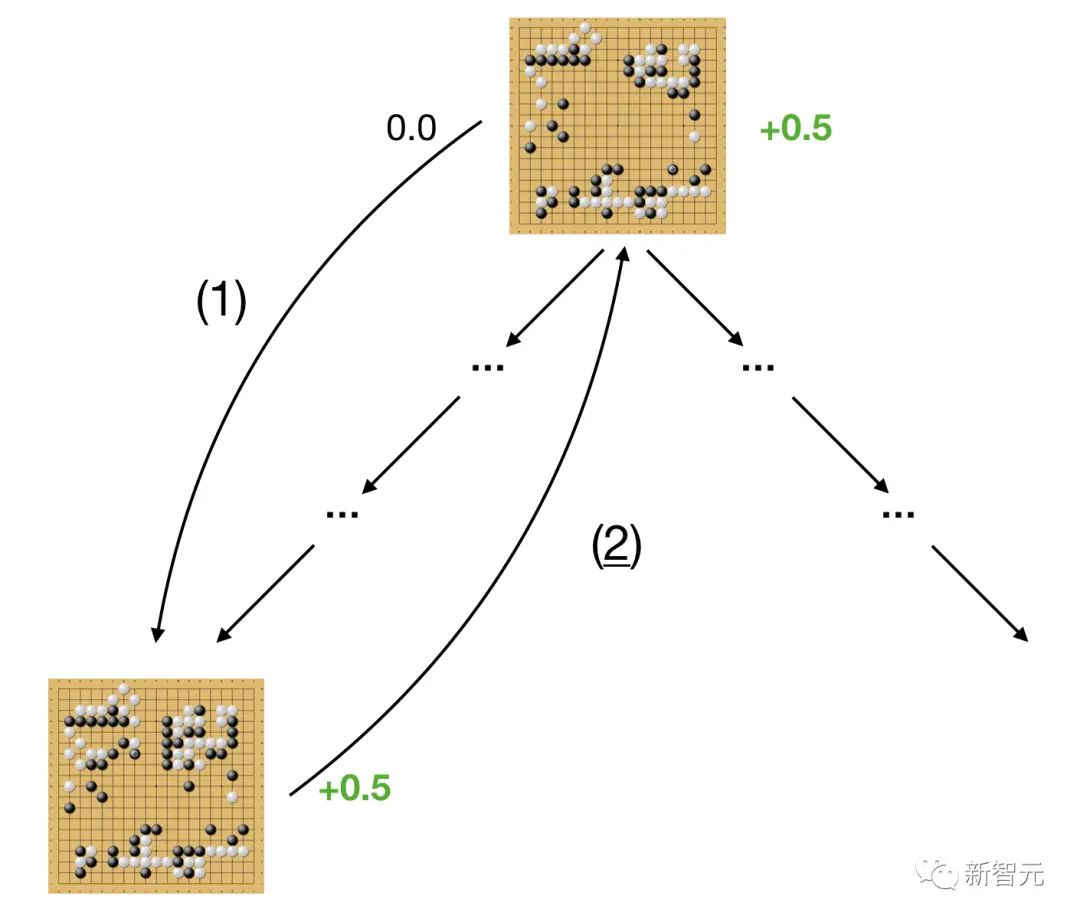

Gemini integrará la tecnología utilizada en AlphaGo, lo que dotará al sistema de nuevas capacidades de planificación y resolución de problemas.

Se puede decir que Gemini combina algunas de las ventajas del sistema AlphaGo con las increíbles capacidades lingüísticas de los modelos de lenguaje grandes. Y tenemos algunas otras innovaciones interesantes.

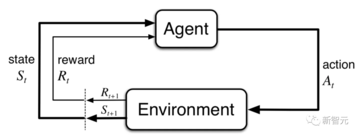

La tecnología detrás de AlphaGo es el aprendizaje por refuerzo, una tecnología de la que DeepMind fue pionera.

La tecnología detrás de AlphaGo es el aprendizaje por refuerzo, una tecnología de la que DeepMind fue pionera.

A través del aprendizaje por refuerzo, la IA puede ajustar su desempeño mediante prueba y error y recibir retroalimentación, aprendiendo así a lidiar con problemas difíciles, como elegir cómo dar el siguiente paso en Go o en los videojuegos.

Además, AlphaGo también utiliza el método Monte Carlo Tree Search (MCTS) para explorar y recordar todos los movimientos posibles en el tablero.

En comparación con los modelos existentes, Gemini mejorará en gran medida las capacidades de generación de código de los desarrolladores de software y Google espera usarlo para ponerse al día con el asistente de código GitHub Copilot de Microsoft.

En comparación con los modelos existentes, Gemini mejorará en gran medida las capacidades de generación de código de los desarrolladores de software y Google espera usarlo para ponerse al día con el asistente de código GitHub Copilot de Microsoft.

Google también ha discutido el uso de Gemini para implementar funciones como el análisis de gráficos, como pedirle al modelo que interprete el significado de los gráficos completos y usar comandos de texto o de voz para navegar por navegadores web u otro software.

Google Cloud Vertex AI, la plataforma para desarrolladores de Google Cloud, también será compatible con Gemini, con versiones grandes y pequeñas disponibles, por lo que los desarrolladores pueden pagar para comprar modelos pequeños para ejecutarlos en dispositivos personales.

Ahora, Google se está preparando plenamente para la guerra, esperando que Gemini comience su contraataque.

gpt-3.5-turbo-instruct lanzado

En julio, OpenAI anunció que la API GPT-4 está completamente disponible y lanzará nuevos modelos en los próximos meses.

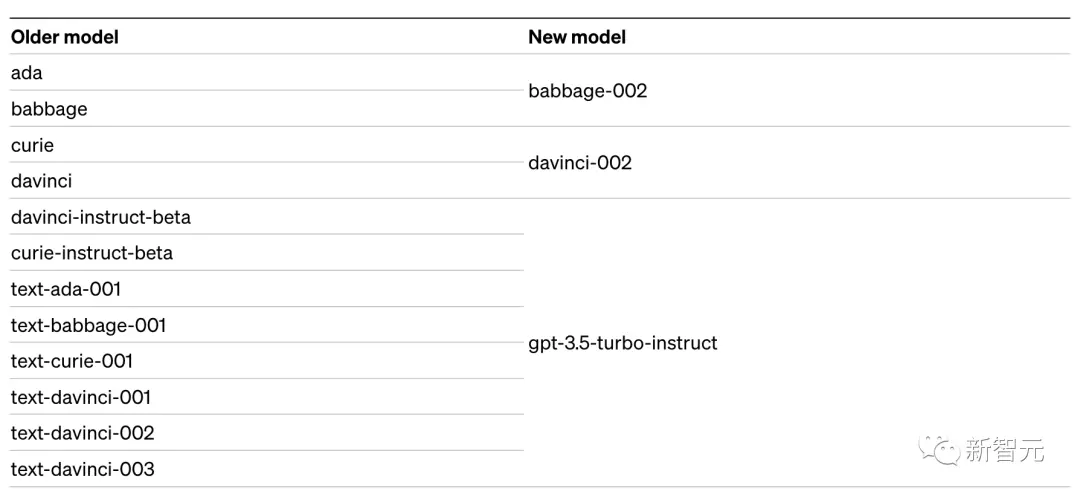

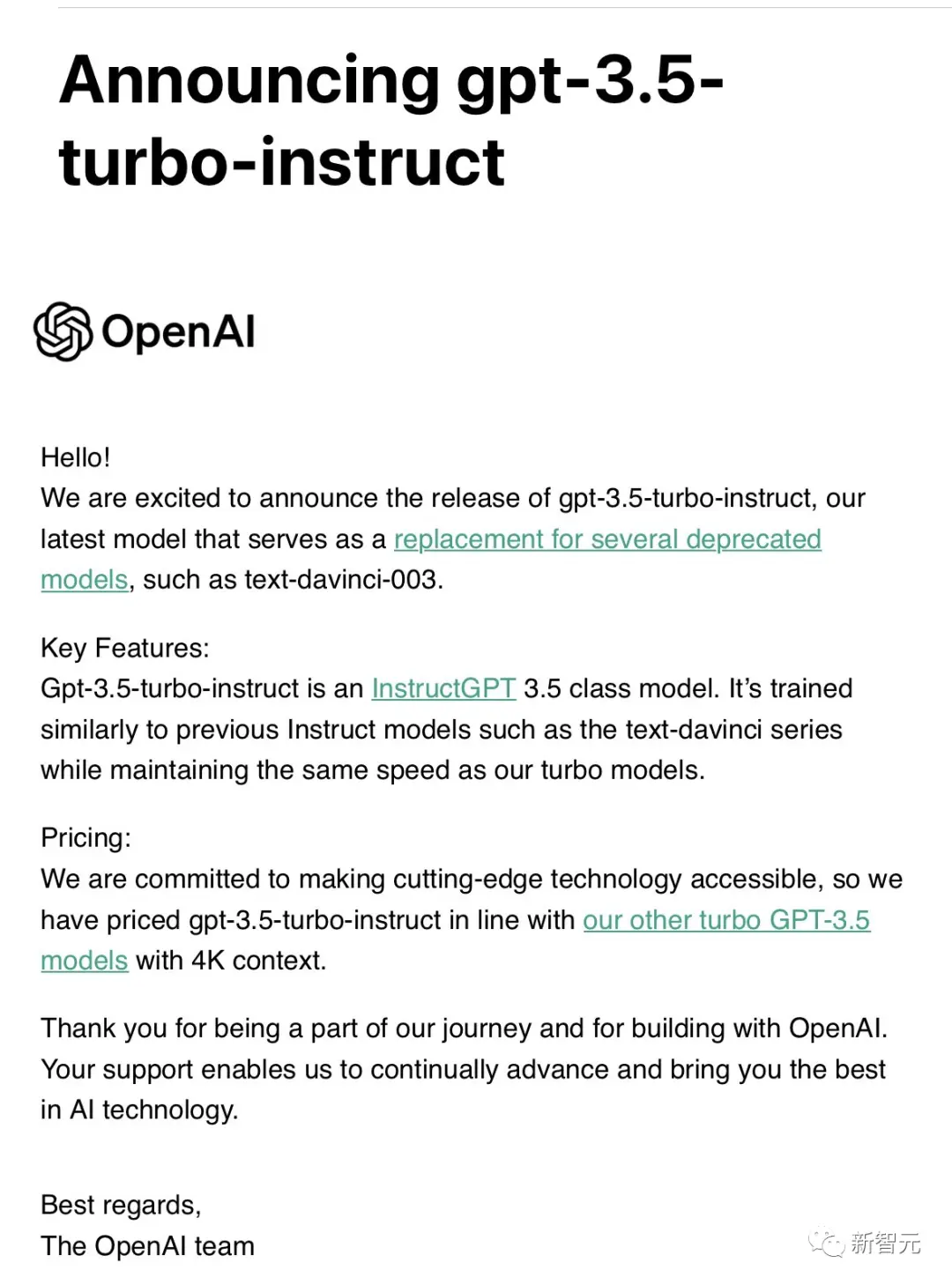

No, justo hoy, los internautas han recibido correos electrónicos que anuncian el nuevo modelo de gpt-3.5-turbo-instruct para reemplazar el antiguo modelo text-davinci-003.

No, justo hoy, los internautas han recibido correos electrónicos que anuncian el nuevo modelo de gpt-3.5-turbo-instruct para reemplazar el antiguo modelo text-davinci-003.

Según los informes, gpt-3.5-turbo-instruct es un modelo de estilo InstructGPT y su método de entrenamiento es similar al text-davinci-003.

El método de uso es similar al anterior: Finalización, completando de acuerdo con las instrucciones de la palabra indicada.

En términos de precio, el gpt-3.5-turbo 4K se mantiene consistente.

En términos de precio, el gpt-3.5-turbo 4K se mantiene consistente.

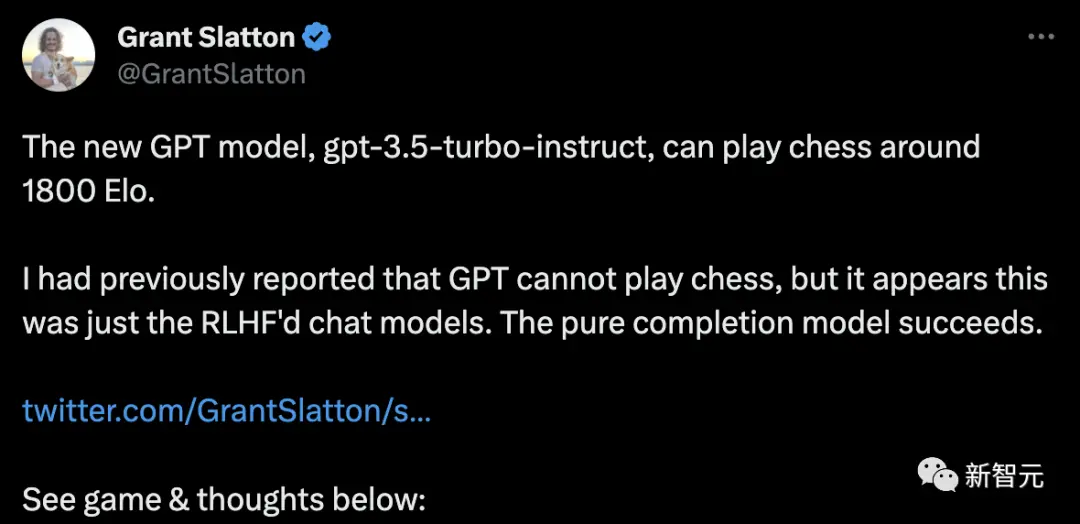

Algunos internautas han comenzado a utilizar el último modelo para jugar al ajedrez con alrededor de 1800 Elo.

Anteriormente descubrió que GPT no podía hacer esto en absoluto, pero ahora parece que esto es solo un problema con el modelo de chat RLHF, y el modelo de finalización puro tiene éxito.

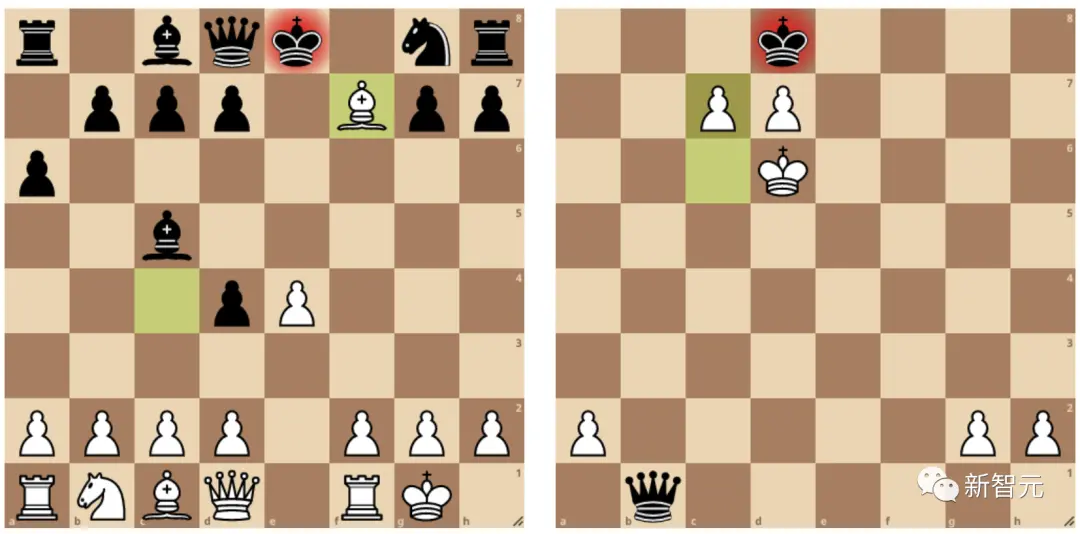

En el juego, gpt-3.5-turbo-instruct derrotó fácilmente a Stockfish en el nivel 4 (1700 puntos) y aún así no se quedó atrás en el nivel 5 (2000 puntos).

En el juego, gpt-3.5-turbo-instruct derrotó fácilmente a Stockfish en el nivel 4 (1700 puntos) y aún así no se quedó atrás en el nivel 5 (2000 puntos).

Nunca hace un movimiento ilegal, utiliza sacrificios de apertura inteligentes e increíbles jaque mate de peón y rey, lo que permite a sus oponentes avanzar sin ningún significado real.

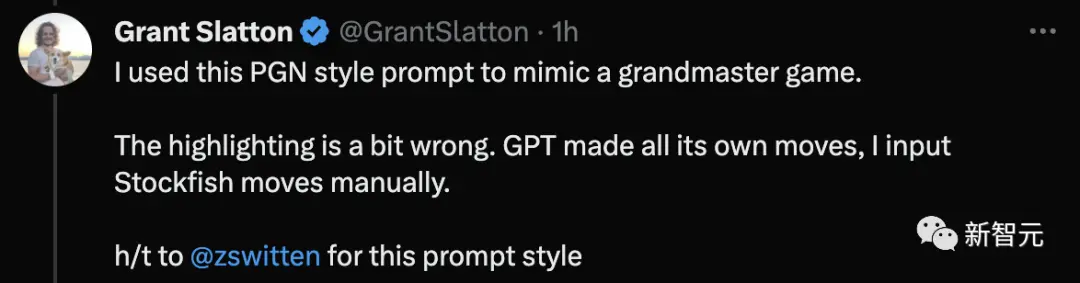

Los internautas utilizan las siguientes indicaciones de estilo PGN para simular el juego maestro. El resaltado está un poco mal. GPT hace sus propios movimientos e ingresa manualmente los movimientos de Stockfish.

Los internautas utilizan las siguientes indicaciones de estilo PGN para simular el juego maestro. El resaltado está un poco mal. GPT hace sus propios movimientos e ingresa manualmente los movimientos de Stockfish.

Por cierto, ya ha comenzado la inscripción para la primera conferencia de desarrolladores de OpenAI que se celebrará en noviembre, así que apúrate y postula.

Por cierto, ya ha comenzado la inscripción para la primera conferencia de desarrolladores de OpenAI que se celebrará en noviembre, así que apúrate y postula.

Referencias:

Referencias: